Skript zur Veranstaltung: Stochastik - math.uni

Werbung

Skript zur Veranstaltung

Stochastik

von

Gerhard Osius

p =p

!

0 ,4

0

0 ,8

0,6

1,0

0,4

0 ,8

0 ,6

1,0

0 ,4

0 ,6

1,0

0 ,8

I

I

+

I

I

"T

I

j

I I-

i

:

I

I

r-

-

~

r-

r-

:

i

i

~

15

'

I

r-

{

rf

10

r-

20

r-

r-

<a

rf

10

15

I

/ p

~

1

25

20

r-

10

'

I

'''

'

'

ha

I

I

I

I

I

15

25

20

t

t

X

X

März 2016

Fachbereich Mathematik/lnforma tik

Universität Bremen

Stochastik

16.3.16

Vorwort- 1

Vorwort

Das vorliegende Manuskript bildet die Grundlage der gleichnamigen Lehrveranstaltung für Studierende der Mathematik in den Studiengängen Diplom und Lehramt

(Bachelor und Sekundarstufe 2). Um eine gewisse Vollständigkeit zu erreichen, ist es

im Laufe der Zeit etwas umfangreicher geworden, und deshalb werden in der Veranstaltung einige Abschnitte (die mit einem * markiert sind) nicht oder nur teilweise behandelt. Die Beweise (der nicht unmittelbar nachvollziehbaren Behauptungen) sind hier bewußt fortgelassen, um die Darstellung der Methoden nicht zu unterbrechen (sie sind in einem separat erhältlichen Beweis-Band zusammengestellt). Obwohl dieses Material primär als Ergänzung und spätere Referenz für die an der

Vorlesung Teilnehmenden gedacht ist, eignet es sich auch bedingt zum Selbststudium, wofür es allerdings nicht primär konzipiert ist.

Die Veranstaltung Stochastik umfaßt vier Stunden Vorlesung sowie zwei Stunden

Übungen pro Woche. Sie gehört zum Grundstudium (Bachelor) der Mathematik und

soll eine erste und relativ elementare Einführung in dieses Gebiet geben, wobei sie

nur auf Vorkenntnisse aus der Analysis und Linearen Algebra zurückgreifen kann.

Eine Vertiefung und Ausweitung des Stoffs im Rahmen von Veranstaltungen zur

Maß- und Wahrscheinlichkeitstheorie sowie zur Statistik sind erst im Hauptstudium

(Master) vorgesehen. Im Lehramts-Studiengang dagegen ist die Stochastik typischerweise die einzige Veranstaltung zu diesem Thema, und dies hat auch die vorliegende Stoffauswahl mitgeprägt, insbesondere die ausführliche Behandlung von statistischen Verfahren im Zusammenhang mit der Binomial- und der Poisson-Verteilung.

Um trotz der elementaren Vorkenntnisse auch ausgewählte (und wichtige) fortgeschrittene Methoden behandeln zu können (z.B. stetige Verteilungen, oder asymptotische Konfidenzbereiche und Tests) wurden einige in der Vorlesung nicht beweisbare Resultate ohne Beweis zitiert (z.B. die Existenz eines Wahrscheinlichkeitsmaßes zu vorgegebener Dichte oder der Zentrale Grenzwertsatz).

Der Stoff ist selbstverständlich aus vielen Quellen zusammengestellt, obwohl diese

im laufenden Text nicht explizit erwähnt werden (wie dies auch bei Lehrbüchern

gängige Praxis ist). - Zunächst werden einleitend (Kapitel 0) einige Anwendungsbeispiele vorgestellt, die der Motivation der später zu behandelnden statistischen

Methoden dienen. Die dort auftretenden Fragen werden zum Teil erst gegen Ende

des Kurses beantwortet. Danach werden (Kapitel 1) Wahrscheinlichkeitsräume

axiomatisch eingeführt und einige konkrtete Verteilungen behandelt. Hierzu werden zwar a-Algebren allgemein definiert aber als konkrete a-Algebren auf überabzählbaren Räumen werden nur die Bore1-Mengen auf der reellen Achse lR (und

später im lR n) betrachtet. Als Wahrscheinlichkeitsmaße auf überabzählbaren Räumen werden auf lR (und lR n) auch nur solche betrachtet, die durch eine Dichte gegeben sind (wobei die Charakterisierung einer Verteilung durch ihre Dichte nicht

bewiesen wird). Da das Lebesgue-Integral hier noch nicht vorausgesetzt werden

kann, beschränken wir uns zuerst auf das Riemann-Integral für stetige Dichten und

erweitern dies dann auf Dichten mit höchstens endlich vielen Unstetigkeitsstellen,

was für die Betrachtungen hier ausreicht.

Stochastik

Vorwort- 2

16.3.16

Im Anschluß daran werden Zufallsvariablen (Kapitel 2), bedingte Wahrscheinlichkeiten und stochastische Unabhängigkeit (Kapitel 3 und 5), sowie Verteilungsfunktionen (Kapitel 4) behandelt. Unter Verwendung von Faltungen werden (Kapitel 6)

neue Verteilungen eingeführt, und das Auftreten von Poisson-Verteilungen wird aus

einem Poisson-Prozess hergeleitet.

Der Erwartungswert wird hier (Kapitel 7) nicht für beliebige reelle Zufallsvariablen,

sondern getrennt definiert für Zufallsvariablen die entweder diskret sind oder eine

Dichte haben. Die grundlegenden Eigenschaften des Erwartungswerts werden zwar

allgemein formuliert, aber teilweise nur für diskrete bzw. stetige Zufallsvariablen

separat bewiesen. Neben der Varianz wird auch die Schiefe einer Verteilung sowie

die Covarianz und Korrelation zweier Zufallsvariablen behandelt.

Als Einführung in statistische Grundtechniken wird (Kapitel 8) das Schätzen von

Erwartungswert und Varianz behandelt. Die Frage nach den asymptotischen Eigenschaften der Schätzer dient als Motivation für stochastische Konvergenzbegriffe.

Neben dem (schwachen) Gesetz der großen Zahlen wird der hier nicht bewiesenene

Zentralen Grenzwertsatz für unabhängige und identisch verteilte Zufallsvariablen

(Kapitel 9) behandelt. Hierbei wird auch die später noch verwendete Abschätzung

von Berry-Esseen ohne Beweis angegeben. In diesem Zusammenhang werden auch

noch weitere Grenzwertsätze für spezielle Verteilungen erwähnt.

Als zweites statisches Verfahren werden (Kapitel 10-12) Konfidenzgrenzen für den

Erwartungswert betrachtet. Ausgehend von den exakten Grenzen bei Normalverteilung werden asymptotische Grenzen bei beliebiger Verteilung eingeführt. Im Anschluß daran werden Konfidenzgrenzen für die Wahrscheinlichkeit einer Binamialverteilung (Kapitel 11) und für den Erwartungswert einer Poisson-Verteilung (Kapitel 12) behandelt. Hierbei werden sowohl die exakten (und konservativen) als auch

die asymptotischen Grenzen ausführlich hergeleitet und angewandt.

Schließlich wird (Kapitel 13) der statistische Test am Beispiel des Tests von (einund zweiseitigen) Hypothesen über eine Wahrscheinlichkeit relativ ausführlich eingeführt, wobei sowohl auf den exakten als auch auf den asymptotischen Test eingegangen wird. Die entsprechenden Tests über den Erwartungswert der Poisson-Verteilung werden dann etwas knapper behandelt (Kapitel 14). Eine nahtlose Weiterführung und Vertiefung der hier behandelten statistischen Verfahren findet sich

meinem Skript zur Einführung in die Statistik und zur anwendungsorientierten Veranstaltung Statistik in den Naturwissenschaften (vgl. Literaruturhinweise).

Neben kleineren Korrekturen und Ergänzunzen unterscheidet sich diese Auflage

von der letzten Version (Februar 2009) in den Abschnitten 4.9 (überarbeitet), 4.10

(neu), 9.1 (Folgen von Zufallsvariablen jetzt mit gemeinsamem Definitionsbereich) sowie dem neuen AnhangS (Statistik-Funktionen in Tabellenkalkulationen).

Erfahrungsgemäß enthält das Skript - trotz Korrekturlesen - noch Druckfehler. Bevor man daher am eigenen Verständnis zweifelt, sollte man auch einen Fehler im

Skript in Erwägung ziehen. Für Hinweise auf Druckfehler oder andere Kommentare

pere-Mail ([email protected]) bin ich dankbar.

Bremen, am 16. März 2016

Gerhard Osius

Stochastik

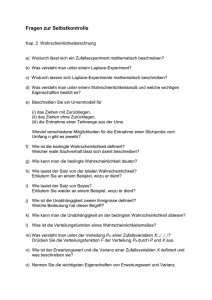

Inhalt

Die mit

* markierten

Inhalt- 1

16.3.16

(Seiten pro Kapitel)

Kapitel - Seite

Abschnitte behandeln speziellere Themen und können übersprungen

werden.

0.

Einleitung und Anwendungsbeispiele

0.1 Leukämiefälle im Umkreis des Kernkraftwerks Krümmel

0.2 Asbestmessungen in Schulgebäuden

0.3 Wahlumfragen

0.4 Klinische Studie

1.

Wahrscheinlichkeitsräume

1.0 Mengensysteme

1.1 Wahrscheinlichkeitsmaße

1.2 Endliche Wahrscheinlichkeitsräume

1.2.1 Diskrete Gleichverteilung

1.2.2 Bernoulli-Verteilung

1.2.3 Binomial-Verteilung

1.2.4* Relative Häufigkeiten

1.3 Abzählbare Wahrscheinlichkeitsräume

1.3.1 Poisson-Verteilung

1.4 Reelle Wahrscheinlichkeitsmaße mit Dichten

1.4.1 Normal-Verteilung

1.4.2 Exponential-Verteilung

1.4.3 Stetige Gleichverteilung

(21)

1-3

1-7

1-9

1 - 10

1 - 10

1- 11

1- 11

1 - 12

1 - 13

1 - 14

1 - 18

1- 20

1- 20

2.

Zufallsvariablen und ihre Verteilungen

2.1 Indikatorfunktion

2.2 Definition einer Zufallsvariable und ihrer Verteilung

2.3 Reelle Zufallsvariablen

2.3.1 Augensumme zweier Würfel

Bedingte Wahrscheinlichkeit und stochastische Unabhängigkeit

3.1 Bedingte Wahrscheinlichkeit

3.1.1 Wartezeiten und Exponential-Verteilung

3.2 Stochastische Unabhängigkeit von Ereignissen

3.3 Produkte diskreter Wahrscheinlichkeitsräume

3.3.1 Bernoulli-Wiederholungen und Binomialverteilung

3.3.2 Produktmaß von Gleichverteilungen

(6)

2- 1

2- 1

2-3

2-6

(10)

3- 1

3-4

3-5

3-7

3-9

3- 10

3.

4.

Verteilungsfunktionen und Dichten

4.1 Verteilungsfunktionen reeller Zufallsvariablen

4.1.1 * Quasi-Inverse einer Verteilungsfunktion

4.2 Verteilungsfunktionen diskreter Zufallsvariablen

4.2.1 Einpunkt-Verteilung, Dirac-Verteilung

4.2.2 Binomial-Verteilung

4.2.3 Poisson-Verteilung

(9)

0- 2

0-4

0-6

0-8

(38)

4-1

4-2

4-3

4-4

4-4

4-4

Stochastik

16.3.16

Stetige Zufallsvariablen mit Dichten

4.3.1 Stetige Gleichverteilung

4.3.2 Exponential-Verteilung

4.3.3 Normal-Verteilung

4.4 Dichten transformierter Zufallsvariablen

4.4.1 Lineare Transformationen stetiger Zufallsvariablen

4.4.2 Absolutbetrag und Potenzen stetiger Zufallsvariablen

4.4.3 Log-Normalverteilung

4.4.4 Weibull-Verteilung

4.4.5* Erzeugung von Zufallszahlen

4.5 Zufallsvektoren

4.5.1 Mehrdimensionale Borel-Mengen

4.5.2 Die Verteilung von Zufallsvektoren

4.6 Diskrete Zufallsvektoren

4.6.1 Multinomial-Verteilung

4.7 Stetige Dichten für zweidimensionalen Verteilungen

4.7.1 Zweidimensionale Normal-Verteilung

4.8* Dichten mehrdimensionaler Verteilungen

4.8.1 Multivariate Normal-Verteilung

4.9 Endliche Produkte von Wahrscheinlichkeitsräumen

4.9.1 Spezialfall: reelle Wahrscheinlichkeitsräume

4.9.2 Allgemeiner Fall: beliebige Wahrscheinlichkeitsräume

4.10 Abzählbare Produkte von Wahrscheinlichkeitsräumen

4.3

5.

Stochastische Unabhängigkeit von Zufallsvariablen

Stochastische Unabhängigkeit diskreter Zufallsvariablen

5.1.1 Randomisierte klinische Vergleichsstudie

5.1.2 Geometrische Verteilung

5.2

Unabhängigkeit bei stetigen Zufallsvariablen mit Dichten

5.2.1 Normalverteilte Zufallsvariablen

5.3 Unabhängigkeit bei Zufallsvektoren

5.1

6.

Faltungen von Verteilungen

6.1

Faltung diskreter Verteilungen

6.1.1 Binomial-Verteilung

6.1.2 Multinomial-Verteilung

6.1.3 Faltung von Poisson-Verteilungen

6.1.4 Negative Binomial-Verteilung

6.2 Faltung stetiger Verteilungen mit Dichten

6.2.1 Faltung von Normal-Verteilungen

6.2.2 Faltung von Exponential- und Gamma-Verteilungen

6.2.3 Poisson-Verteilung und Poisson-Prozeß

6.2.4 Elementare Eigenschaften der Gamma-Funktion

6.3 Arithmetische Operationen von Zufallsvariablen

7.

Parameter von Verteilungen: Erwartungswert, Varianz, Schiefe,

Covarianz und Korrelation

Inhalt- 2

4-6

4-9

4-9

4-9

4- 11

4- 12

4- 13

4- 16

4- 18

4- 19

4- 19

4- 20

4- 21

4- 22

4- 22

4- 23

4- 27

4-30

4-32

4-33

4-33

4-34

4-36

(10)

5-3

5-4

5-5

5-8

5-8

5-9

(12)

6-1

6- 2

6- 2

6- 3

6-4

6-6

6-6

6-7

6-9

6- 10

6- 11

(32)

Stochastik

16.3.16

7.1

7.2

7.3

Definition des Erwartungswerts

Grundlegende Eigenschaften des Erwartungswerts

Erwartungswerte spezieller Verteilungen

7.3.1 Erwartungswerte spezieller diskreter Verteilungen

7.3.2 Erwartungswerte spezieller stetiger Verteilungen

7.3.3 Cauchy-Verteilung

7.3.4 Anwendung: Das Sammlerproblem

7.4 Varianz und Standardabweichung

7.5

Varianzen spezieller Verteilungen

7.5.1 Varianzen spezieller diskreter Verteilungen

7.5.2 Varianzen spezieller stetiger Verteilungen

7.6* Symmetrie und Schiefe

7.7 Die Ungleichungen von Chebyshev und Markov

7.7.1 Normalverteilung

7.7.2* Empirische Verteilung

7.8* Covarianz, Korrelation und linearer Zusammenhang

7.8.1 Die Covarianz

7.8.2 Der Korrelationskoeffizient

7.8.3 Die zwei-dimensionale Normal-Verteilung

7.8.4 Linearer Zusammenhang und Regressionsgerade

Inhalt- 3

7- 1

7-7

7-9

7-9

7- 10

7- 11

7- 12

7- 15

7- 17

7- 17

7- 17

7- 18

7- 23

7- 24

7- 25

7- 26

7- 26

7- 28

7 - 29

7 - 29

8.

Schätzung von Erwartungswert und Varianz

(13)

8.1 Schätzung des Erwartungswerts

8-2

8.2 Spezielle Verteilungsmodelle

8 -4

8.2.1 Das Binomial-Verteilungsmodell

8 -4

8.2.2 Das Poisson-Verteilungsmodell

8 -5

8 -5

8.2.3 Das Normal-Verteilungsmodell

8.2.4 * Das Gamma-Verteilungsmodell

8 -5

8.2.5* Das Cauchy-Verteilungsmodell

8-6

8.3* Schätzung der Varianz

8 -6

8.3.1 Schätzung der Varianz bei bekanntem Erwartungswert

8 -6

8.3.2 Schätzung der Varianz bei unbekanntem Erwartungswert

8- 7

8.3.3 Verteilung der Varianz-Schätzer im Normal-VerteilungsmodellS - 8

8 - 10

8.4* Schätzung der Schiefe

8.5* Schätzung der Korrelation und Regressionsgeraden

8 - 10

9.

Schwaches Gesetz der großen Zahlen und Zentraler Grenzwertsatz

9.1

Konvergenz nach Wahrscheinlichkeit und

Schwaches Gesetz der großen Zahlen

9.1.1 Eigenschaften der Konvergenz nach Wahrscheinlichkeit

9.1.2 Stochastische Konvergenz und Konsistenz von Schätzern

9.2 Verteilungskonvergenz und Zentraler Grenzwertsatz

9.3 Grenzwertsätze für Binomial-Verteilungen

9.3.1 Die Normal-Approximation der Binomial-Verteilung

9.3.2 Anwendung: Wahlumfragen

9.3.3 Die Poisson-Approximation der Binomial-Verteilung

(36)

9 -3

9 -5

9 -6

9 -7

9 - 12

9 - 12

9 - 16

9 - 18

Stochastik

9.4*

9.5*

9.6*

9.7*

9.8

16.3.16

Inhalt- 4

9- 20

Grenzwertsatz für Poisson-Verteilungen

9- 21

Grenzwertsatz für negative Binomial-Verteilungen

9- 22

Grenzwertsatz für Gamma-Verteilungen

9- 23

Eigenschaften der Konvergenz nach Verteilung

9- 25

Hypergeometrische Verteilungen

9- 25

9.8.1 Wahlumfragen

9- 26

9.8.2 Zufälliges Ziehen mit und ohne Zurücklegen

9.8.3 Definition und Eigenschaften der hypergeometrischenVerteilung

9 - 28

9.8.4 Anwendungen und Schätzungen

9 - 29

9.8.5 Binamial-Approximation der hypergeometrischen Verteilung 9 - 30

9.8.6 Die multivariate hypergeometrische Verteilung

9 - 31

10. Konfidenzgrenzen für den Erwartungswert

10.1 Exakte Konfidenzgrenzen für den Erwartungswert einer

Normal-Verteilung mit bekannter Varianz

10.2* Asymptotische Konfidenzgrenzen für den Erwartungswert einer

beliebigen Verteilung

10.3* Exakte Konfidenzgrenzen für den Erwartungswert einer

Normal-Verteilung mit unbekannter Varianz

(13)

10-3

10- 7

10- 10

11

Konfidenzgrenzen für eine Wahrscheinlichkeit

11.1 Die exakte obere Konfidenzgrenze nach Clopper-Pearson

11.2 Die exakte untere Konfidenzgrenze nach Clopper-Pearson

11.3 Das exakte zweiseitige Konfidenzintervall

11.4 Berechnung der exakten Grenzen

11.5 Die F-Verteilung

11.6 Asymptotische (approximative) Konfidenzgrenzen

11.7 Grobe asymptotische (approximative) Konfidenzgrenzen

(19)

11 - 2

11-4

11 - 5

11 -6

11 -8

11-11

11- 16

12

Konfidenzgrenzen für den Erwartungswert einer Poisson-Verteilung

12.1 Konstruktion der exakten oberen Konfidenzgrenze

12.2 Konstruktion der exakten unteren Konfidenzgrenze

12.3 Konstruktion des exakten zweiseitigen Konfidenzintervalls

12.4 Berechnung der exakten Grenzen

12.5* Asymptotische (approximative) Konfidenzgrenzen

12.6 Anwendung: Asbestmessungen in Schulgebäuden

12.7 Konfidenzgrenzen bei unabhängigen Wiederholungen

(12)

12 - 1

12-3

12-4

12 - 5

12-6

12- 10

12- 12

13. Testen von Hypothesen über Wahrscheinlichkeiten

13.1 Der exakte einseitige Binomial-Test mit oberer Alternative

13.1.1 Statistische Tests

13.1.2 Fehlerrisiken und Testschärfe

13.1.3 Der optimale Test zum vorgegebenen Niveau

13.1.4 Analyse des Fehlerrisikos 2. Art

13.2 Der exakte einseitige Binomial-Test mit unterer Alternative

13.3 Der exakte zweiseitige Binomial-Test

(32)

13-3

13-4

13- 5

13-8

13- 12

13- 14

13- 16

Stochastik

16.3.16

13.4 Asymptotische Tests

13.4.1 Der asymptotische einseitige obere Binomial-Test

13.4.2 Der asymptotische einseitige untere Binomial-Test

13.4.3 Der asymptotische zweiseitige Binomial-Test

13.5 Planung des erforderlicher Stichproben-Mindestumfangs

13.5.1 Der einseitige obere Test

13.5.2 Der einseitige untere Test

13.5.3 Der zweiseitige Test

14.* Tests für den Erwartungswert der Poisson-Verteilung

14.1 Der einseitige Poisson-Test mit oberer Alternative

14.1.1 Der exakte einseitige obere Poisson-Test

14.1.2 Der asymptotische einseitige obere Poisson-Test

14.2 Der einseitige Poisson-Test mit unterer Alternative

14.2.1 Der exakte einseitige untere Poisson-Test

14.2.2 Der asymptotische einseitige untere Poisson-Test

14.3 Anwendung: Asbestmessungen in Schulgebäuden

14.4 Der zweiseitige Poison-Test

14.4.1 Der exakte zweiseitige Poisson-Test

14.4.2 Der asymptotische zweiseitige Poisson-Test

14.5 Poisson-Tests bei unabhängigen Wiederholungen

Inhalt- 5

1313131313131313-

19

19

24

26

28

29

30

31

(14)

14- 1

14- 2

14-3

14-4

14- 5

14-6

14- 7

14- 12

14- 12

14- 13

14- 14

Literaturhinweise

(1)

AnhangS: Statistik-Funktionen in Tabellenkalkulationen

(2)

Anhang T: Statistische Tabellen

Verteilungsfunktion der Normalverteilung N(0,1)

Quantile der N( 0,1) und t- Verteilung

Quantile der Chiquadrat-Verteilung

Quantile der F- Verteilung

Index

(12)

T -1

T- 3

T- 5

T- 8

(6)

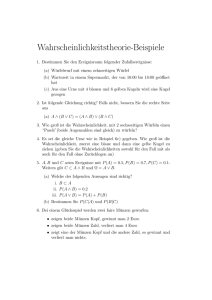

Anwendungsbeispiele

0.

1.10.08

0-1

Einleitung und Anwendungsbeispiele

Problem: Experimentelle oder beobachtete Daten sind nicht exakt reproduzierbar.

Ursachen hierfür sind z.B. Variahilitäten (der Untersuchungsobjekte oder Versuchsbedingungen), nicht kontrollierbare Meßfehler etc.

Lösung: Das Einbeziehen des Zufalls in die ModelEerung und Auswertung.

Stochastik ist die mathematische Disziplin zur ModelEerung und Untersuchung des

Zufalls. Sie umfaßt die Wahrscheinlichkeitstheorie und die darauf aufbauende mathematische (deduktive) Statistik. Die Wahrscheinlichkeitstheorie beschäftigt sich mit:

• der Konstruktion von Modellen für stochastische Vorgänge:

Zufallsexperimente oder Zufallsbeobachtungen,

• der Analyse solcher (stochastischer) Modelle,

• der Berechnung von Wahrscheinlichkeiten für interessierende Ereignisse.

Zu den Aufgaben der Statistik zählt die Planung und Auswertung konkreter Studien

(Experimente, Beobachtungen). Die Auswertung beschäftigt sich primär mit

• dem Schätzen unbekannter Modell-Parameter,

• dem Testen von Hypothesen über Modell-Parameter.

Und bei der Planung stehen im Vordergrund

• Auswahl eines geeigneten Auswertungs-Modells nebst zugehörigem Design der

Datenerhebung,

• Kalkulation des erforderlichen Stichprobenumfangs, der eine zuverlässige statistische Auswertung erlaubt.

Zu Beginn wollen wir einige typische Anwendungssituationen für stochastische

Fragestellungen kennenlernen, die einerseits als Motivation der teilweise sehr abstrakten Methoden dienen sollen und andererseits später als Anwendungsbeispiele

wieder aufgegriffen werden. Hierbei werden auch schon Begriffe verwendet (z.B. Zufallsvariablen, Erwartungswert und spezielle Verteilungen), die von der Schule be-

kannt sein sollten und hier erst später formal definiert werden.

Anwendungsbeispiele

0.1

0-2

1.10.08

Leukämiefälle im Umkreis des Kernkraftwerks Krümmel

Der Kinderarzt M. Demuth berichtet in dem Preprint Leukämiemorbidität bei Kindern in der direkten Umgebung des Kernkraftwerks Krümel (Kassel 1991, Tabelle 1)

von Leukämie-Erkrankungsfällen bei Kindern von 0 bis 14 Jahren in der Umgebung

des Kernkraftwerks Krümmel und vergleicht die beobachteten Leukämiefälle mit

den (unter Berücksichtigung der Bevölkerungsdichte) nach bundesdeutschem

Durchschnitt zu erwartenden Fällen.

Region

Zeitraum

Leukämiefälle

beobachtet

erwartet

Samtgemeinde Elbmarsch

1990

1990-1991

1980- 1990

1980-1991

3

4

4

5

0.06

0.13

0.68

0.75

5-km-Radius um das Kernkraftwerk

Krümme I

1990

1990-1991

1980- 1990

1980-1991

3

5

4

6

0.21

0.44

2.30

2.53

Tabelle 1:

Leukämieerkrankungsfälle bei Kindern von 0-14 Jahren in der Umgebung

des Kernkraftwerks Krümel (nach Demuth 1991).

Die statistische Analyse dieser Daten soll klären, ob die Abweichungen der beobachteten Leukämiefälle von den erwarteten Fällen noch durch den Zufall zu erklären

sind, oder ob bereits eine statistisch signifikante Erhöhung der Leukämie-Inzidenz

vorliegt (Die Frage nach einem möglichen kausalen Zusammenhang zum Kernkraftwerk kann die Statistik nicht beantworten!). Hierbei geht man davon aus, daß die

beobachtete Anzahl von Fällen (innerhalb einer Region und eines Zeitraums) eine

Zufallsvariable X mit einer Poisson-Verteilung ist (vgl. Abb. 1), und vergleicht ihren

Erwartungswert p, = E(X) mit dem nach Bundesdurchschnitt zu erwarteten Wert p,

0

(einer vergleichbaren Bevölkerungsgruppe). Ein solcher Vergleich kann durch eine

statistischen Test erfolgen, bei dem man sich aufgrund der beobachteten Realisie-

rung x von X zwischen den folgenden beiden Hypothesen entscheidet

Nullhypothese:

p,

< p, 0

Alternative:

(keine Erhöhung gegenüber Bundesdurchschnitt) 1

(Erhöhung gegenüber Bundesdurchschnitt).

Eine andere (äquivalente) Möglichkeit des Vergleich besteht darin, daß man aus der

Beobachtung x eine untere Konfidenzgrenze (t (x) für den Erwartungswert p, beu

stimmt und sich im Fall (tu(x)

< p, 0 für keine Erhöhung (Nullhypothese) entscheidet.

Anwendungsbeispiele

0-3

1.10.08

Pofs(~)-VerteHllng :

I' ~

P ois(~)- Verte1 1 ung :

0.44

70%

1.1 ~

2.53

70%

60%

60%

50%

50%

Qj

-"'

J::.

..240%

c·a:;

.J::.

<>

l!!30%

_r_

~

20%

20%

10%

10'/o

0

2

4

Anzahl

6

8

10

0

2

4

6

8

10

Anzahl

Abb .. 1: Histogramme der Poisson-Verteilung für zwei Erwartungswerte aus Tabelle 1.

Schließlich kann man auch direkt überprüfen, wie wahrscheinlich (bzw. unwahrscheinlich) es ist, daß die beobachtete oder eine noch höhere Anzahl von Leukämie-

fällen auftritt, wenn man den Bundesdurchschnitt zugrunde legt. Hierzu berechnet

man für die Beobachtung x die Poisson-Wahrscheinlichkeit P{ X> x} unter der Annahme 1-L = 1-Lo' und wenn diese Wahrscheinlichkeit zu gering ist, glaubt man nicht

mehr an einen Zufall.

Die erforderlichen Methoden zur Analyse obiger Daten werden im Laufe des Kurses

eingeführt.

Anwendungsbeispiele

0.2

1.10.08

0-4

Asbestmessungen in Schulgebäuden

Bei einer Asbestmessung soll festgestellt werden, wie hoch die Asbestfaserkonzentration). [in Fasern pro m 3 ] in dem untersuchten Innenraum ist, und ob der zulässige Grenzwert >. eingehalten wird oder nicht. Hierzu wird die Raumluft von ei0

nem Kompressor durch einen Filter angesaugt, in dem die Asbestfasern hängen

bleiben. Ein Teil des Filters wird dann mikroskopisch ausgewertet, um die Asbestfasern dort zu zählen. Die Anzahl X der Asbestfasern in dem ausgewerteten Volumenanteil V [in m 3 ] ist dann eine Zufallsvariable 1 die (in guter Näherung) eine Poisson-Verteilung hat (vgl. Abb. 2). Ihr Erwartungswert p, = E(X) ist die im Volumen V

erwartete Anzahl von Fasern und die erwartete Asbestfaserkonzentration [in Fasern

pro m 3 ] ergibt sich zu ). = p, /V Ausgehend von einer beobachteten Anzahl x (als

Realisierung von X) hat die statistische Analyse folgende Ziele:

• Schätzung der Asbestfaserkonzentration

A,

• Bestimmung einer oberen Konfidenzgrenze ~ (x) für..\,

0

• Überprüfung, ob ein Grenzwert >. eingehalten wird oder nicht, d.h. Durchfüh0

rung eines statistischen Tests zur Entscheidung zwischen den Hypothesen

Nullhypothese:

A < >.

Alternative:

A > >.

0

0

(Grenzwert wird eingehalten) 1

(Grenzwert wird überschritten).

In der Tabelle 2 sind Auszüge der Original-Protokolle von Messungen aus dem Jahr

1989 wiedergegeben. Die Methoden zur Berechnung der Vertrauens- bzw. Konfidenzgrenzen und die der "Bewertung" zu Grunde liegenden statistischen Tests werden in

den Kapiteln 12 und 14 behandelt und in 12.6 bzw. 14.3 auf diese Daten angewandt.

Anwendungsbeispiele

0-5

1.10.08

Me ß b e d i n g u n g e n

4.28 mA3

Volumendurchsatz (16.0 °C, 1013 hPa)

effektive Filterfläche

ausgewerte Filterfläche

350 Bildfelder bei 2500facher Vergrößerung

380

nunA2

l.36mmA2

Me ß e r g e b n i s s e

insgesamt gezählte Fasern

0

Asbestfaser - Anzahlkonzentration

0

Fasern/mA3

1 95

Pasern/m"'3

obere Grenze des 95% - Vertrauensintervalls

Nachweisgrenze (Poisson-Statistik)

B e w e r t u n g

In der geprüften Luftmenge wurden keine Asbestfasern gefunden.

Die Nachweisgrenze liegt nach den Gesetzen der Poiseon - Statistik

u n t e r

400 Fasern/mA3. (Asbest-Richtlinie Mai 1989)

M e ß b e d i

Volumendurchsatz (16.0

oc,

n g u n g e n

3. 65 mA3

1013 hPa)

effektive Filterfläche

ausgewerte Filterfläche

420 Bildfelder bei 2500facher Vergrößerung

Me ß e r g e b n i

380

mmA2

1. 64 mmA2

s s e

insgesamt gezählte Fasern

2

Asbestfaser-Anzahlkonzentration

127

Fasern/rn" 3

obere Grenze des 95 %- Vertrauensintervalls

(Poisson-Statistik)

460

Fasern/m"' 3

B e w e r

t

u n g

Die gemessene Asbestfaser-Konzentration liegt

empfohlenen Grenzwert von 500 Fasern/m" 3.

u n t e r

dem

Mit 95%- iger Wahrscheinlichkeit wird nach der Poiseon-Statistik

der empfohlene obere Grenzwert von 1000 um 540 Fasern/m" 3

(Erwartungswert)

u n t e r s c h r i t t e n.

M e ß b e d i

Volumendurchsatz (16.0

oc,

n g u n g e n

1013 hPa)

effektive Filterfläche

ausgewerte Filterfläche

360 Bildfelder bei 2500facher Vergrößerung

M e ß e r g e b n i

s s e

insgesamt gezählte Fasern

8

52 0

Asbestfaser - Anzahlkonzentration

obere Grenze des 95%-Vertrauensintervalls

(Poisson - Statistik)

B e w e r

380

mm"2

1.40 mm"2

t

1, 024

Fasern/rn~

3

Fasern/m" 3

u n g

Die gemessene Asbestfaser-Konze.ntration liegt unter

dem geforderten Grenzwert von 1000 Fasern/m3 , bezogen auf

den Zustand ~ der Sanierung .

Tabelle 2: Protokollaus4züge von Asbestmessungen in Schulgebäuden {1989) .

Anwendungsbeispiele

0-6

1.10.08

Pois(IJ}Verteil llng~

IJ

=4,00

Pois(IJ)-Verteilung:

20%

20%

15%

15%

ijj

'ijj

~

~

_.!2

_Q

]10%

f10%

u = 8,00

.r:

.r_

c

c::

u

0

!!!

!/)

..c

.r_

"'

3:

s:"'

5%

5%

0%

~

I

0

5

10

0%

15

20

25

k

1

0

5

Anzahl

10

15

20

2.5

Anzahl

Abb. 2: Poisson-Verteilung der Anzahl von Asbestfasern zm Volumen V für zwez

verschiedene Erwartungswerte f-L·

0.3

Wahlumfragen

Um den unbekannten Stimmanteil p einer bestimmten Partei zu schätzen, werden n

unabhängige Befragungen von Wahlberechtigten durchgeführt. Die Anzahl X der

Befürworter dieser Partei unter den n Befragten ist eine Zufallsvariable mit Binomialverteilung B(n,p). Für eine "kleine" Partei (z.B. Die Grünen) mit p = 8% und

eine "große" Partei (z.B. CDU) mit p = 40% sind die Wahrscheinlichkeiten für die

möglichen Ergebnisse einer kleinen Umfrage mit n = 100 (z.B. eine telefonische

Blitz-Umfrage) in Abb. 3 graphisch dargestellt.

Die Ziele einer Wahlumfrage (vgl. Abb. 4) sind:

• Schätzung des Stimmanteil p,

• Bestimmung einer unteren Konfidenzgrenze

• Überprüfung, ob ein Mindestanteil p

0

pu für den Stimmanteil p,

überschritten wird, z.B. p = 5% bzw.

0

p =50% im Hinblick auf die 5%-Hürde bzw. eine absolute Mehrheit. Der zuge0

hörige statistische Tests soll sich für eine der beiden Hypothesen entscheiden

Nullhypothese:

Alternative:

< p0

p>p

0

p

(Stimmanteil nicht über p ) 1

0

(Stimmanteil über p ).

Die Methoden hierzu werden im Laufe des Kurses erarbeitet.

0

Anwendungsbeispiele

n = 100

Dichte von X mit B(n,p)-Verteil ung:

p=

15%

0-7

1.10.08

•

•

p= 40°!.

·"äl10%

-"'

.<:

.!.!

c:

·~

.r::

r.>

"'

~

"'

!; 5%

0

~

rh.

..I

0%

5

10

15

20

25

30

Anzahl

~

35

40

45

50

55

60

65

Abb. 3: Dichten der B(n,p)-Verteilung für n = 100 und p = 8% bzw. p = 40%.

Die markierte Fläche links entspricht der Wahrscheinlichkeit P{ X< 5 }, daß der

Stimmanteil in der Stichprobe < 5% ist, obwohl der wahre Anteil in der Bevölkerung sogar p = 8% beträgt. Und die markierte Fläche rechts ist die Wahrscheinlichkeit P{ X> 50}, daß die Partei in der Umfrage mindestens 50% hat, obwohl ihr

wahrer Anteil nur p = 40% ist (siehe auch Abschnitt 9.3.2).

Abb.

4 (Sonntagsfrage):

Bei einer Wahlumfrage von Infratest

dimap im Februar 2002 ergaben sich

bei n = 1300 Befragungen die nebenstehenden prozentualen Anteile (in

Klammern: Änderungen gegenüber

dem Vormonat). Neben diesen Anteilen

ist man an unteren Konfidenzgrenzen

interessiert, die den Stimmanteil in der

Gesamtbevölkerung zuverlässig abschätzen. Für die kleinen Parteien Die Grünen bzw. die FDP will man z.B. wissen,

ob sie trotz ihres Anteils von 6% bzw.

9% in der Umfrage bei einer Wahl an

der 5%-Hürde scheitern würden (siehe

auch Abschnitt 13.4.1).

Quelle: www.infratest-dimap.dejsonntagsfrage

Sonntagsfrage

Welche Per!GI wCirdon Sie IYthklo, WQM

am kan mmden Som ~ BundE>Siagsw<hl w:.e?

SoFtStg a

r.T:nl

~

6

(·1)

s

I)

Untersuchungsanlage

Grundgesamtheit Wahlberechtigte Bevölkerung 1n Deutschland

ab 18 Jahren

Stichprobe: Reprasentative Zufallsauswah i/Randomstichprobe

Erhebungsverfahren. Computerges!Otzte Telefonlf\terv!ews (CATIJ

Fallzahl: 1.300 Befragte (900 West, 400 Ost)

Erhebungszeitraum: 2 1. • 26. Februar 2002

Fehlertole ranz:. 1 ,2 ' bis 2.7" ' Prozentpunkte

• bei einem Anteilswert von 5%

.. bei einem Anteilswert von 50%

DurchfC hrendes Institut: Infratest dimap

Anwendungsbeispiele

0.4

0-8

1.10.08

Klinische Studie

Zur Überprüfung der Wirksamkeit einer neuen - und typischerweise noch nicht zugelassenen - Behandlung einer spezifischen Krankheit wird eine klinische Studie

mit n erkrankten Patienten durchgeführt (die hierfür ihr Einverständnis erklärt haben). Der Behandlungserfolg wird vorher gerrau definiert und kann z.B. das Überleben

des Patienten nach einem Herzinfarkt oder die Rückbildung eines inoperablen Tumors sein. Von primärem Interesse ist dabei die unbekannte Erfolgswahrscheinlichkeit p der neuen Behandlung, d.h. die Wahrscheinlichkeit, daß sich bei einem zufällig ausgewählten Patienten der Behandlungserfolg einstellt, sowie der Vergleich

von p mit der bekannten Erfolgswahrscheinlichkeit p einer Standardtherapie. Die

0

Ziele einer solchen der Studie sind daher:

• Schätzung der Erfolgswahrscheinlichkeit p,

• Bestimmung einer unteren und oberen Konfidenzgrenze

pu und p0

für p,

• Überprüfung, ob die neue Behandlung die gleiche Erfolgswahrscheinlichkeit

hat wie die Standardbehandlung oder nicht, d.h. der zugehörige statistische Tests

soll sich für eine der beiden Hypothesen entscheiden:

Nullhypothese:

p= p

Alternative:

p :;= p

0

0

(kein Unterschied bei neuer und Standardbehandlung) 1

(Unterschied bei neuer und Standardbehandlung).

Die Anzahl X der Patienten, bei denen der Behandlungserfolg eingetritt, ist eine

Zufallsvariable mit Binomialverteilung B(n,p). Als konkretes Beispiel betrachten

wir jetzt eine neue Chemotherapie bei einem inoperablen Tumor, wobei die Rückbildung des Tumors als Erfolg angesehen wird. Die Standardtherapie habe nur eine

Erfolgsrate von p = 10%, und aufgrund von Tierexperimenten erhofft man sich

0

eine Erfolgsrate der neuen Therapie von p = 30%. Die zugehörigen Binomialverteilungen sind in Abb. 5 dargestellt, sowohl für eine kleine Studie mit nur n = 25 als

auch für eine größere Studie mit n = 100 Patienten. Hierbei fällt auf, daß sich beide

Binomialverteilungen für n = 25 wesentlich stärker überlappen als bei n = 100. Aus

diesen - und anderen intuitiv naheliegenden Gründen - werden die Schlußfolgerungen (für obigen Ziele) mit wachsendem Studienumfang n immer zuverlässiger.

Während es aus statistischer Sicht optimal ist, ein möglichst großes n vorzusehen,

sprechen andere Gründe wie z.B. hohe Kosten oder noch unbekannte Risiken der

neuen Therapie für ein möglichst kleines n. Zur Planung einer klinischen Studie gehört daher ganz wesentlich auch eine statistische Fallzahlkalkulation, bei der das

Anwendungsbeispiele

0-9

1.10.08

kleinste n bestimmt wird, mit dem die Studienziele noch hinreichend zuverlässig erreichbar sind (vgl. hierzu Abschnitt 13.5).

Abb. 5:

Dichte von X mit B(n ,p)-Vertellung :

Studien mit n = 25 (rechts) und n = 100

(unten) Patienten - jeweils für die Erfolgsrate p = 10% der Standardtherapie

und die erhoffte Erfolgsrate p = 30%

der neuen Therapie. Auffällig ist die

starke Überlappung beim genngeren

P"' 10%

30%

Dichten der B(n,p)-Verteilung zwe1er

P"' 30%

25%

·'äj20%

.J::.

""'

.>!

c

~15%

""'

_c

S:"' 10%

Umfang n = 25 (deswegen sind dort

5%

senkrechten Striche nicht mitgezeichnet) im Vergleich zum größeren Um-

0

2

4

6

B

10 12

Anzahl der Erfolge

14

16

1B

fang von n = 100..

Dichte von X mit B(n,p)-Verteilung:

p;. 10%0

15%

0

0

~

i1hd-r

J

0%

n"' 100

P" 30"1<

5

10

15

20

25

30

35

Anzah l der Erfolge

40

45

50

55

60

65

Wahrscheinlichkeitsräume

1.

1-1

26.2.09

Wahrscheinlichkeitsräume

Der Begriff des Zufalls wird in der Umgangssprache in verschiedenen Zusammenhängen benutzt. Im Rahmen der Stochastik beschäftigt man sich jedoch nur mit

speziellen zufälligen Vorgängen, die typischerweise bei (wissenschaftlichen) Experimenten, Beobachtungen oder Studien auftreten. Ein solcher stochastischer Vorgang

ist charakterisiert durch die folgenden drei Eigenschaften:

• Es gibt mehrere mögliche Ergebnisse.

Die Menge .f2 aller Ergebnisse heißt der Ergebnis- oder Stichprobenraum.

• Das Ergebnis ist nicht exakt vorhersagbar und nicht reproduzierbar.

• Der Vorgang ist (prinzipiell bzw. in Gedanken) wiederholbar.

Ein Ereignis A ist eine Menge von Ergebnissen, also eine Teilmenge des Stichprobenraums: A C .f!. Man sagt, daß das Ereignis A bei einem Ergebnis w E .f2 eingetreten

ist, wenn das Ergebnis w in A liegt, d.h w E A gilt. Ein Elementar-Ereignis A enthält

nur ein Ergebnis aE.f2, d.h. A = {a}.

Beispiele

stochastischer Vorgang

Ergebnisse

Ereignisse (Beispiele)

Werfen eines Würfels

Zahlen: 1, 2, ... , 6

gerade Zahl:

Roulette-Spiel

Zahlen: 0, 1, ... , 36

Rot:

{ 2, 4, 6}

{1,3, ... , 34,36}

1. Dutzend:

{ 1, 2, ... , 12}

"Wahlsonntags-Frage" an

Wahlberechtigten stellen

alle zugelassenen

Parteien

Ampel-Koalition:

Ziehen einer Kugel aus einer

Urne mit markierten Kugeln

alle verschiedenen

Markierungen

spezielle Markierung,

z.B. schwarz1 weiß

Messung eines Gewichts [kg]

positive Zahlen

Ubergewicht 1 Untergewicht

{ SPD, FDP, Grüne}

Häufigkeits-Interpretation der Wahrscheinlichkeit

Wird ein stochastisches Vorgang n-mal (unter gleichen Bedingungen) wiederholt, so

stabilisiert sich für wachsendes n die relative Häufigkeit p (A) mit der ein Ereignis A

n

bei denn Wiederholungen eingetreten ist (empirisches Gesetz der großen Zahlen), vgl.

auch Abb. 1. Der Grenzwert der Folge p (A) für n---+ oo wird als die Wahrscheinlichn

keit P(A) für das Ereignis A angesehen.

Wahrscheinlichkeitsräume

1-2

26.2.09

Abb. 1: Relative Häufigkeiten bei unabhängigen Wiederholungen für das RouletteEreignis Rot mit der Wahrscheinlichkeit p = gl .

37

oben: die ersten 50 (links) und 1000 (rechts) Wiederholungen,

unten: alle 20 000 Wiederholungen mit vergrößerter Achse der relativen Häufigkeit.

100%

90%

80%

70%

·"Q)

'='

.:.:

70%

60%

'"'

-""

""""

"":J

'"'

I

::1

'" so•"l>

J:

SOo/'!J

Q)

Q)

.

>

>

""

~

~

60%

Q)

Cl

~

40%

40%

30%

30%

20%

20%

10%

10%

0%

0

5

10

15

20

25

30

35

40

45

50

0

Anzahl der Wiederholungen

---------------------------------------

51 %

-

-

400

600

800

1 .000

Anzahl der Wiederholungen

52%

-

200

------------------------------------------------------------

SO%

ii)

--5,49%

""~

I

p ~~~-+--~~~--------------~~~~c-----------~~~~~~~--- p

Q)

>

::ffi 48%

~

47%

------------------------------------------------------------------

46%

45% ~~--~----~--~--~----~--~~--~--~----~~--~--~~--~~

0

5 000

10.000

Anzahl der Wiederholungen

15.000

20.000

Wahrscheinlichkeitsräume

1-3

26.2.09

Diese Häufigkeits-Interpretation der Wahrscheinlichkeit P(A) kann aber nicht für

eine streng mathematische Definition der Wahrscheinlichkeit verwendet werden. Deshalb wird der Begriff der Wahrscheinlichkeit nach A. N. Kolmogorov (1903-1987)

hier axiomatisch eingeführt. Dabei zeigt sich, daß es bei überabzählbarem Ergebnisraum .f2 (z.B. einem Intervall reeller Zahlen) nicht immer möglich ist, allen Teilmengen AC .f2 auf sinnvolle Weise eine Wahrscheinlichkeit zuzuordnen. Deshalb

wird die Wahrscheinlichkeit P(A) nur für Elemente eines geeigneten Systems d

von Teilmengen definiert.

1.0

Mengensysteme

Ein Mengensystem d über .f2 ist eine Menge von Teilmengen von D, also eine Teilmenge der Potenzmenge ~(D) von .f2. Wir wollen jetzt spezielle Mengensysteme d

beschreiben, die sich zur Beschreibung aller relevanten Ereignisse eignen. Hierzu stellen wir zuerst einige Forderungen auf, die dann zur Definiton einer a-Algebra führen. Zunächst sollen das unmögliche Ereignis 0 (was nie eintritt) und das sichere

Ereignis .f2 (was immer eintritt) zu d gehören. Weiter soll mit einem Ereignis A

auch das Komplementär-Ereignis (Komplement)

zu d gehören. Das Komplementär-Ereignis

CA tritt gerrau dann ein, wenn A nicht

eintritt. Schließlich sollen mit je zwei Ereignissen A und B auch die Vereinigung

AU B und der Durchschnitt An B zu d gehören. Allgemeiner soll mit jeder Folge

(An)

von Ereignissen auch ihre Vereinigung

UA

nElN n

: = { w E .f2 I es gibt ein n E W mit w E A }

n

und ihr Durchschnitt

nA

nElN n

: = { w E .a I für alle n E w ist w E A }

n

zu d gehören. Die Vereinigung von Ereignissen tritt gerrau dann ein, wenn mindestens eins der beteiligten Ereignisse eintritt. Und der Durchschnitt von Ereignissen

tritt gerrau dann ein, wenn alle beteiligten Ereignisse eintreten.

Wahrscheinlichkeitsräume

1-4

26.2.09

Definition 1: Ein Mengensystem d C

~(D) heißt

eine a-Algebra, wenn sie die

folgenden Eigenschaften hat:

(Al)

0 E d.

(A2)

d ist abgeschlossen gegen Komplemente:

Für jedes A E distauch CA E d.

(A3)

d ist abgeschlossen gegen abzählbare Vereinigungen:

Für jede Folge (A ) ausdistauch

n

UA

nElN n

E d.

Unter Berücksichtigung der Rechenregeln über Komplemente

(1)

C.f2=0

C( U A

(2)

nElN n

)=

n CA

nElN

n

C(

,

nA

CCA= A,

'

nElN n

)=

U CA

nElN

n

erhält man eine alternative ("duale") Charakterisierung von a-Algebren.

Definition 1 1: Ein Mengensystem d C

~(D) ist eine a-Algebra, wenn sie die

folgenden Eigenschaften hat:

(Al)'

.f2 E d.

(A2)

d ist abgeschlossen gegen Komplemente:

Für jedes A E distauch CA E d.

(A3) 1

d ist abgeschlossen gegen abzählbare Durchschnitte:

Für jede Folge (A ) ausdistauch

n

nA

nElN n

E d.

Eine a-Algebra d ist insbesondere auch abgeschlossen gegenüber Vereinigungen,

Durchschnitten und Differenzen je zweier Elemente

(3)

A,BEd

=?

AUE,

AnB,

A\B=AnCB E d.

Damit ist d auch abgeschlossen gegenüber Vereinigung und Durchschnitt je endlich

vieler Elemente. Man beachte jedoch, daß d nicht notwendig abgeschlossen ist ge-

genüber beliebigen (also auch überabzählbaren) Vereinigungen oder Durchschnitten.

Es mag zunächst verwundern, daß eine a-Algebra nicht auch alle ein-elementigen

sogenannten Elementar-Ereignisse {w} enthalten muß - ein Gegenbeispiel hierfür

Wahrscheinlichkeitsräume

1-5

26.2.09

ist die a-Algebra {0,.f2}. Ohne auf die Hintergründe hierfür einzugehen sei schon

jetzt angemerkt, daß die hier konkret verwendeten a-Algebren auch stets alle Elementar-Ereignisse enthalten werden.

Die Potenzmenge ~(D) ist offenbar die größte a-Algebra über D. Wenn der Ergebnisraum .f2 endlich oder abzählbar (d.h. höchstens abzählbar) ist, so verwenden wir hier

immer diese a-Algebra d= ~(D). Dies ist auch der Grund dafür, daß in der Schule

und vielen Lehrbüchern bei der Betrachtung höchstens-abzählbarer Ergebnisräume

.f2 auf die Definition von a-Algebren verzichtet werden kann.

Bei überabzählbarem Ergebnisraum .f2 - wie z.B. IR oder ein reelles Intervall - ist die

Potenzmenge ~(D) jedoch "sehr umfangreich" und man schränkt sich daher auf geeignete a-Algebren d

:;= ~(D)

ein. Hierbei gibt man sich typischerweise ein "inte-

ressierendes" nicht-leeres Mengensystem !?l3 C ~(D) vor, welche noch keine a-Algebra ist. Dann wird das System !?l3 zu einer a-Algebra erweitert, wobei die kleinste !?l3

umfassende a-Algebra gewählt und diese mit a(!?l3) bezeichnet wird. Formal ist a(!?l3)

definiert als Durchschnitt aller a-Algebren d C ~(D) mit !?l3 Cd (es gibt mindestens ein solches d, und zwar d = ~( D)):

a(!?l3)==

n

d

dc~(D)

a-Algebra

fllJCd

=

{AIAEdjürjedea-Algebradc~(D)mit!?l3cd}.

Es läßt sich (als Übung) zeigen, daß das so definierte a(!?l3) eine a-Algebra ist (auch

wenn .f2 nicht überabzählbar ist). a(!?l3) heißt die von !?l3 erzeugte a-Algebra.

Borel-Mengen in IR

Für den Ergebnisraum .f2 =IR sind primär die Intervalle als Ereignisse von Interesse, wobei ein reelles Intervall I:;= 0 zu einem der folgenden vier Typen gehört:

< a < b < oo ,

oo < a < b < oo ,

oo < a < b < oo ,

oo < a < b < oo .

•

offen:

( a , b)

mit

- oo

•

rechts-offen:

[ a , b)

mit

-

•

links-offen:

( a , b]

mit

-

•

abgeschlossen:

[ a , b]

mit

-

Da die Menge J C ~(IR) aller reellen Intervalle keine a-Algebra ist (weil z.B. das

Komplement eines Intervalles im allgemeinen kein Intervall ist), betrachten wir die

von J erzeugte a-Algebra und bezeichnen sie mit lB: = a(J). Die Elemente BE lB

werden zu Ehren des Mathematikers Emile Borel (1871-1956) auch Borel-Mengen ge-

Wahrscheinlichkeitsräume

1-6

26.2.09

nannt. Die a-Algebra IB wird bereits von der Teilmenge J 10 aller offenen Intervalle

erzeugt, d.h. IB = a(J

0

),

weil sich alle anderen Intervalle als abzählbare Dur-

schnitte offener Intervalle darstellen lassen:

[a,b) =

n (a-1.n 'b),

nElN

(a,b] =

n (a,b+l),

n

nElN

[ a 'b l =

n (a- ~ 'b+ ~).

nElN

IB wird auch noch von anderen Intervall-Mengen a-erzeugt, z.B. von der Menge

Jj

der links-unbeschränkten rechts-abgeschlossenen Intervalle

(4)

Jj =

mit

weil jedes offene Intervall durch Elemente aus

(a, b) = (-oo,b) n c(-oo,a]

{ (- oo, b]I b E IR},

Jj wie folgt darstellbar ist:

mit

(-oo,b) =

U (-oo,b-1.].

nElN

n

Neben den Intervallen sind auch die folgende Mengen reeller Zahlen Borel-Mengen,

wie sich leicht zeigen läßt:

•

alle ein-elementigen Teilmengen (Elementar-Ereignisse) von IR,

•

alle endlichen und alle abzählbaren Teilmengen von IR,

•

alle offenen und alle abgeschlossenen Teilmengen von IR.

Es taucht nun die Frage auf, ob es überhaupt Teilmengen von IR gibt, die nicht zu

IB gehören. Obwohl dies mit ja zu beantworten ist, kann man solche Mengen nicht

elementar angeben: es bedarf des (nicht-konstruktiven) Auswahlaxioms der Mengenlehre um die Existenz solcher nicht-Bore1-Mengen zu zeigen, worauf wir hier

verzichten.

Wenn wir im folgenden mit dem Ergebnisraum .f2 =IR arbeiten, so werden wir hier

immer die a-Algebra d= IB der Bore1-Mengen verwenden.

Oft ist der Ergebnisraum .f2 jedoch ein reelles Intervall, oder allgemeiner eine Borel-

Menge. In diesem Fall verwenden wir stets die a-Algebra d= IBn aller Borel-Teilmengen von D, d.h.

(5)

IBn:= {Ben IBEIB} =

IBn~(n).

Man beachte, daß bei höchstens abzählbarem .f2 C IR die a-Algebra IBn gerrau die Potenzmenge

~(D)

ist (weil jede Teilmenge von .f2 höchstens abzählbar).

Wahrscheinlichkeitsräume

1.1

1-7

26.2.09

Wahrscheinlichkeitsmaße

Den Elementen (Ereignissen) einer a-Algebra d über einem Ergebnisraum .f2 sollen

jetzt Wahrscheinlichkeilen zugeordnet werden. Die folgenden Axiomatisierung des

Wahrscheinlichkeitsbegriffs geht auf Andrey Kolmogorov (1903-1987) zurück.

Definition: Ein Wahrscheinlichkeitsmaß P auf einer a-Algebra d über einem

Ergebnisraum .f2 :;= 0 ist eine Abbildung P: d-----+ IR mit den Eigenschaften:

(P1)

P ist nicht-negativ:

P(A) > 0

(P2)

P ist normiert:

P( .f!) = 1 .

(P3)

P ist a -additiv:

Für jede Folge

für alle A E d.

(An E d) von paarweise disjunkten

Mengen (d.h. Ai n Aj = 0 für alle i :;= j) gilt

P(

UA

nElN n

) =

2:

P(A ) .

nElN

n

Das Tripel (D, d, P) wird als Wahrscheinlichkeitsraum (kurz: W-Raum) und das

Wahrscheinlichkeitsmaß (kurz: W-Maß) auch als (Wahrscheinlichkeits-) Verteilung bezeichnet. Für ein Ereignis A E dheißt P(A) die Wahrscheinlichkeit (für das Eintreten)

von A.

Wir stellen zuerst einige elementare Folgerungen aus den Axiomen (P1) - (P3) zusammen. Zunächst hat das unmögliche Ereignis die Wahrscheinlichkeit Null

(1)

P(0) =

0.

Weiter ist P endlich-additiv

(2)

Für paarweise disjunkte A1, ... , AKE d gilt:

Das komplementäre Ereignis hat die (zu 1 komplementäre) Wahrscheinlichkeit

(3)

P(CA)

= 1- P(A)

für alle A E d.

Die Werte von P liegen immer im abgeschlossenen Einheitsintervall [ 0, 1]

(4)

0 < P(A)

<1

für alle A E d.

Die Wahrscheinlichkeit der Vereinigung zweier Ereignisse A, BE d ist

(5)

P(A UB) = P(A)

+ P(B)- P(AnB) <

P(A)

+ P(B)

Wahrscheinlichkeitsräume

1-8

26.2.09

Man beachte, daß dies für A nB = 0 ein Spezialfall von (2) mit K = 2 ist. Die Wahrscheinlichkeit einer beliebigen endlichen Vereinigung nicht notwendig disjunkter

Ereignisse A , ... , AK E d läßt sich ebenfalls durch eine Additionsformel angeben

1

K

(6)

P(

U Ak)

k=l

=

2:=

0~IC{l, ... /(}

(-1)#1 - 1 -P(

nA.),

iEI

z

wobei #I die Anzahl der Elemente der Menge I bezeichnet. Zusätzlich ergibt sich

aus (5) per Induktion die endliche Sub-Addititvität von P:

(7)

P(

K

K

k=l

k=l

U Ak) < 2:= P(Ak).

Weiter ist P monoton, weil

(8)

AcE

P( A)

< P(B)

= P(B\A)

+ P(A)

für alle A, BE d.

Die obigen Eigenschaften eines Wahrscheinlichkeitsmaßes sind - mit Ausnahme

der a-Additivität - bereits von relativen Häufigkeiten her bekannt und entsprechen

damit den Eigenschaften des intuitiven Wahrscheinlichkeitsbegriffs. Die a-Additivität (P3) ist eine Verallgemeinerung der endlichen Additivität (2), die erst bei unendlichem Ergebnisraum .f2 eine (wichtige) Rolle spielt. Für endliches .f2 kann man man

die Forderung (P3) sogar äquivalent durch (2) ersetzen1 weil dann für jede Folge (An)

paarweise disjunkter Teilmengen von .f2 höchstens endlich viele A

n

:;=

0 sind.

Wahrscheinlichkeitsräume (D, d,P) werden als Modelle für reale stochastische

Vorgänge mit Ergebnisraum .f2 verwendet., wobei P(A) die Wahrscheinlichkeit eines

Ereignisses A in Sinne der Häufigkeits-Interpretation quantifizieren soll. Die Wahl

eines (zumindest approximativ) adäquaten Wahrscheinlichkeitsmaßes P für einen

konkreten stochastischen Vorgang ist im allgemeinen nicht leicht.

Wir stellen jetzt noch einige wichtige Eigenschaften eines Wahrscheinlichkeitsmaßes P auf (D, s1) zusammen, die sich auf eine Folge (An E d) von Ereignissen beziehen, und somit primär für unendliches .f2 von Bedeutung sind:

(9)

Wenn (An) aufsteigend ist, d.h. An cAn+l für allen, so gilt:

P( U A

n E lN n

(10)

) = lim P(A )

n---+oo

n

(,,Stetigkeit von unten").

Wenn (An) abfallend ist, d.h. An+l cAn für allen, so gilt:

n

P( n E lNA n )

= lim

n---+oo

P(A )

n

(,,Stetigkeit von oben"),

Wahrscheinlichkeitsräume

P(

(11)

1-9

26.2.09

UA

nElN n

) < 2:= P(A )

("a -Subadditivität").

n

nElN

Man beachte, daß die rechte Seite in (11) nicht notwendig (absolut) konvergent sein

muß (z.B. im Fall A = .f2 für alle n). Da der Reihenwert dann aber gleich oo ist, gilt

n

die Ungleichung trivialerweise.

Abschließend zeigen wir noch ein Resulat über eine beliebige (nicht notwendig abzählbare) Familie disjunkter Ereignisse:

(12)

Bei einer beliebigen Familie (A. E d). I paarwezse disjunkter Ereignisse

z

zE

haben höchstens abzählbar viele eine von 0 verschiedene Wahrscheinlichkeit)

d.h. die Menge K = { k EI I P(Ak) > 0} ist höchstens abzählbar.

Für eine höchstens abzählbare Indexmenge I ist das Resultat trivial.

1.2

Endliche Wahrscheinlichkeitsräume

Als einfachsten Fall betrachten wir zunächst endliche Wahrscheinlichkeitsräume

(D, d, P), d.h. der Ergebnisraum .f2 ist endlich und es ist d =

~(D).

Aus der (endlichen) Additivität ergibt sich

(1)

2:= P{w}

P(A) =

für A

cn.

WEA

Folglich ist P bereits eindeutig durch die Elementar-Wahrscheinlichkeiten P{ w} aller

Ergebnisse w E .f2 bestimmt, deren Summe 1 ergibt:

(2)

2:= P{w}

=

1.

wED

Ist umgekehrt eine nicht-negative Abbildung f: .f2-----+ [ 0, oo) gegeben mit

(3)

2:= f(w)

=

1,

wED

so läßt sich ein zugehöriges Wahrscheinlichkeitsmaß Pf definieren durch

(4)

für A eil,

dessen Elementarwahrscheinlichkeiten Pf{ w} = f( w) durch f gegeben sind.

Wahrscheinlichkeitsräume

26.2.09

1-10

Die Funktion f der Elementarwahrscheinlichkeiten wird auch als Zähldichte oder

Wahrscheinlichkeitsfunktion von

Pf bezeichnet. Typischerweise definiert man em

Wahrscheinlichkeitsmaß P durch Angabe der zugehörigen Zähldichte P{-}.

1.2.1

Diskrete Gleichverteilung

Wenn alle Ergebnisse gleich-wahrscheinlich sind, d.h. wenn

(1)

mit

n = #f2,

so heißt das Wahrscheinlichkeitsmaß P die diskrete Gleichverteilung auf f2. Die

Wahrscheinlichkeit eines Ereignisses A ergibt sich dann als Quotient

(2)

_#A

P(A)- #D.

Die Gleichverteilung tritt typischerweise bei remen Glücksspielen (z.B. Roulette,

Werfen von homogenen Würfeln, Zahlenlotto) auf. Diese Situationen lassen sich

meist äquivalent durch ein Urnenexperiment beschreiben: aus einer Urne mit von 1

bis n durchnumerierten Kugeln wird zufällig eine Kugel gezogen und ihre Nummer

notiert. Für n = 6 läßt sich so das Werfen eines homogenen Würfels charakterisieren.

1.2.2

Bernoulli-Verteilung

Eine Wahrscheinlichkeitsverteilung auf dem zwei-elementigen Ergebnisraum

f2 = {0, 1} ist vollständig bestimmt durch eine der beiden Wahrscheinlichkeiten

(1)

p:=P{1},

q : = P { o} =

P(C {1}) = 1- p ,

die sich auch wie folgt darstellen lassen

(2)

für k E {0, 1}.

Diese Verteilung heißt auch Bernoulli-Verteilung- nach Jakob Bernoulli (1654-1705)und wird mit B(1,p) bezeichnet, weil sie auch eine spezielle Binomialverteilung (vgl.

1.2.3) ist. Um triviale Fälle auszuschließen, werden wir bei Anwendungen stets implizit 0 < p < 1 voraussetzen, wenn nicht ausdrücklich p = 0 oder p = 1 zugelassen

werden.

Die Bernoulli-Verteilung findet immer dann Anwendung, wenn man sich nur für

das Eintreten eines speziellen Ziel-Ereignisses E (oft als Treffer oder Erfolg bezeich-

Wahrscheinlichkeitsräume

1-11

26.2.09

net) interessiert (z.B. ob ein Wähler einer bestimmten Partei seine Stimme geben

würde). Codiert man das Eintreten durch die Zahl1 und den Nicht-Eintritt durch 0,

so ist p =P(E) gerrau die Wahrscheinlichkeit des Ziel-Ereignisses E.

1.2.3

Binomial-Verteilung

Die Binomialverteilung B(n,p) vom Umfang n E W mit Parameter 0 < p < 1 ist auf

dem Ergebnisraum .f2 = {0, 1, ... , n} definiert durch die Zähldichte

(1)

(~)Pk

b(kl n,p) := P{k} =

(1-pt-k

für k = 0, 1, ... , n.

Diese Binomial-Wahrscheinlichkeiten lassen sich für 0 < p < 1 schrittweise vorwärts

(d.h. für k = 0, 1, ... , n) oder rückwärts (d.h. für k = n, n-1, ... , 0) berechnen mit

n

(2)

b(Oin,p)

q

(3)

b(kln,p)

n-k+l p

-k-.

(4)

b(nln,p)

p.

mit q=1-p

q. b(k-1ln,p)

für k = 1, ... , n

n

Die Wahrscheinlichkeiten b ( k In, p) sind für k = 0, 1, ... zuerst anwachsend - solange

k < n p gilt - und dann für k > n p wieder abfallend (vgl. z.B. Kap. 0, Abb. 3-4).

Für n = 1 ergibt sich die Bernoulli-Verteilung. Wie später noch gerrauer ausgeführt

wird, beschreibt die Binomial-Verteilung die Wahrscheinlichkeiten für die Häufigkeit

mit der ein spezielles Ziel-Ereignis E bei n unabhängigen Wiederholungen eintritt, wobei p = P(E) die Wahrscheinlichkeit dieses Ziel-Ereignisses E ist. Beispiele für solche Anwendungen sind die Wahlumfragen in 0.3 oder die klinische Studien in 0.4.

Wie bei der Bernoulli-Verteilung setzen wir bei Anwendungen implizit 0 < p < 1 voraus, wenn nicht ausdrücklich p = 0 oder p = 1 zugelassen werden.

1.2.4* Relative Häufigkeiten

Wir haben bereits bemerkt, daß die Eigenschaften (P1) - (P3) für relative Häufigkeiten gelten und wollen dies jetzt präzisieren. Hierzu sei M eine beliebige nichtleere

Menge und x = (xl' ... , xn) E Mn ein n- Tupel von Elementen aus M. Auf der Menge

Wahrscheinlichkeitsräume

1-12

26.2.09

.f2 = { x , ... , x } aller verschiedenen Elemente des Tupels x läßt sich das Wahrx

n

1

scheinlichkeitsmaß P der relativen Häufigkeiten definieren durch die Zähldichte

X

(1)

P { x .} : = 1... #

x

z

n

{k =

11 ••• 1 n I xk = x.}

z

(relative Häufigkeit des Werts x. im Tupel (x , ... , x ).

z

1

n

Die Wahrscheinlichkeit einer Teilmenge AC .f2 ist dann gegeben durch

X

Px (A) : = 1..n · #

(2)

{k =

11 ••• 1 n I xk E A} (relative Häufigkeit der x-Werte in A).

P wird auch als die empirische Verteilung von x bezeichnet. Wenn alle Komponenx

ten von x verschieden sind, so ist P natürlich die Gleichverteilung auf .f2 .

X

1.3

X

Abzählbare Wahrscheinlichkeitsräume

Wir wollen jetzt abzählbare Wahrscheinlichkeitsräume (D, d,P) betrachten, d.h. der

Ergebnisraum .f2 ist abzählbar und es ist d =

~(D).

Typische Beispiele für ein sol-

ches .f2 sind die natürlichen Zahlen W = {1, 2, ... } oder die nicht-negativen ganzen

Zahlen W = Z + = {0, 1, 2, ... }.

0

Für endliches bzw. abzählbares AC .f2 ergibt sich mit der endlichen bzw. a-Additi-

vität

(1)

2:= P{w}

P(A)

für AC .f!.

WEA

wobei die Schreibweise bereits andeutet, daß es (auch bei abzählbarem A) nicht auf

die Reihenfolge der Summation ankommt (dies ergibt sich aus dem Umordnungssatz für absolut konvergte Reihen). Folglich ist ?bereits eindeutig durch die ElementarWahrscheinlichkeiten P{ w} aller Ergebnisse w E .f2 bestimmt., wobei

(2)

2:= P{w}

1.

=

wED

Ist umgekehrt eine nicht-negative Abbildung f: .f2-----+ [ 0, oo) gegeben mit

(3)

2:= f(w)

=

1,

wED

so läßt sich ein zugehöriges Wahrscheinlichkeitsmaß Pf definieren durch

(4)

P/A) : =

2:= f(w)

wEA

für A eil,

Wahrscheinlichkeitsräume

1-13

26.2.09

dessen Elementarwahrscheinlichkeiten Pf{ w} = f( w) durch f gegeben sind.

Die Funktion f der Elementarwahrscheinlichkeiten wird auch als Zähldichte oder

Wahrscheinlichkeitsfunktion von Pf bezeichnet. Typischerweise definiert man em

Wahrscheinlichkeitsmaß P durch Angabe der zugehörigen Zähldichte P{-}.

Da die abzählbaren Wahrscheinlichkeitsräume vieles mit den endlichen Wahrscheinlichkeitsräumen gemeinsam haben, faßt man sie zu den diskreten Wahrscheinlichkeitsräumen zusammen: (f2, d,P) heißt diskret, falls f2 höchstens abzählbar

und d = ~(f2) ist.

1.3.1

Poisson-Verteilung

Die auf Sirneon Poisson (1781-1840) zurückgehende Poisson-Verteilung Pois(p,) mit

Parameter p, > 0 ist auf dem Ergebnisraum f2 = W = {0, 1, 2, ... } definiert durch die

0

Zähldichte

(1)

p ( k 11-L) : =

P{ k}

für k = 0, 1, ...

Die Poisson-Wahrscheinlichkeiten lassen sich schrittweise für k = 0, 1, 2, ..... wie

folgt berechnen

(2)

(3)

für k > 1.

Die Folge dieser Wahrscheinlichkeiten p ( k ;p,) ist für k = 0, 1, 2, ... zuerst anwachsend

solange k < p, gilt, und dann für k > p, wieder abfallend (vgl. z.B. Kap. 0, Abb. 1-2).

Die Poisson-Verteilung wird als Modell verwendet für die Anzahl von Eintritten eines interessierenden Ziel-Ereignisses in einer spezifizierten Grundgesamtheit, wie

z.B. die Anzahl der Leukämieerkrankungen von Kindern in einer Region innerhalb

eines Zeitraums (vgl. Abschnitt 0.1). Hierbei müssen allerdings die einzelnen Ereignisse zufällig und unabhängig voneinander eintreten (was z.B. für Grippe-Erkrankungen in einer Region nicht zutrifft, weil diese sich durch Ansteckung ausbreiten und

somit nicht voneinander unabhängig auftreten). Der Parameter p, (der sich später

als der Erwartungswert der Verteilung herausstellen wird) entspricht dabei der (im

Durchschnitt) zu erwartenden Anzahl von Eintritten. Das Auftreten der Poisson-

Wahrscheinlichkeitsräume

1-14

26.2.09

Verteilung kann auch aus anderen Annahmen hergeleitet werden, die bei konkreten

Anwendungen plausibel erscheinen (vgl. Abschnitt 6.2.4 oder 9.3.2).

In der Praxis können bei solchen Anwendungen die (zufälligen) Anzahlen von

Ereignissen nicht beliebig große Zahlen k annehmen, weil die Grundgesamtheit (z.B.

die Anzahl aller Kinder einer Region) beschränkt ist. Dennoch kann man hier in guter Näherung von einer Poisson-Verteilung ausgehen, weil die Poisson-Wahrscheinlichkeiten p ( k ;p,) extrem klein werden, wenn k (im Verhältnis zu p,) groß wird, so

daß man sie bei praktischen Berechnungen vernachlässigen kann.

Eine weitere typische Anwendung der Poisson-Verteilung liegt vor, wenn abzählbar

viele "Punkt-Partikel" zufällig und unabhängig voneinander im Ra um lR 3 (oder in

der Ebene lR 2, auf der Zahlengeraden lR) verteilt sind. Die Anzahl der Partikel in

einer zufällig ausgewählten Teilregion V läßt sich durch eine Poisson-Verteilung beschreiben. Hierbei ist p, die (im Durchschnitt) zu erwartende Partikelzahl in V und

entspricht der Konzentration der Partikel. Obwohl bei konkreten Anwendungen immer nur endlich viele Partikel in beschränkten Teilmengen von lR 3 (bzw. lR 2 oder lR)

zufällig verteilt sind, ist die Poisson-Verteilung auch dann noch ein angemessenes

Modell. Beispiele für solche Anwendungen der Poisson-Verteilung sind z.B. folgende

Anzahlen: Asbestfasern in einem Stichprobenvolumen V (vgl. 0.1), Rosinen im Kuchen, Druckfehler pro Seite etc.

1.4

Reelle Wahrscheinlichkeitsmaße mit Dichten

Wir wollen jetzt auch überabzählbare Eregbnisräume .f2 betrachten, wobei wir zunächst nur den Fall betrachten, daß .f2 = (a, ß) C lR ein offenes reelles Intervall und

d= lB.ft die a-Algebra aller Borel-Teilmengen von .f2 ist. Weiter wollen wir hier zunächst nur solche Wahrscheinlichkeitsmaße P auf d

betrachten, die eine stetige

Dichte besitzen. Eine stetige Wahrscheinlichkeitsdichte (kurz: Dichte) auf .f2 ist eine

nicht-negative stetige Funktion f: .f2-----+ [0, oo), deren (Lebesgue-)Integral über dem In-

tervall .f2 = (a, ß) gleich 1 ist:

Wahrscheinlichkeitsräume

1-15

26.2.09

y

Dichte y=f(x) von P

ß

1

1 f(x) dx

(1)

bzw.

Q

1 f(x) dx = 1.

[2

Wir setzen jetzt (ohne Beweis) das fol·

gende Resulat aus der Wahrscheinlich·

a~

b~

X:

Abb. 1: Dichte und Wahrscheinlichkeit

keitstheorie voraus:

Theorem: Zu jeder stetigen Wahrscheinlichkeitsdichte f: .f2-----+ [0, oo) gibt es genau

ein Wahrscheinlichkeitsmaß Pf auf lB [2! so daß für jedes Intervall (a, b] C .f2 gilt

b

Pf( a, b] = 1 f(x) dx

(2)

(vgl. Abb. 1).

a

Zusatz 1: Die Wahrscheinlichkeit einer beliebigen Borel-Menge B C .f2 ist hierbei das

Lebesgue-Integral von f über der Menge B

(3)

PjB) = 1 f(x) dx.

B

Zusatz 2: Das Theorem und der Zusatz 1 gelten gelten auch für jede meßbare

(vgl. 2.2 Def 1) - also nicht notwendig stetige - Wahrscheinlichkeitsdichte f

Insbesondere haben alle Elementar-Ereignisse die Wahrscheinlichkeit Null

(4)

für alle w E .f2.

Dies ist zunächst überraschend und unterscheidet überabzählbare von höchstens ab-

zählbaren Wahrscheinlichkeitsräumen. Bei letzteren konnten wir ein Wahrscheinlichkeitsmaß P sogar durch die Angabe aller Elementar-Wahrscheinlichkeiten P{ w}

definieren. Aber bei überabzählbarem .f2 bilden die Elementarereignisse {w} eine überabzählbare disjunkte Familie von Ereignissen, von denen nach 1.1 (12) höchstens abzählbar viele eine von Null verschiedene Wahrscheinlichkeit haben. Bei einem

durch eine Dichte f spezifizierten Wahrscheinlichkeitsmaß Pf spielen daher die Elementar-Wahrscheinlichkeiten (4) keine Rolle, sondern die Wahrscheinlichkeiten (2)

für Intervalle sind von primärem Interesse. Die Wahrscheinlichkeit eines Intervalls

hängt nicht davon ab, ob die Randpunkte zum Intervall dazugehören oder nicht

b

(5)

P [a,b] =P [a,b) =Pf(a,b) =Pf(a,b] = 1f(x)dx

füra<b.

1

1

a

Wahrscheinlichkeitsräume

26.2.09

1-16

Insbesondere kann man auch den Raum .f2 durch Hinzunahme eines oder beider

der Randpunkte a und

ß (sofern

diese nicht ± oo sind) erweitern zu einem der In-

tervalle (a, ß], [a, ß) oder [a,ß]. Das Theorem gilt auch in diesem Fall noch und das

zugehörige Wahrscheinlichkeitmaß ist nur eine Fortsetzung des obigen Wahrscheinlichkeitsmaßes

Pr

Vergleicht man die Definition des Wahrscheinlichkeitmaßes Pf in (3) mit den entsprechenden Definitionen 1.2 (4) bzw. 1.3 (4) für endliches bzw. abzählbares D, so

stellt man fest, daß statt der dortigen Summe hier ein Integral steht. Im Rahmen der

Maßtheorie lassen sich Summen ebenfalls als Integrale (bzgl. des abzählenden Maßes) auffassen und dies erlaubt dann eine gemeinsame Behandlung von Wahrscheinlichkeitmaßen, die durch eine Dichte f definiert sind.

Zum Integral-Begriff: Bei den obigen und allen folgenden Betrachtungen mit Integralen liegt hier stets das Lebesgue-Integral (nach Henri Lebesgue 1875-1941) zugrunde, welches das sogenannte Riemann-Integral (nach Bernhard Riemann,

1826-1866) verallgemeinert. Das Riemann-Integral ist nur für stetige Funktionen

über kompakten reellen Intervallen [a, b] definiert und stimmt dann mit dem Lebesgue-Integral überein. Damit man auch ohne Kenntnis des Lebesgue-Integrals die

wesentliche Integrale interpretieren und bestimmen kann, wollen wir kurz erläutern, wie man das Integral für stetige Funktionen über einem beliebigen reellen Intervall und über endliche Vereinigungen von Intervallen auf das Riemann-Integral zurückführen kann (zur Veranschaulichung vgl. Abb. 2).

Wenn eine stetige Funktion f auf dem halb-offenen Intervall (a, b] definiert ist (wobei

auch a =- oo zugelassen ist), so ergibt sich das Integral über (a, b] wie folgt durch

"stetige Fortsetzung":

(6)

b

1f(x) dx = lim

a

cl a

b

1f(x) dx

("c l a" bedeutet "c---+ a mit c > a").

c

Analog erhält man das Integral über dem halb-offenen Intervall [a, b) bzw. dem offen Intervall (a, b) wennf dort definiert und stetig ist (auch für b = oo):

b

(7)

1f(x) dx

a

lim

d

1f(x) dx

dj b a

bzw.

b

(8)

1f(x) dx

a

lim lim

d

1f(x) dx.

cla dj b c

("d I b" bedeutet "d---+ b mit d < b")

Wahrscheinlichkeitsräume

1-17

26.2.09

Abb. 2: Eine im Nullpunkt unstetige Funktion

als Beispiel für (6)-(10) 1 vgl. auch 4.4.2 Abb 4zu (6): wähle (a,b] als (0,5] oder (-oo,-1].

zu (7): wähle [a, b) als [ -5, 0) oder [1, oo).

zu (8): wähle (a,b) als (-oo,O) oder (O,oo).

zu (9): wähle K = 2,11 = (- oo, 0), 12 = (0, oo).

zu {10): wählen= 1, (a, b) = (- oo, oo) 1 c = 0.

1

-5

0

5

Damit sind die Integrale in (1), (2) und (5) auf das Riemann-Integral zurückführbar.

Für das Integral in (3) ist dies auch einem wichtigen Speziall noch möglich. Wenn

die Menge B eine Vereinigung endlich vieler disjunkter Intervalle 1 , ... ,IK ist, so gilt

1

(9)

Jf(x) dx

Jf( x) dx + .... + Jf( x) dx ,

B

I1

IK

wobei die rechte Seite wieder auf Riemann-Integrale zurückführbar ist. Um das

Wahrscheinlichkeitsmaß Pf jedoch auf allen Borel-Teilmengen von .f2 (d.h. auf IB D)

durch (3) zu definieren, wird das Lebesgue-Integral benötigt. Allerdings werden wir

hier nur konkrete Wahrscheinlichkeiten PjE) für den Fall bestimmen, daß Bein Intervall oder eine endliche disjunkte Vereinigung von Intervallen ist, und hierfür ist

das Riemann-Integral ausreichend.

Abschließend betrachten wir noch den Fall, daß eine Funktion f: (a,b)----+ [0, oo) in

höchstens endlich vielen Punkten c1 < c2 < ... < cn von (a, b) unstetig ist. Dann läßt

sich das Integral über (a,b) zerlegen, indem man über die offenen Teilintervalle

(a,c1), (c1, c2), ... , (cn,b) integriert, auf denen f jeweils stetig ist (und somit das Riemann-Integral verwendet werden kann, zur Veranschaulichung vgl. Abb. 2)

b

(10)

Jf(x) dx

a

c1

=

J f(x) dx

c2

+

b

J f(x) dx .... + Jf(x) dx.

a

Eine Funktion f: .f2----+ [0, oo) mit höchstens endlich vielen Unstetigkeitsstellen heißt

eine Wahrscheinlichkeitsdichte, wenn sie die Bedingung (1) erfüllt, und das obige Theorem gilt auch noch für solche Wahrscheinlichkeitsdichten. Das durch (2) gegebene

Wahrscheinlichkeitsmaß

Pf ändert sich nicht, wenn man die Funktionswerte der

Dichte f in den endlich vielen Unstetigkeitststellen abändert. Es ist zweckmäßig, die

Wahrscheinlichkeitsräume

1-18

26.2.09

Dichte f in ihren Unstetigkeitsstellen gleich 0 zu setzen, und eine solche Dichte wollen wir als kanonische Dichte bezeichnen (sie ist nach 4.3 sogar eindeutig bestimmt).

Obwohl wir es hier primär mit stetigen Dichten zu tun haben werden, führen uns

bereits elementare Operationen von stetigen Dichten zu solchen, die in endlich vielen Punkten unstetig sind (vgl. hierzu die Bemerkung nach 4.4.2 (6)).

In der Maß- und Wahrscheinlichkeitstheorie definiert man noch allgemeiner eine

Wahrscheinlichkeitsdichte als eine meßbare Funktion f: D-----+ [0, oo) (vgl. 2.2 Def 1)

mit der Eigenschaft (1) und beweist dort das Theorem sogar für meßbare (statt ste-

tige) Dichten.

1.4.1

Normal-Verteilung

Die mit Abstand bedeutendste Verteilung auf .f2 = (- oo, + oo) =IR ist die Normal-

verteilung N(p,, a 2) mit den Parametern p, E IR und a > 0. Ihre stetige Wahrscheinlichkeitsdichte ist gegeben durch

(1)

f(x)

1

---·e

_ _!_ (~)2

2

a

für xE IR.

.. nd ri:JI

2

Dichte:yo=f(x)

J

y

X

o~~~=-~~~-+-~+-~-+-~~~~~~

p-4a

p-3o

p-2o

p-o

fi+O

p+2o

p+3o

p+4o

Abb. 1: Dichte f( x) der Normalverteilung N(p,, a 2 ) als Funktion von x (untere Achse)

und als Funktionf(u) der Standardisierung u=(x-p,)fa (obere Achse).

Wahrscheinlichkeitsräume

1-19

26.2.09

Man kann (z.B. unter Verwendung der Gamma-Funktion, vgl. 6.2.4) zeigen

+oo

J

(2)

f( x) dx = 1

-00

Die Funktion! (vgl. Abb. 1 oder einen 10-DM-Schein) ist eine Gauß)sche Glockenkurve

(nach Carl Friedrich Gauß, 1777-1855) mit einem Maximum in x = p, und den Wendepunkten x = p, ± a.

Auf Bedeutung und Anwendungen der Normalverteilung gehen wir erst später ein.

(vgl. aber Abb. 2 und 3).

Im Fall p, = 0 und a = 1 liegt die Standard-Normalverteilung N(O, 1) vor, deren Dichte

wir hier mit cp bezeichnen:

(3)

cp(x)

1

.e

1 2

--x

für xE IR.

2

/2i

Geburtsgewicht '[kg]

Normalverteilungsdrehte

mit Histogramm

Geburtsgewicht lkg]

Normalverteilungsdrehte

mit Histogramm

Jungen

Mädchen

0

2

J.1 = 3 .44

a= 0 .49

J.1= 3.30

a=0,45

3

4

5

6

0

2

3

4

5

6

Abb. 2: Histogramme des Geburtsgewichts aller 1974 in der Bundesrepublik

Deutschland geborenen Kinder (Quelle: Statistisches Bundesamt). Die "ange-

paßte" Dichte einer Normalverteilung (jeweils für Mädchen und Jungen getrennt)

stellt bis auf den unteren Gewichtsbereich ein zufriedenstellendes Modell dar.

Wahrscheinlichkeitsräume

JJ.-2a

j.i-2a

J.l+2a

jJ.

1-20

26.2.09

Normal-Dichte

648 Mädchen

J-1=53.28

a= 2.59

JJ

p + 2a

Normal-Dichte

648 Jungen

J-1=53.64

a= 2 .53

44 46 48 50 52 54 56 58 60 62 64

44 46 48 50 52 54 56 58 60 62 64

Größe: Kind (Kontrolle) [Zoll]

Größe: Kind (Kontrolle) [Zoll}

Abb. 3: Histogramme der Körpergröße von Kindern im Alter von 10 Jahren aus

einer amerikanischen Studie über Kindesentwicklung mit "angepaßter" Dichte

einer Normalverteilung. Quelle: J.L. Hodges, D. Krech, R.S. Crutchfield (1975).

StatLab: an empirical introduction to statistics. McGraw-Hill, New York.

1.4.2 Exponential-Verteilung

Die Exponential-Verteilung Expo(>.) mit Parameter ). > 0 ist auf dem Intervall

.f2 = (0, oo) definiert durch die stetige Wahrscheinlichkeitsdichte (vgl. Abb. 4):

für t> 0.

(1)

Wie wir später noch zeigen werden, eignet sich die Exponentialverteilung zur Modellierung einer Lebensdauer (wenn kein Alterungsprozeß stattfindet) oder einer

Wartezeit (vom Eintritt eines zufälligen Ereignisses bis zum nächsten Eintritt), wo-

bei

1-L =

1/>. die durchschnittliche (erwartete) Lebensdauer bzw. Wartezeit ist.

1.4.3 Stetige Gleichverteilung

Die stetige Gleichverteilung SG( a, ß) mit a

.f2 = (a, ß) der Länge iJ. =

<ß

ß- a definiert durch die

lichkeitsdichte (vgl. Abb. 4):

(1)

1

f(x) = iJ.

ist auf dem offenen Intervall

für a

< x < ß.

konstante (stetige) Wahrschein-

Wahrscheinlichkeitsräume

1-21

26.2.09

Die Wahrscheinlichkeit eines Intervalls (a, b) C .f2 hängt dann nur noch von der Intervalllänge (aber nicht von seiner Lage) ab

b- a

(2)

P (a,b) = ~

für a

< a < b< ß.

Die stetige Gleichverteilung ist ein Modell für das "zufällige Ziehen eines Punktes"

aus dem Intervall .f2. Anwendungen sind z.B. ein "stetiges Glücksrad (Roulette)" mit

einem Zeiger, der nach Stillstand einen "zufälligen Winkel" (zur Nullmarkierung)

im Bereich von a = 0 bis

ß = 27r anzeigt. Oder der seit Beginn einer vollen Stunde

verstrichene Bruchteil einer Stunde bis zum Eintritt eines Ereignisses (z.B. Anruf in