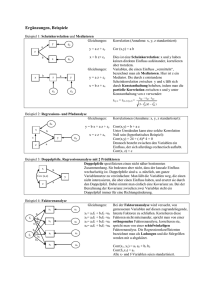

Regression und Korrelation

Werbung

Regression und Korrelation Ziel: Vorhersage • Unabhängige Variable X (quantitativ) • Abhängige Variable Y • Wie genau erlaubt die Kenntnis von X, den Wert von Y vorherzusagen, und welcher Wert wäre das? Vorhergesagter Wert Y ' = F (X) (wieso Vorhersage? Wir kennen Y doch!) • Vereinfachung: Existiert ein linearer Zusammenhang? Y'=a+bX Linearität • Fast jeder Zusammenhang ist – lokal linear – global nichtlinear Das lineare Modell • y'i = a + b · xi • yi = y'i + ei = a + b · xi + ei • ei = yi – y'i Y • • • • Ziel: <e²> minimieren. <y> = a + b · <x> a = <y> – b · <x> b = Vxy / Vxx ei X Varianz und Kovarianz • Vxx = < (x – <x>) ² > = < x² – 2 x <x> + <x>² > = <x²> – 2 <x> <x> + <x>² = <x²> – <x>² • Sx = Vxx • Vyy= <y²> – <y>² • Vxy = < (x – <x>) (y – <y>) > = <xy> – <x> <y> • Vyx = Vxy Kovarianz • Vxy = < (x – <x>) (y – <y>) > = <xy> – <x> <y> • Vxy ist positiv, wenn positive Abweichungen in X mit positiven Abweichungen in Y einhergehen, und negative mit negativen. • Vxy ist negativ, wenn positive Abweichungen in X mit negativen Abweichungen in Y einhergehen, und negative mit positiven. • Vxy ist Null, wenn positive Abweichungen in X gleich häufig mit positiven wie mit negativen Abweichungen in Y einhergehen (und dasselbe für negative Abweichungen in X). z-transformierte Daten • • • • • Ziel: <e²> minimieren. <y> = a + b · <x> a = <y> – b · <x> b = Vxy / Vxx <x> = <y> = 0, Vxx = Vyy = 1. a=0 b = Vxy = <xy> – <x> <y> = <xy> Vertauschung von X und Y • Ziel: <e²> minimieren. • b = <xy> [–1,1] X Y ei ei ei X Y Steigung und Korrelationskoeffizient • • • • • • • by·x = Vxy / Vxx bx·y = Vxy / Vyy 1 / by·x = Vxx / Vxy rxy = Vxy / (Vxx Vyy) by·x = rxy (Vyy/Vxx) = rxy Sy/Sx bx·y = rxy (Vxx/Vyy) = rxy Sx/Sy rxy² = Vxy² / (Vxx Vyy) <ei²> = Vyy ( 1 – rxy² ) = ( 1 – rxy² ) für z-transformierte Daten Varianz und Korrelationskoeffizient • rxy² = Vxy² / (Vxx Vyy) y i = a + b · x i + ei • <ei²> = Vyy ( 1 – rxy² ) = der Anteil von Vyy, der nicht durch X erklärt wird • Vyy rxy² = der Anteil von Vyy, der durch X erklärt wird Vxx Vyy rxy²·Vyy (1–rxy²) ·Vyy rxy²·Vxx (1–rxy²) ·Vyy Partial- und Semipartialkorrelation • • • • • • • Bei Schulkindern korreliert Lesefähigkeit X mit Sprungweite Y. Verdacht: Beides korreliert mit Alter Z. „Scheinkorrelation“... (echte Korrelation, Verdacht: nicht kausal) Test: Alter konstant halten... oder: Lesefähigkeit und/oder Sprungweite vom Alter bereinigen. bereinigte Variablen: X* = X – bx.z · Z, Y* = Y – by.z · Z. Partialkorrelation: rx*y* = rxy.z = (rxy– rxz·ryz) / ((1 – rxz²) · (1 – ryz²)). Frage: Wie korrelieren X und Y bei konstantem Z? • Semipartialkorrelation: rxy* = rx(y.z) = (rxy– rxz·ryz) / (1 – ryz²). ZYX Frage: Wieviel trägt Y zu X bei über das hinaus, was Z beiträgt? SemiPartialkorrelation und Varianz • Partialkorrelation: rxy.z² = (rxy– rxz·ryz)² / ((1 – rxz²) · (1 – ryz²)). • Semipartialkorrelation: rx(y.z)² = (rxy– rxz·ryz)² / (1 – ryz²). rx(y.z)²·Vxx rxz²·Vxx (1–rxz²) ·Vxx Vxx Multiple Regression • • • • • • • • yi = a + b · xi + ei , y'i = a + b · xi yi = a + b1 · x1i + b2 · x2i + b3 · x3i + … + ei y'i = a + b1 · x1i + b2 · x2i + b3 · x3i + … standardisierte (z-transformierte) Variablen: n: „Standardpartialregressionskoeffizienten“ n ryxn, z.B. 2 Prädikatoren: 1 = (ry1–ry2·r12) / (1–r12²) ry(1.2) = (ry1–ry2·r12) / (1–r12²) nicht standardisierte Variablen: bn = n· Sy / Sxn Multiple Korrelation: Ry,123... = ryy' R² = Anteil der insgesamt erklärten Varianz R²y,1234... = r²y1 + r²y(2.1) + r²y(3.21) + r²y(4.321) + ... bivariat: Ry,x = ryy' = |rxy| Schrittweise Regression • Y wird vorhergesagt aus k Prädiktoren Xn. • Die Prädiktoren sind unterschiedlich „nützlich“: zur Erhöhung von R². Uj = R²mit j – R²ohne j (hängt von den anderen eingeschlossenen Prädikatoren ab). • Vorwärts-Technik: Beginne mit 0 Prädikatoren, nimm denjenigen hinzu, der R² am meisten erhöht, bis Beitrag von Xj unterhalb eines Kriteriums. • Rückwärts-Technik: Beginne mit k Prädikatoren, laß denjenigen weg, der R² am wenigsten schadet, solange Beitrag von Xj unterhalb eines Kriteriums. • Kombinierte Vorwärts/Rückwärts-Technik. • Abhängig von der Abfolge.... kontraintuitiv: Suppression • X1 korreliert mäßig mit Y... • X2 korreliert gar nicht mit Y. • Trotzdem verbessert sich R², wenn X2 hinzugenommen wird. • Y wird durch Merkmal A bestimmt, X1 zu 30% durch Merkmal A, zu 70% durch Merkmal B, (und korreliert daher auch nur mäßig mit Y) X2 wird durch Merkmal B bestimmt. • Es gibt eine Linearkombination von X1 und X2, die allein durch Merkmal A bestimmt wird.