5.6. Beispiele zum Erwartungswert und zur Varianz.

Werbung

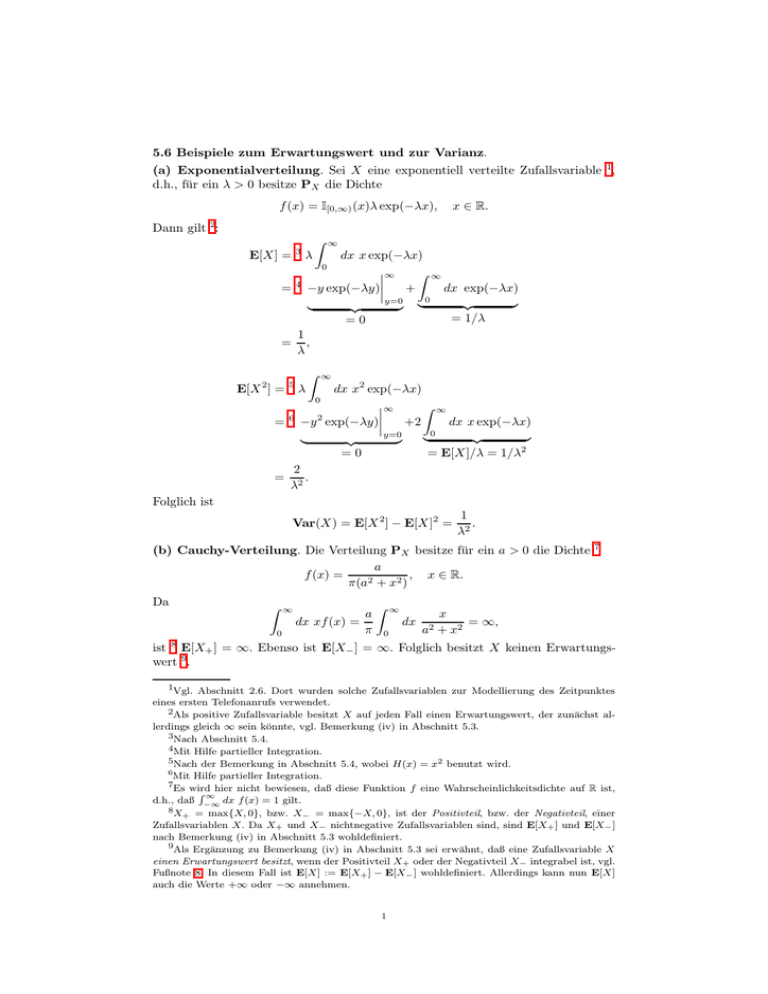

5.6 Beispiele zum Erwartungswert und zur Varianz.

(a) Exponentialverteilung. Sei X eine exponentiell verteilte Zufallsvariable 1,

d.h., für ein λ > 0 besitze PX die Dichte

f (x) = I[0,∞) (x)λ exp(−λx),

x ∈ R.

Dann gilt 2:

3

E[X] =

λ

Z

∞

dx x exp(−λx)

∞

Z ∞

−y exp(−λy)

+

dx exp(−λx)

0

y=0

{z

}

|

{z

} |

= 1/λ

=0

0

=

4

=

1

,

λ

2

E[X ] =

5

Z

∞

dx x2 exp(−λx)

∞

Z ∞

2

−y exp(−λy)

+2

dx x exp(−λx)

0

y=0

{z

}

|

|

{z

}

= E[X]/λ = 1/λ2

=0

λ

=

6

=

2

.

λ2

0

Folglich ist

Var(X) = E[X 2 ] − E[X]2 =

1

.

λ2

(b) Cauchy-Verteilung. Die Verteilung PX besitze für ein a > 0 die Dichte

a

, x ∈ R.

f (x) =

2

π(a + x2 )

Da

Z

0

∞

dx xf (x) =

a

π

Z

0

∞

dx

a2

7

x

= ∞,

+ x2

8

ist E[X+ ] = ∞. Ebenso ist E[X− ] = ∞. Folglich besitzt X keinen Erwartungswert 9.

1Vgl. Abschnitt 2.6. Dort wurden solche Zufallsvariablen zur Modellierung des Zeitpunktes

eines ersten Telefonanrufs verwendet.

2Als positive Zufallsvariable besitzt X auf jeden Fall einen Erwartungswert, der zunächst allerdings gleich ∞ sein könnte, vgl. Bemerkung (iv) in Abschnitt 5.3.

3Nach Abschnitt 5.4.

4Mit Hilfe partieller Integration.

5Nach der Bemerkung in Abschnitt 5.4, wobei H(x) = x2 benutzt wird.

6

Mit Hilfe partieller Integration.

7Es wird hier nicht bewiesen, daß diese Funktion f eine Wahrscheinlichkeitsdichte auf R ist,

R∞

d.h., daß −∞

dx f (x) = 1 gilt.

8X = max{X, 0}, bzw. X = max{−X, 0}, ist der Positivteil, bzw. der Negativteil, einer

+

−

Zufallsvariablen X. Da X+ und X− nichtnegative Zufallsvariablen sind, sind E[X+ ] und E[X− ]

nach Bemerkung (iv) in Abschnitt 5.3 wohldefiniert.

9Als Ergänzung zu Bemerkung (iv) in Abschnitt 5.3 sei erwähnt, daß eine Zufallsvariable X

einen Erwartungswert besitzt, wenn der Positivteil X+ oder der Negativteil X− integrabel ist, vgl.

Fußnote 8. In diesem Fall ist E[X] := E[X+ ] − E[X− ] wohldefiniert. Allerdings kann nun E[X]

auch die Werte +∞ oder −∞ annehmen.

1

2

an

Zur Beschreibung eines typischen, mittleren Werts“ bietet sich hier der Medi”

10

an, d.h. eine Zahl m ∈ R mit

Z m

Z ∞

1

dx f (x) =

dx f (x) = .

2

−∞

m

Hier ist m eindeutig bestimmt und wegen der Symmetrie von f gilt m = 0.

(c) Normalverteilung. Die Verteilung PX der Zufallsvariablen X besitze die

Dichte

(x − µ)2 1

, x ∈ R,

f (x) = √

exp −

2σ 2

2πσ 2

wobei µ ∈ R und σ 2 > 0.

(i) Existenz der Momente der Normalverteilung. Für alle r ≥ 1 gilt:

xµ x2 |x|r f (x) ≤ C|x|r exp − 2 exp 2

2σ

| {zσ }

1 x2

+ µ2

≤ 11 C1 exp 2

σ

4

x2 x2 ≤ C2 |x|r exp − 2 exp − 2

8σ

{z 8σ }

|

≤ C3 , gleichmäßig in x ∈ R

x2 ≤ C4 exp − 2 , x ∈ R,

8σ

wobei

C,

C

,

.

.

.

von

r,

µ

und

σ 2 abhängige positive Konstanten sind. Da

1

R∞

2

dx exp(−βx ) < ∞ für alle β > 0, existieren alle Momente der Normal−∞

verteilung.

(ii) Erwartungswert der Normalverteilung.

Z ∞

dx xf (x)

E[X] =

−∞

Z

(x − µ)2 dx (x − µ) exp −

2σ 2

−∞

|

{z

}

= 12 0

Z ∞

(x − µ)2 1

dx exp −

+µ √

2σ 2

2πσ 2 −∞

{z

}

|

13

=

1

= µ.

1

= √

2πσ 2

∞

(iii) Varianz der Normalverteilung.

Var(X) = E (X − E[X])2

10

Vgl. Abschnitt 2.3.4.

11Beachte, daß

|ab| ≤

”

1 “ a2

+ αb2 ,

2 α

a, b ∈ R, α > 0,

was aus der Beziehung

„

«2

√

|a|

a2

0 ≤ √ − α|b|

=

+ αb2 − 2|ab|,

α

α

a, b ∈ R, α > 0,

folgt. Hier wird a = x, b = µ und α = 2 benutzt.

12Da der Integrand antisymmetrisch bzgl. µ ist.

13

Hier wird eine Wahrscheinlichkeitsdichte über den ganzen Raum R integriert.

21. Dezember 2007

3

Z ∞

(x − µ)2 1

√

dx (x − µ)2 exp −

2σ 2

2πσ 2 −∞

Z

∞

z2

σ2

dz z 2 exp −

= 15 √

2

2π −∞

Z ∞

z2 2 ∞

2

y 1

σ

2

√

dz exp −

+σ

= − √ y exp −

2 y=−∞

2

2π

2π −∞

{z

}

|

{z

}

|

=0

= 16 1

= σ2 .

=

14

Die Parameter µ und σ 2 der Normalverteilung sind nun als Erwartungswert,

bzw. Varianz identifiziert worden.

Weiterhin ist das zweite Moment der Normalverteilung durch

E[X 2 ] = Var(X) + E[X]2 = σ 2 + µ2

gegeben.

14Nach (ii) und der Bemerkung in Abschnitt 5.4. Hier wird H mit H(x) = (x − µ)2 benutzt.

√

Mit der Substitution z = (x − µ)/ σ2 .

16

Hier wird eine Wahrscheinlichkeitsdichte über den ganzen Raum integriert.

15

21. Dezember 2007