Informationstheorie

Werbung

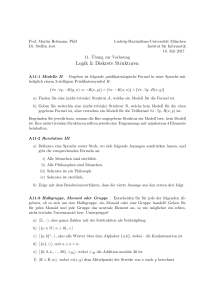

Informationstheorie - (P)Review Contact: Rolf S. Adelsberger [email protected] 1 Looking Back: C/C++ 1.1 MuLö Eine Musterlösung kann bald von meiner Webpage (http://graphics.ethz.ch/~rolfad/teaching/inf_theory/inf_theory.html) runtergeladen werden 1.2 Code C/C++ - Programmieren ist nicht out-of-date :-P. Schaut euch den Code an, um Pointerarithmetik zu oder ASCII zu verstehen... 2 Looking Ahead: Übung 5 2.1 Informationsquelle a) Modellieren der Markov-Quelle b) Stationäre Verteilung: P = p11 p21 p31 p12 p22 p32 PXn = P · PXn−1 stationär(P) ← P̄X = P · P̄X p13 p23 p33 (1) c) Entropierate: X = X 1 , X2 . . . ↓ H̄(X) = lim n→∞ 1 1 H (X1 , X2 . . . , Xn ) n (2) 2.2 Schach als Informationsquelle • Anzahl Zustände? Informationsquelle := Läufer macht einen zufälligen Zug → Wo kann sich der Läufer überall befinden? • Staionäre Verteilung? Ausnutzen der Symmetrien: man kann das Schachbrett vereinfachen... • Entropierate? Siehe oben für Definition der Entropierate H̄ • Läufer als Informationsquelle. 2.3 2.3.1 Codes und Bäume Repetition aus Vorlesung • B sei die Menge eines D-ären Codebaumes T und P (b) die W’keit eines Blattes b ∈ B X P (b) = 1 b∈B • Blattentropie HT = − X P (b) log P (b) b∈B • Mittlere Tiefe tT von T tT = X P (b)t(b) b∈B • Präfixfreier Code C für Zufallsvariable X mit Codebaum T → pX (x) = P (b) mit C(x) = b • Kraft’sche Ungleichung: D-ärer präfixfreier Code mit L Codewörtern der Länge l1 , . . . , lL existiert genau dann (↔), wenn L X D−li ≤ 1 i=1 2.3.2 Aufgabe Gegeben: • C ist präfixfreier Code. • T Codebaum zu C. • Z Menge der inneren Knoten. • B Menge der Blätter. • tT mittlere Blatttiefe von T . 2 a) Beweise: tT ′ = tT + P (bc ) b) Zeige: tT = X P (z) z∈Z Gegeben: z B_z P (z) := X b∈Bz 3 P (b)