E[g(X)]

Werbung

![E[g(X)]](http://s1.studylibde.com/store/data/002437238_1-904729117acad3aaef2cefc6444782e9-768x994.png)

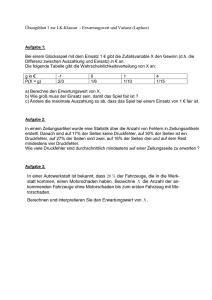

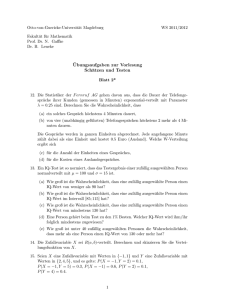

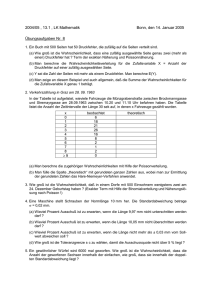

2.5 2.5.1 Parameter einer Verteilung Erwartungswert X eine Zufallsvariable, g : R → R stetig. Der Erwartungswert E[g(X)] von g(X) ist definiert durch: E[g(X)] := X g(xk )w(X = xk ), k falls X diskret ist mit den Werten xk (und falls P k |g(xk )w(X = xk )| < ∞). Z ∞ E[g(X)] := g(x)f (x)dx, −∞ falls X stetig ist (und falls R∞ −∞ |g(x)f (x)|dx < ∞). Speziell für g(X) := X legt man fest: E[X] =: µ heißt Mittelwert von X (oder Mittelwert der Verteilung). 1 Es gilt also E[X] := X xk w(X = xk ), k falls X diskret ist mit den Werten xk (und falls P k |xk w(X = xk )| < ∞). Z ∞ E[X] := xf (x)dx, −∞ falls X stetig ist (und falls 2.5.2 R∞ −∞ |xf (x)|dx < ∞). Rechenregeln für Erwartungswerte X Zufallsvariable, g1, g2 stetige Funktionen von X und a, b ∈ R. Dann ist E[a · g1(X) + b · g2(X)] = a · E[g1(X)] + b · E[g2(X)] Speziell folgt daraus: E[a · X + b] = a · E[X] + b = a · µ + b 2 2.5.3 Varianz X Zufallsvariable mit Mittelwert µ E[(X − µ)2] =: V (X) =: σ 2 heißt Varianz oder mittlere quadratische Abweichung von X. √ σ := σ 2 heißt Standardabweichung (oder mittlerer Fehler) von X. V [a · X + b] = E[((a · X + b) − (a · µ + b))2] = E[a2 · (X − µ)2] = a2 · V [X] Es gilt also die Regel: V [a · X + b] = a2 · V [X] 2.6 Wichtige Verteilungen 1. Null-Eins-Verteilung 1 X nimmt den Wert mit der Wahrschein0 p lichkeit an. 1-p 3 µ = 1 · p + 0 · (1 − p) = p σ 2 = E[(X−µ)2] = (0−p)2 ·(1−p)+(1−p)2 ·p = p2(1−p)+(1−p)2p = p(1−p)(p+1−p) = p(1−p). 2. Binomial- oder Bernoulli-Verteilung Die Wahrscheinlichkeit von A bei einem Versuch sei p. X . . . Anzahl des Auftretens von A bei n unabhängigen Versuchen (z.B. Ziehen mit Zurücklegen!) pk := w(X = k) = n k pk (1 − p)n−k Es gilt: µ=n·p und σ 2 = npq Rechnung! Für die Binomialverteilung gibt es Tabellen! 4 3. Poisson-Verteilung Für n → ∞ und zugleich p → 0, derart, dass gilt: n · p =: λ = const. geht die Binomialverteilung über in die PoissonVerteilung mit dem Parameter λ: λk −λ w(X = k) = e k! mit λ > 0. Rechnung zeigt: µ = σ2 = λ Für große n und kleine p mit 0 < np ≤ 10 ersetzt man die Binomialverteilung durch die PoissonVerteilung mit dem Paramter λ = np. Warum? Weil man damit leichter rechnen kann und (fast) das Gleiche herauskommt. 5 Es gilt: w(0) = e−λ ⇒ Für die Poisson-Verteilung gilt: λ = − ln(w(0)) Anwendung der Poisson-Verteilung: Ein Ereignis A trete immer wieder einmal zufällig ein, z.B.: Vorbeifahren eines Autos an einam bestimmten Messpunkt Emission eines α-Teilchens beim radioaktiven Zerfall einer bestimmten Probe Ankommen eines Telefonanrufs bei der Beschwerdestelle Vorkommen eines Druckfehlers in einem Buch Dann hat die Zufallsvariable Xt: ”Anzahl des Auftretens von A in dem Zeitintervall [t0, t0 + t]“ 6 für jedes t > 0 eine Poisson-Verteilung, wenn gilt: (a) w(Xt = k) ist unabhängig von t0 und stetig in t. (b) In verschiedenen (nicht überlappenden) Zeitintervallen sind die Anzahlen voneinander unabhängig. (c) limt→0 1t · w(Xt > 1) = 0. In einem Buch mit 200 Seiten gibt es 20 Druckfehler, die rein zufällig verteilt sind. (Der Setzer hatte nie einen Tiefpunkt, das zweimalige Korrekturlesen ist unabhängig erfolgt usw.) 20 Auf einer Seite gibt es durchschnittlich 200 = 0, 1 Druckfehler. Parameter λ = 0, 1. Frage: Auf wievielen Seiten sind genau zwei Druckfehler zu erwarten? 7 w(X = 2) = λ2 2! · e−λ = 0,01 2 · e−0,1 ≈ 0, 0045 Auf ungefähr 200 · 0, 0045 = 0, 9 ≈ 1 Seiten sind genau zwei Druckfehler zu erwarten. In einem Buch mit 200 Seiten gibt es 200 Druckfehler. Auf einer Seite gibt es durchschnittlich einen Druckfehler. Parameter λ = 1. Frage: Auf wievielen Seiten sind genau zwei Druckfehler zu erwarten? w(X = 2) = λ2 2! · e−λ = 12 · e−1 ≈ 0, 1839 Auf ungefähr 200 · 0, 1839 = 36, 78 ≈ 37 Seiten sind genau zwei Druckfehler zu erwarten. Für die Poisson-Verteilung gibt es Tabellen! 8 4. Gleichverteilung oder Rechtecksverteilung Stetige Verteilung mit konstanter Wahrscheinlichkeitsdichte f auf einem Intervall [a, b]. Dann ist f (t) = sonst. 1 b−a für a ≤ t ≤ b, f (t) = 0 Verteilungsfunktion: Z x F (x) = f (t)dt = −∞ 0 für x ≤ a für a ≤ x ≤ b für x ≥ b x−a b−a 1 Der Mittelwert µ ist Z Z ∞ x · f (x)dx = µ= −∞ a b 1 x· dx = b−a b 2 − a2 1 · b−a 2 Folglich ist µ = a+b 2 . Die Varianz 2 2 Z ∞ σ = E[(X − µ) ] = (x − µ)2 · f (x)dx = −∞ Z b (x2 − 2µx + µ2) · f (x)dx = a 9 1 b3 − a3 b 2 − a2 ( − 2µ + µ2(b − a)) = b−a 3 2 1 2 1 1 (b + ab + b2) − (a + b)2 + (a + b)2 = 3 2 4 1 (4(b2 + ab + b2) − 3(a + b)2) = 12 1 2 1 2 (b − 2ab + a ) = (b − a)2 12 12 5. Normalverteilung Die Normalverteilung N (µ; σ 2) mit Mittelwert µ und Varianz σ 2 ist die wichtigste stetige Verteilung! (a) Viele Zufallsvariable sind normalverteilt. (b) Viele weitere Zufallsvariable sind näherungsweise normalverteilt. (c) Entsteht eine Zufallsvariable als Summe (oder als Mittelwert) von vielen (mindestens dreißig) unabhängigen Zufallsvariablen, so ist sie näherungsweise normalverteilt. (Mitteilung ohne Beweis) (d) Aus (c) folgt: Die Binomialverteilung ist für große n (ungefähr n·p ≥ 5 und n·(1−p) ≥ 5) näherungsweise eine Normalverteilung. 10 Nicht begründbar aber meist richtig: Unterliegt eine Größe vielen zufälligen unabhängigen Einflussen, so ist sie in der Regel normalverteilt. Beispiele: Körpergröße erwachsener Männer Körpergröße erwachsener Frauen Intelligenzquotient in der Bevölkerung Füllmenge in Verpackungen (meistens) Brustumfang von Soldaten (Quetelet) Wahrscheinlichkeitsdichte: 1 2 − 12 ( t̃−µ σ ) f (t̃) = √ e 2π · σ Setzt man der Dichte t̃−µ σ =: t, so erhält man N (0; 1) mit 1 − 1 t2 φ(t) = √ e 2 2π und der Verteilungsfunktion 11 1 Φ(x) := w(X ≤ x) = √ 2π Z x 1 2 e− 2 t dt −∞ Φ kann man in Tabellen nachschlagen. Der Graph von φ ist die berühmte Gaußsche Glockenkurve (siehe Tafelskizze). Für die Normalverteilung gibt es Tabellen! 12