Zufallsvariablen [random variable]

Werbung

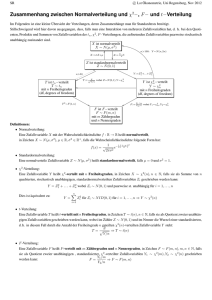

![Zufallsvariablen [random variable]](http://s1.studylibde.com/store/data/003130314_1-bd95708f12c830d464ff6370b45f84e7-768x994.png)

Zufallsvariablen [random variable]

Eine Zufallsvariable (Zufallsgröße) X beschreibt (kodiert) die

Versuchsausgänge ω ∈ Ω mit Hilfe von Zahlen,

d.h. X ist eine Funktion

X : Ω→R

ω 7→ X(ω)

Zufallsvariablen werden meist mit Großbuchstaben

bezeichnet (z.B. X, Y, Z, X1 , X2 , X3 , . . .).

Die Funktionswerte (Realisierung, Wert für einen konkreten

Versuchsausgang ω) werden meist mit kleinen Buchstaben

bezeichnet (z.B. x, y, z, x1 , x2 , x3 , . . .).

1

Beispiel: Würfeln mit zwei Würfeln

Ω = {(1, 1), (1, 2), . . . , (6, 6)}

X

...

Summe der Augenzahlen

z.B.: X((3, 4)) = 7

Y

...

Maximum der Augenzahlen

z.B.: Y ((3, 4)) = 4

Der Zufall steckt nicht in der Funktion X, sondern im

zufälligen Versuch mit Ausgang ω.

2

Es interessieren z.B. die folgenden Ereignisse:

{X ≤ x} = {ω ∈ Ω | X(ω) ≤ x} ⊆ Ω,

{X = x} = {ω ∈ Ω | X(ω) = x} ⊆ Ω,

{X > x} = {ω ∈ Ω | X(ω) > x} ⊆ Ω,

Die Wahrscheinlichkeiten dieser Ereignisse lassen sich

berechnen.

Beispiel: (s.o.)

P (X = 7) = P ({ω ∈ Ω | X(ω) = 7})

= P ({(1, 6), (2, 5), (3, 4), (4, 3), (5, 2), (6, 1)})

=

6

1

=

36

6

3

Problem:

Welche Werte x kann die Zufallsvariable X mit welcher

Wahrscheinlichkeit annehmen?

Vorteil von Zufallsvariablen:

Man kann mit ihnen rechnen; z.B. ist X + Y ebenfalls eine

Zufallsvariable.

Nachteil von Zufallsvariablen:

Mit einer Zufallsvariablen X kann eine Vergröberung der

Ausgänge des zufälligen Versuches verbunden sein;

z.B. Summe der Augenzahlen statt der einzelnen

Augenzahlen.

4

Diskrete Zufallsvariable [discrete random variable]

Eine Zufallsvariable, die nur endlich viele Werte (x1 , . . . , xn )

oder abzählbar unendlich viele Werte (x1 , x2 , . . .) annehmen

kann, heißt diskrete Zufallsvariable.

Beispiel: Idealer Farbwürfel

Ω = {schwarz, rot, gelb, grün, blau, weiß }

X(schwarz) = 1, X(rot) = 2, X(gelb) = 3, X(grün) = 4,

X(blau) = 5, X(weiß) = 6

Mögliche Werte für xi sind 1, 2, 3, 4, 5, 6.

1

P (X = xi ) =

6

5

Verteilungstabelle:

xi

x1

x2

...

pi

p1

p2

...

Beispiel: X = Summe der Augenzahlen bei zwei Würfeln

(Werte zwischen 2 und 12)

xi

2

3

4

5

6

7

8

9

10

11

12

pi

1

36

2

36

3

36

4

36

5

36

6

36

5

36

4

36

3

36

2

36

1

36

(Probe: Summe der Wahrscheinlichkeiten = 1)

6

Die Verteilungstabelle beschreibt die Verteilung der

Zufallsvariable vollständig; d.h. aus ihr lassen sich die

Wahrscheinlichkeiten aller interessierenden Ereignisse für die

Zufallsvariable berechnen.

Beispiel: (s.o.)

P (6 ≤ X ≤ 8) = P ({X = 6} ∪ {X = 7} ∪ {X = 8})

= P (X = 6) + P (X = 7) + P (X = 8)

=

5

6

5

16

4

+

+

=

=

36

36

36

36

9

Grafische Darstellung diskreter Verteilungen:

Balkendiagramme

7

Unabhängige Zufallsvariablen

[independent random variables]

Zwei diskrete Zufallsvariablen X und Y heißen unabhängig,

wenn

P (X = x, Y = y) = P (X = x) · P (Y = y)

für alle x, y ∈ R gilt.

Bemerkungen:

– P (X = x, Y = y) = P ({X = x} ∩ {Y = y})

– Für alle x, y ∈ R sind die Ereignisse

{X = x}

und

unabhängig.

8

{Y = y}

Erwartungswert einer diskreten Zufallsvariablen

[expectation (mean) of a discrete random variable]

E(X) =

n

X

p i xi

bzw.

E(X) =

i=1

∞

X

p i xi

i=1

(falls der Grenzwert existiert)

Beispiel: Idealer Würfel

1

1

1

· 1 + · 2 + · · · + · 6 = 3.5

6

6

6

Der Erwartungswert beschreibt den Schwerpunkt der

Verteilung; vgl. arithmetisches Mittel in deskriptiver Statistik:

k

k

k

X

X

1 X

ni

x̄ =

ni xi =

xi =

fi xi

n i=1

n

i=1

i=1

9

Varianz (Streuung) einer diskreten Zufallsvariablen

[variance of a discrete random variable]

var(X) =

n

X

pi (xi − E(X))2

i=1

bzw.

var(X) =

∞

X

pi (xi − E(X))2

i=1

(falls der Erwartungswert und der Grenzwert existieren)

Es gilt:

2

2

2

var(X) = E(X−E(X)) = E(X )− E(X)

=

X

(vgl. Stichprobenvarianz bzw. empirische Varianz in

deskriptiver Statistik)

10

X

pi x2i −

p i xi

2

Beispiel: Idealer Würfel

var(X) =

6

X

i=1

pi x2i −

6

X

!2

p i xi

i=1

1

1

1

1

1

1

· 1 + · 22 + · 32 + · 42 + · 52 + · 62 − 3.52

6

6

6

6

6

6

1

=

(1 + 4 + 9 + 16 + 25 + 36) − 3.52

6

1

=

· 91 − 3.52

6

≈ 2, 92

=

11

Rechenregeln für Erwartungswert und Varianz

Seien X, Y Zufallsvariablen und a, b ∈ R. Dann gilt

E(a · X + b) = a E(X) + b

var(a · X + b) = a2 var(X)

E(X + Y ) = E(X) + E(Y )

Wenn X und Y unabhängig sind, gilt außerdem

var(X + Y ) = var(X) + var(Y )

Bemerkung: Diese Rechenregeln gelten nicht nur für

diskrete, sondern auch für beliebige Zufallsvariablen.

12

Binomialverteilung [binomial distribution]

Ein Versuch wird unter konstanten Bedingungen n–mal

unabhängig wiederholt. Registriert wird jeweils nur das

Eintreten eines interessierenden Ereignisses A (Erfolg).

X bezeichne die Anzahl der Erfolge in den n Versuchen,

ϑ = P (A) die Erfolgswahrscheinlichkeit in jedem Einzelversuch.

P (X = k) =

n

k

!

ϑk (1 − ϑ)n−k ,

k = 0, 1, . . . , n

X heißt dann binomialverteilt mit Parametern n und ϑ.

Bezeichnung: X ∼ B(n; ϑ)

13

Es gilt:

E(X) = n · ϑ

var(X) = n · ϑ · (1 − ϑ)

Beispiel: 3–maliges Werfen eines idealen Würfels

X . . . Anzahl des Auftretens der Augenzahl 6

P (X = 1) =

! 3

1 1

1

6

= 3·

1 25

·

6 36

≈ 0.35

14

1

1−

6

3−1

Stetige Zufallsvariable [continuous random variable]

Eine Zufallsvariable die alle reellen Zahlen oder alle reellen

Zahlen aus einem gegebenen Intervall annehmen kann heißt

stetige Zufallsvariable.

Die Verteilung einer stetigen Zufallsvariablen X wird mit

Hilfe ihrer (nichtnegativen) Dichtefunktion fX [density

function] (beschreibt die Form einer Verteilung) angegeben.

Die Wahrscheinlichkeit, dass die Zufallsvariable X Werte in

einem Intervall [a, b] annimmt, ergibt sich als Integral dieser

Dichte über dem Intervall:

P (X ∈ [a, b]) = P (a ≤ X ≤ b) =

Z b

fX (x)dx

a

15

Häufig wird mit der Verteilungsfunktion [distribution

function] FX , die durch

FX (x) = P (X ≤ x) =

Z x

−∞

fX (z)dz

gegeben ist, gearbeitet:

P (a ≤ X ≤ b) =

Z b

fX (x)dx = FX (b) − FX (a)

a

Erwartungswert und Varianz einer stetigen

Zufallsvariablen X:

Z ∞

E(X) =

x fX (x) dx

−∞

Z ∞

var(X)

=

−∞

(x − E(X))2 fX (x) dx

(falls die Integrale existieren)

16

Bemerkungen:

Sei X eine stetige Zufallsvariable.

– Für jeden Einzelwert x gilt P (X = x) = 0.

– Daher sind die Wahrscheinlichkeiten P (a < X < b),

P (a < X ≤ b), P (a ≤ X < b) und P (a ≤ X ≤ b) alle

gleich.

Unabhängige Zufallsvariablen

Zwei (stetige) Zufallsvariablen X und Y heißen unabhängig,

wenn

P (X ≤ x, Y ≤ y) = P (X ≤ x) · P (Y ≤ y)

für alle x, y ∈ R gilt.

17

Normalverteilung [normal distribution]

Dichtefunktion der Normalverteilung (Gaußsche

Glockenkurve):

(x−µ)2

1

fX (x) = √ · e− 2σ2 ,

σ 2π

−∞ < x < ∞

mit Parameter µ ∈ R und σ ∈ (0, ∞).

Bezeichung: X ∼ N (µ, σ 2 )

Bedeutung der Parameter: E(X) = µ, var(X) = σ 2

18

Bemerkungen:

– Wichtigste stetige Verteilung, da viele Größen

näherungsweise normalverteilt sind.

(C. F. Gauß: Beschreibung von Messfehlern)

– Der Zentrale Grenzwertsatz besagt, dass die Verteilung

von Summen von unabhängigen Zufallsvariablen in vielen

Fällen gut durch eine Normalverteilung angenähert werden

kann.

– Die Verteilungsfunktion einer Normalverteilung ist keine

elementare Funktion, also nicht mit einer ”Formel”

darstellbar.

19

– Es gilt

P (µ − σ ≤ X ≤ µ + σ) = 0.68

P (µ − 2σ ≤ X ≤ µ + 2σ) = 0.95

P (µ − 3σ ≤ X ≤ µ + 3σ) = 0.997

20

Mathematische Stichprobe [random sample]

Die Zufallsvariablen X1 , . . . , Xn bilden eine (mathematische)

Stichprobe, wenn sie unabhängig sind und die gleiche

Verteilung besitzen [i.i.d.].

In diesem Fall bezeichnen wir mit

n

1X

Xi

X=

n i=1

das Stichprobenmittel und mit

2

SX

n

1 X

=

(Xi − X)2

n − 1 i=1

die Stichprobenvarianz.

Hinweis: X und S 2 sind Zufallsvariablen.

21

Das Modell der Mathematischen Stichprobe ist die

Grundlage der schließenden Statistik!

22

t–Verteilung

Sei X1 , . . . , Xn eine Stichprobe von N (µ, σ 2 )–verteilten

Zufallsvariablen. Die Verteilung der Zufallsvariablen

√

(X − µ) n

Z=

SX

heißt t–Verteilung mit n − 1 Freiheitsgraden.

Die t–Verteilung besitzt eine um Null symmetrische,

glockenförmige Dichte, die sich für großes n der Dichte der

Normalverteilung annähert.

23

χ2 –Verteilung

Sei X1 , . . . , Xn eine Stichprobe von N (0, 1)–verteilten

Zufallsvariablen. Die Verteilung der Zufallsvariablen

Z = X12 + . . . + Xn2

heißt χ2 –Verteilung mit n Freiheitsgraden.

Die Dichten sind für negative Argumente Null. Für positive

Argumente sind sie für kleine n linkssteil und rechtsschief, für

große n nähern sie sich einer Glockenkurve an.

24

Überschreitungswahrscheinlichkeiten [p-values]

Sei Z eine Zufallsvariable. In der schließenden Statistik

interessieren uns oftmals folgende

Überschreitungswahrscheinlichkeiten:

P (Z ≥ z), P (Z ≤ z), P (|Z| ≥ z)

Im Falle um Null symmetrischer Dichten gilt

P (Z ≥ z) = P (Z ≤ −z)

P (|Z| ≥ z) = P (Z ≥ z) + P (Z ≤ −z) = 2 · P (Z ≥ z)

25