Stoff der Vorlesung Wahrscheinlichkeitstheorie

Werbung

Universität Mannheim

Lehrstuhl für Statistik

Prof. Dr. E. Mammen

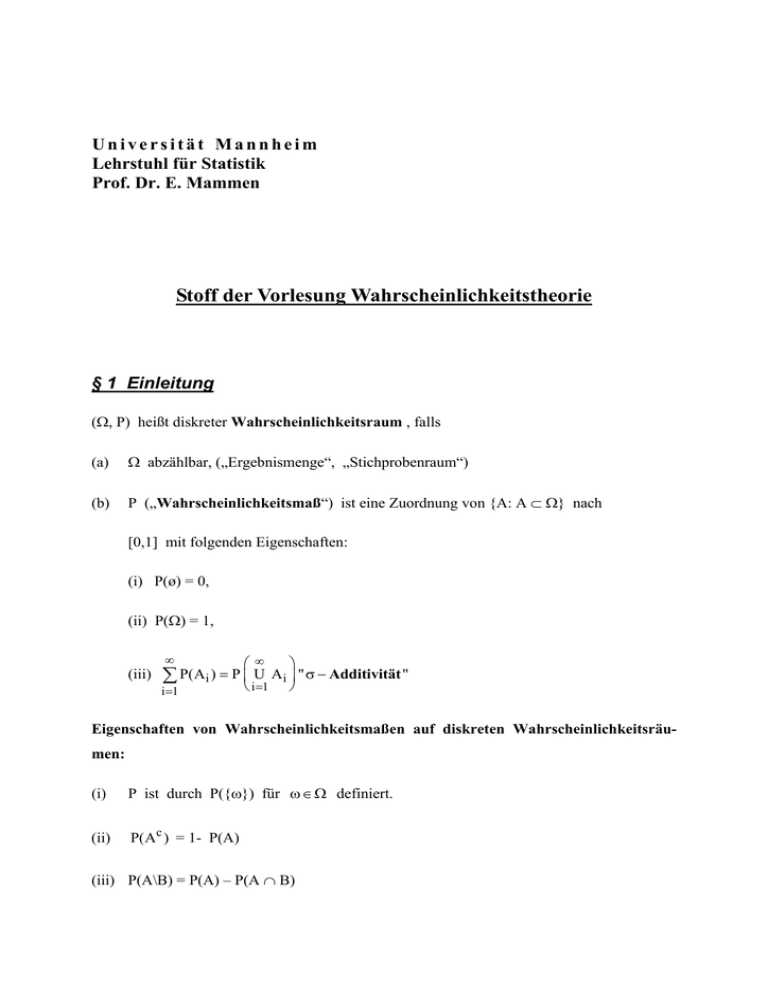

Stoff der Vorlesung Wahrscheinlichkeitstheorie

§ 1 Einleitung

(Ω, P) heißt diskreter Wahrscheinlichkeitsraum , falls

(a)

Ω abzählbar, („Ergebnismenge“, „Stichprobenraum“)

(b)

P („Wahrscheinlichkeitsmaß“) ist eine Zuordnung von {A: A ⊂ Ω} nach

[0,1] mit folgenden Eigenschaften:

(i) P(ø) = 0,

(ii) P(Ω) = 1,

(iii)

∞

⎛∞

⎞

P(A

)

P

=

∑ i

⎜ U Ai ⎟ " σ − Additivität "

⎝ i =1 ⎠

i =1

Eigenschaften von Wahrscheinlichkeitsmaßen auf diskreten Wahrscheinlichkeitsräumen:

(i)

P ist durch P({ω}) für ω∈ Ω definiert.

(ii)

P(Ac ) = 1- P(A)

(iii) P(A\B) = P(A) – P(A ∩ B)

2

(iv) P(A ∪ B) = P(A) + P(B) – P(A ∩ B)

(v)

P(A) ≤ P(B) für A ⊂ B “Monotonie”

(vi)

P( U Ai ) ≤ ∑ P(Ai ).

n

n

i =1

i =1

Jede Funktion X : Ω → ℵ heißt (ℵ-wertige) Zufallsvariable. (ℵ beliebige Menge). Anschauliche Interpretation: X ist „zufälliges Element von ℵ“. Px (A) = P(X ∈ A) = P(X −1(A))

= P({ω : X(ω) ∈ A}) für A ⊂ ℵ heißt Bildmaß von X unter P oder Verteilung von X.

Interpretation: (Ω, P) beschreibt den zugrunde liegenden Zufallsgenerator. Er legt das Er-

gebnis für alle im Modell betrachteten Zufallsvariablen fest. In Anwendungen ist meist die

intuitive Bedeutung der Zufallsvariablen zunächst gegeben. Dann wird ein Wahrscheinlichkeitsraum (Ω, P) gewählt und die Zufallsvariablen als Funktionen modelliert. Die Wahl von

(Ω, P) ist nicht eindeutig und wird oft nicht explizit angegeben.

§ 2 Laplaceansatz

Eine Modellierung, in der (Ω, P) so gewählt wird, dass P({ω}) =

1

für alle ω ∈Ω gilt,

#Ω

heißt Laplaceansatz.

n! = n · (n-1) ·…· 1 Anzahl möglicher Anordnungen einer n elementigen Menge.

3

( nk ) = k!(nn!− k)!

Anzahl k-elementiger Teilmengen einer n-elementigen Menge.

(„Binomial Koeffizient“)

n

( k ...k

)=

1

r

n!

Anzahl der Möglichkeiten, eine n elementige Menge auf r disjunkte

k1 ! ⋅ K ⋅ k r !

Klassen mit k1 bzw. … bzw. kr Elementen aufzuteilen („Multinomialkoeffizient“).

Binomialverteilung, Multinomialverteilung, Hypergeometrische Verteilung, Poissonverteilung, Gleichverteilung.

Poissonapproximation: Eine binomialverteilte Zufallsvariable (Parameter : n, p) mit n

groß, p klein ist approximativ Poissonverteilt mit Parameter λ = np.

Formaler: Sei Xn ~ Bin (n, λ/n), X ~ Pois(λ). Dann P(Xn∈A) → P(X∈A) für n → ∞ mit

A ⊂ {0, 1, 2, …}.

§ 3 Bedingte Wahrscheinlichkeiten, Unabhängigkeit

P(B⎟A) =

P(A ∩ B)

heißt bedingte Wahrscheinlichkeit von B gegeben A. c2. Die ZuP(A)

ordnung B P(B⎟A) ist Wahrscheinlichkeitsmaß.

Formel von der totalen Wahrscheinlichkeit:

4

k

P(B) = ∑ P(B Ai ) P(Ai )

i =1

für paarweise disjunkte A1, A2, … ⊂ Ω mit A1 ∪…∪ Ak = Ω.

Multiplikationsformel:

P(B1 ∩…∩ Bn) = P(B1) P(B2⎟B1) ·…· P(Bn⎟B1 ∩…∩ Bn-1), falls P(B1 ∩…∩ Bn) > 0.

Bayesformel:

P(A ) P(B Ai )

P(Ai B) = k i

∑ P(A j ) P(B A j )

j=1

für paarweise disjunkte A1, A2, … ⊂ Ω mit A1 ∪ … Ak = Ω mit A1 ∪ … ∪ Ak = Ω.

Simpson′schses Paradoxon.

Zwei Ereignisse A, B heißen unabhängig, wenn gilt:

P(A ∩ B) = P(A) P(B)

5

Zufallsvariablen X1, …, Xn (mit Werten in ℵ1, …, ℵn) heißen unabhängig, wenn für alle

Mengen B1 ⊂ ℵ1, …, Bn ⊂ ℵn gilt:

P(X1∈B1, …, Xn∈Bn) = P(X1∈B1) ·…· P(Xn∈Bn).

X1, X2 unabhängig, X1 ~ Pois (λ1), X2 ~ Pois (λ2). Dann X1 + X2 ~ Pois (λ1 + λ2).

§ 4 Momente, Erwartungswerte

X Zufallsvariable auf diskreten Wahrscheinlichkeitsraum (Ω, P) mit Werten in ℝ.

∑

E [X] : =

x P(X = x) heißt Erwartungswert von X, falls

x möglicher

Wert von X

∑

x

P(X = x)

endlich ist (absolute Konvergenz der Reihe).

x möglicher

Wert von X

Eigenschaften:

(i) E [ X ] =

∑

ω∈Ω

X(ω) P ({ω})

(ii) E [λX ] = λ E [ X ] ,

E [X + Y] = E [X] + E [Y]

für Zufallsvariablen X, Y mit existierendem Erwartungswert und reeller Zahl λ. („Linearität“ des Erwartungswertes.)

(iii) E[X · Y] = E[X] E[Y]

für unabhängige Zufallsvariablen X, Y mit existierendem Erwartungswert.

6

(iv) Sei Z ℵwertige Zufallsvariable und f : ℵ → ℝ Funktion. Dann

E [f (Z)] =

y P ( f (Z) = y )

∑

y möglicher

Wert von f (Z)

∑

=

f (z) P(Z = z)

y möglicher

Wert von Z

=

∑ f ( Z(ω) )

ω∈Ω

P ({ω})

(falls Summen absolut konvergent).

Median, Varianz Var(X), Standardabweichung σx, Kovarianz Cov(X,Y), Korrelation

ρX, Y, k-tes Moment.

Erwartungswert, Varianz der Poissonverteilung, Binomialverteilung, Erwartungswert der hypergeometrischen Verteilung.

Eigenschaften von Varianz, Kovarianz:

(i)

Var(X) = EX2 – (EX)2

(ii)

Var(aX + b) = a2 Var(X)

(iii) Var(X1 + … + Xn) = Var(X1) + … + Var(Xn) für unabhängige X1, …, Xn.

(iv) -1 ≤ ρX, Y ≤ 1.

Cauchy – Schwarz′sche Ungleichung:

(E[XY])2 ≤ E[X2] E[Y2] .

7

Gilt "=" , dann existiert λ∈ℝ mit

Y = λ X.

Tschebyschev′sche Ungleichung:

P(| X – EX| ≥ c) ≤

P (| X | ≥ c ) ≤

Var(X)

,

c2

EX 2

.

c2

Stochastische Konvergenz:

Zn Folge von reellwertigen Zufallsvariablen, Z reellwertige Zufallsvariable (Spezialfall Z

konstante reelle Zahl). Man sagt:

Zn

konvergiert in Wahrscheinlichkeit (oder sto-

chastisch) gegen Z, falls P(|Zn – Z| > ε) → 0 für n → ∞ für alle ε > 0. Schreibweise:

P

Z n ⎯⎯

→ Z.

Eigenschaften:

P

P

(i) Aus X n ⎯⎯

→ 0, Yn ⎯⎯

→ 0 folgt:

P

X n + Yn ⎯⎯

→ 0.

P

P

(ii) Aus X n ⎯⎯

→ X, Yn ⎯⎯

→ 0 folgt:

P

X n Yn ⎯⎯

→ 0.

8

P

(iii) Aus X n ⎯⎯

→ 0, f :

→

stetig folgt:

P

f (X n ) ⎯⎯

→ f (0).

(iv) Aus EX 2n ⎯⎯

→ 0 folgt:

P

X n ⎯⎯

→ 0.

(Argument : Tschebyschev 'sche Ungleichung

P

(v) Aus X n ⎯⎯

→0

folgt i.a. nicht

EX 2n ⎯⎯

→ 0.

Schwaches Gesetz der großen Zahl:

Für X1, …, Xn u.i.v. reellwertige Zufallsvariablen mit EX i2 < + ∞ gilt

Xn =

1

P

→ EX i .

( X1 + K + X n ) ⎯⎯

n

Herleitung mit Tschebyschev′scher Ungleichung wie bei Eigenschaft (iv).

Anmerkung:

Schwaches Gesetz der großen Zahl gilt auch unter der schwächeren Annahme E|Xi| < + ∞.

Herleitung ist dann komplexer.