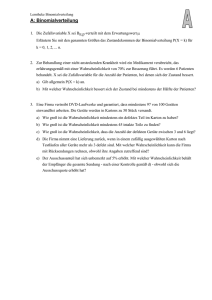

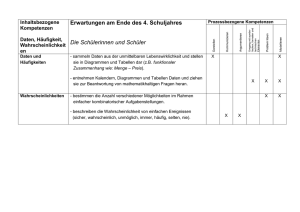

Wahrscheinlichkeitsräume (Teschl/Teschl 2, Kap. 26)

Werbung

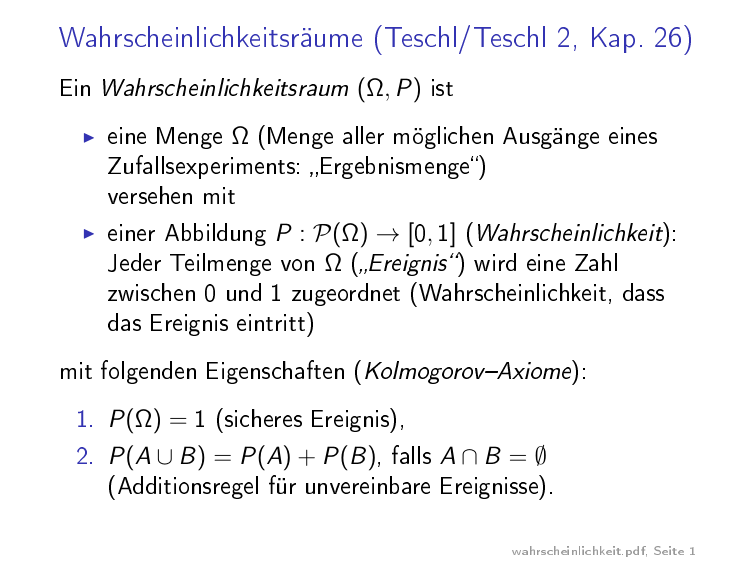

Wahrscheinlichkeitsräume (Teschl/Teschl 2, Kap. 26)

Ein Wahrscheinlichkeitsraum

I eine Menge

Ω

(Ω, P)

ist

(Menge aller möglichen Ausgänge eines

Zufallsexperiments: Ergebnismenge)

versehen mit

P : P(Ω) → [0, 1] (Wahrscheinlichkeit):

Teilmenge von Ω (Ereignis ) wird eine Zahl

I einer Abbildung

Jeder

zwischen 0 und 1 zugeordnet (Wahrscheinlichkeit, dass

das Ereignis eintritt)

mit folgenden Eigenschaften (KolmogorovAxiome):

1.

2.

P(Ω) = 1 (sicheres Ereignis),

P(A ∪ B) = P(A) + P(B), falls A ∩ B = ∅

(Additionsregel für unvereinbare Ereignisse).

wahrscheinlichkeit.pdf, Seite 1

Beispiel fairer Würfel

Ω = {1, ..., 6} mit P({i}) = P(i) =

Augenzahlen i = 1, 2, ..., 6.

bzw. allgemeiner

P(A) =

1

6

· #A

1

6 für jede der möglichen

für jede Teilmenge

(#A bezeichnet die Anzahl der Elemente von

A⊂Ω

A).

Z. B. entspricht das Ereignis

Augenzahl ist nicht durch 3 teilbar der Menge

A = {1, 2, 4, 5}

mit

Für die Ereignisse

C:

P(A) =

B:

4

6

=

2

3.

Augenzahl durch 3 teilbar und

Augenzahl durch 5 teilbar gilt

B = {3, 6}, C = {5} ⇒ B ∩ C = ∅

und

B ∪ C = {3, 5, 6}

und somit

P(B ∪ C ) = P(B) + P(C ) =

1

3

+

1

6

=

1

2

= 50%.

wahrscheinlichkeit.pdf, Seite 2

Ereignisse

Als Ereignisse werden Teilmengen der Ergebnismenge

Ω

bezeichnet. Mengenoperationen beschreiben die Verknüpfung

von Ereignissen.

I

I

I

A ∩ B bedeutet sowohl A als auch B tritt ein,

A ∪ B bedeutet (mindestens) eines der Ereignisse A

B tritt ein,

A = Ω \ A bedeutet das Ereignis A tritt nicht ein

oder

wahrscheinlichkeit.pdf, Seite 3

Folgerungen aus den KolmogorovAxiomen

I

I

I

P(A ∪ B) = P(A) + P(B) − P(A ∩ B) für beliebige A, B ,

P(A) ≤ P(B), falls A ⊂ B (Monotonie),

P(A) = 1 − P(A),

c

wobei A = A = Ω \ A das Komplementärereignis zu A

bezeichnet.

I

P(∅) = 0

(unmögliches Ereignis)

Beispiele

I

I

P(Augenzahl durch 2 oder 3 teilbar )

= P({2, 4, 6}) + P({3, 6}) − P({6}) = 21 + 13 − 61 =

P(Augenzahl nicht durch 3 teilbar )

= 1 − P(Augenzahl durch 3 teilbar ) = 1 − 13 = 32

2

3.

wahrscheinlichkeit.pdf, Seite 4

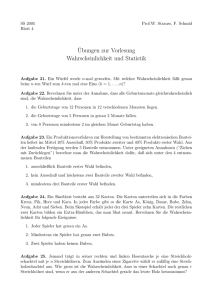

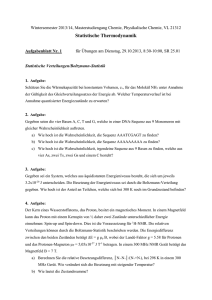

Bestimmung von Wahrscheinlichkeiten

ist auf unterschiedliche Weise möglich. Die wichtigsten sind:

I durch ein Symmetrieprinzip:

Ein Zufallsexperiment hat endlich viele mögliche

Ausgänge, die alle als gleichwahrscheinlich angenommen

werden (Beispiel Augenzahl eines Würfels). Man spricht

von einem LaplaceExperiment.

I durch Schätzung anhand von Beobachtungen

I durch Berechnung ausgehend von bekannten

Wahrscheinlichkeiten

(Beispiel: Wahrscheinlichkeit, bei dreimaligem Würfeln

mindestens eine 6 zu erhalten)

wahrscheinlichkeit.pdf, Seite 5

Ein Laplace-Experiment

ist ein Zufallsexperiment, bei dem alle möglichen Ausgänge

gleich wahrscheinlich sind.

Ω

ist dabei endliche Menge mit

P({x}) =

1

n

für alle

x ∈A

=

1

n

· #A =

1

n

Elementen mit

(Gleichverteilung).

Für eine beliebige Teilmenge

P(A) =

n

A⊂Ω

folgt dann

mal Zahl der Elemente von

A

Zahl der günstigen durch Zahl der möglichen Fälle.

Beispiele

I fairer Würfel

I Münzwurf:

P (Wappen) = P (Zahl) =

1

2

= 50%

I Ziehen einer Spielkarte aus 32:

Die Wahrscheinlichkeit, dass ein Ass gezohen wird, ist

4/32

=

1

8

= 12, 5%.

wahrscheinlichkeit.pdf, Seite 6

Kombinatorik

Zur Bestimmung der Zahl der möglichen Ausgänge eines

Zufallsexperiments sind oft kombinatorische Überlegungen

erforderlich.

Wir betrachten drei Fälle:

I Permutationen: Zusammenstellungen von verschiedenen

Objekten in unterschiedlicher Reihenfolge

I Variationen: Auswahl einer Teilmenge von Objekten mit

Beachtung der Reihenfolge,

entweder mit oder ohne Wiederholung

I Kombinationen: Auswahl ohne Beachtung der Reihenfolge

wahrscheinlichkeit.pdf, Seite 7

Permutationen

Zahl der Möglichkeiten,

n

Elemente anzuordnen, ist gleich

Pn = n · (n − 1) · ... · 2 · 1 = n!

Beispiel 1:

Fakultät).

Traveling Salesman Problem

Geschäftsreisender besucht nacheinander

⇒ n!

(n

n

Orte

mögliche Reiserouten.

Beispiel 2

Zum Bespiel gibt es

P5 = 5! = 120

fünfstellige Zahlen, in

denen jede der Ziern 1, 2, 3, 4 und 5 genau einmal vorkommt.

wahrscheinlichkeit.pdf, Seite 8

Variationen (geordnete Auswahl) ohne Wiederholung

n!

= n · (n − 1) · ... · (n − k + 1)

(n−k)!

Möglichkeiten, k aus n Elementen auszuwählen, wenn die

Es gibt

Vnk =

Reihenfolge der Auswahl eine Rolle spielt.

Beispiel 1

In einer Liga mit 18 Mannschaften gibt es

5

V18

= 18 · 17 · 16 · 15 · 14 = 1.028.160

Möglichkeiten für die

Belegung der ersten 5 Tabellenplätze.

Beispiel 2

Es gibt

5

V26

=

26!

21!

= 26 · 25 · ...

22

= 7 893 600

aus

5 Kleinbuchstaben bestehende Passwörter, in denen kein

Buchstabe mehrfach vorkommt.

wahrscheinlichkeit.pdf, Seite 9

Variationen mit Wiederholung

Kann jedes Element mehrfach ausgewählt werden, so gibt es

k

bei der Auswahl von k aus n Elementen n Möglichkeiten.

Beispiele

I Beim viermaligen Werfen eines Würfels sind (bei

Berücksichtigung der Reihenfolge) 6

4

= 1296 verschiedene

Ergebnisse möglich, die Wahrscheinlichkeit für eine

Augenkombination (z. B. 3, 6, 6, 5) beträgt 1/1296.

I Es gibt 55

= 3125

fünfstellige Zahlen, die keine anderen

Ziern als 1, 2, 3, 4 und 5 enthalten.

wahrscheinlichkeit.pdf, Seite 10

Kombinationen

Die Zahl der Möglichkeiten,

k

von

n

Elementen auszuwählen,

ohne Beachtung der Reihenfolge (Kombinationen), ist gleich

n!

=

(n − k)! · k!

n

n

= Cnk

k

ist gleich der Anzahl der

k

nelementigen Menge.

Dabei setzt man 0!

=1

und

(Binomialkoezient n über

k elementigen

n

k

=0

falls

k ).

Teilmengen einer

k >n

oder

k < 0.

Beispiel

Die Zahl der Möglichkeiten beim Lotto 6 aus 49 ist

49

6

=

49!

43!

· 6!

=

49

· 48 · 47 · 46 · 45 · 44

= 13 983 816.

6·5·4·3·2·1

Die Wahrscheinlichkeit für eine bestimmte Zahlenkombination

ist damit 1/13.983.816

< 0, 00001%

wahrscheinlichkeit.pdf, Seite 11

Eigenschaften der Binomialkoezienten

Für Binomialkoezeineten gibt es eine Reihe von

Rechenregeln. Die wichtigsten sind:

I

I

I

n

0

=

=

n

=

n

1

2

n

n

=1

n

=

n−1

n·(n−1)

n

Pn−1

= j=

1 j = 1 + 2 + ... + (n − 1)

2

n

n

I

= n−k

k

(Symmetrie: Auswahl von

k

aus

n

Objekten ist

gleichbedeutend mit der Bestimmung von

I

I

n−k

Pn

Objekten, die nicht ausgewählt werden)

n

n

k=0 k = 2

(Anzahl aller Teilmengen einer

n+1

k

=

n

k

+

n

k−1

nelementigen

Menge)

(Summationseigenschaft)

wahrscheinlichkeit.pdf, Seite 12

Das Pascalsche Dreieck

liefert eine rekursive Berechnung der Binomialkoezienten mit

Hilfe der Summationseigenschaft:

n + 1-te Zeile enthält die Binomialkoezienten kn für

k = 0, ..., n. Dabei ist jeder Eintrag die Summe der beiden

Die

Einträge darüber, z. B. ist

8

3

= 56 =

7

2

+

7

3

= 21 + 35

wahrscheinlichkeit.pdf, Seite 13

Kombinationen mit Wiederholung

Dürfen bei der Auswahl von

nelementigen

k

Elementen aus einer

Menge ohne Beachtung der Reihenfolge

n+k−1

k

Elemente mehrfach vorkommen, so gibt es

Möglichkeiten.

Beispiel

Es gibt Gummibärchen in

k =4

n=6

Farben. Für die Auswahl von

Gummibärchen, die nicht alle verschiedenfarbig sein

müssen, gibt es dann

6+4−1

4

=

9

4

=

9·8·7·6

4!

= 126

verschiedene Möglichkeiten.

Warnung!

In dieser Situation sind nicht alle Kombinationen

gleichwahrscheinlich, d. h. obige Formel kann nicht zur

Bestimmung von Wahrscheinlichkeiten genutzt werden (siehe

Beispiel zu 2 Würfeln).

wahrscheinlichkeit.pdf, Seite 14

Zusammenfassung

Ein LaplaceExperiment, bei dem alle Ausgänge als

gleichwahrscheinlich angenommen werden können, erhält man

bei zufälliger Auswahl in folgenden Situationen:

I Anordnung von

n

Objekten:

n!

Möglichkeiten

I geordneter Auswahl von k aus n Objekten ohne

n!

Möglichkeiten

Wiederholung:

(n−k)!

I geordneter Auswahl von k aus n Objekten mit

k

Wiederholung: n Möglichkeiten

I Auswahl von

k

aus

n

Objekten ohne Wiederholung ohne

n

Beachtung der Reihenfolge:

Möglichkeiten

k

Dagegen liegt bei der Auswahl mit Wiederholung ohne

Beachtung der Reihenfolge kein LaplaceExperiment vor.

wahrscheinlichkeit.pdf, Seite 15

Berechnung von Wahrscheinlichkeiten, Beispiel 1

Wie groÿ ist die Wahrscheinlichkeit für 4 Richtige beim Lotto?

Die Wahrscheinlichkeit berechnet sich als

g

n

=

Zahl der günstigen Fälle durch Zahl der möglichen Fälle

Letztere ist

n=

49

6

= 13 983 816.

Die Zahl der günstigen Fälle erhält man durch folgende

Überlegung: Von den 6 getippten Zahlen müssen genau 4

gezogen werden. Dafür gibt es

6

4

= 15

Möglichkeiten.

Daneben müssen von den 43 nicht getippten Zahlen 2 gezogen

werden, wofür es

Somit ist

43

2

= 903

Möglichkeiten gibt

g = 15 · 903 = 13 545

und die gesuchte

Wahrscheinlichkeit

6

P=

43

( )·( )

=

( )

4

2

49

6

13 545

13 983 816

≈ 0, 1 %

wahrscheinlichkeit.pdf, Seite 16

Verallgemeinerung

Von

N

Objekten, von denen

haben, werden

n

K

eine besondere Eigenschaft

zufällig ausgewählt. Dann ist die

Wahrscheinlichkeit, dass unter den ausgewählten Objekten

genau

k

die besondere Eigenschaft haben, gleich

K

k

·

N−K

n−k

,

falls k ≥ 0, k ≥ n und k

N

n

Man spricht von einer hypergeometrischen Verteilung.

P(k) =

≤ K.

Weiteres Beispiel

Wie groÿ ist die Wahrscheinlichkeit, dass ein Skatspieler genau

2 Buben bekommt?

Es gibt

N = 32

Karten, unter denen

K =4

Buben sind. Der

Spieler bekommt n = 10 Karten ausgeteilt. Somit ist

(4)·(32−4)

(4)·(28)

P(k = 2) = 2 324−2 = 2 32 2 ≈ 28, 9%.

( )

4

( )

4

wahrscheinlichkeit.pdf, Seite 17

Berechnung von Wahrscheinlichkeiten, Beispiel 2

Wie groÿ ist die Wahrscheinlichkeit, beim viermaligen Würfeln

genau 2 Sechsen zu erhalten?

Es gibt

n = 64 = 1296

Möglichkeiten. Günstige Fälle sind

66XX, 6X6X, 6XX6, X66X, X6X6 und XX66, wobei X jeweils

für eine Augenzahl zwischen 1 und 5 steht. Für jede dieser

= 42 Kombinationen gibt es noch einmal

2

5 = 25 Möglichkeiten für die beiden X.

6

Somit ist die Gesamtzahl der günstigen Möglichkeiten

g = 6 · 25 = 150

P=

150

1296

( )·5

4

=

und die gesuchte Wahrscheinlichkeit

2

2

6

4

=

4

2

·

1 2

6

·

5 2

6

≈ 11, 6 %.

Bemerkung: Die benutzte Formel ist ein Spezialfall einer

Binomialverteilung, die dann vorliegt, wenn ein

Zufallsexperiment mit zwei möglichen Ausgängen

(Erfolg/Misserfolg, 6/keine 6)

n

mal wiederholt wird und

die Anzahl der Erfolge gezählt wird.

wahrscheinlichkeit.pdf, Seite 18

Zwei Würfel

Es gibt 36 Möglichkeiten, jede hat Wahrscheinlichkeit 1/36.

Ω = {(i, j) : 1 ≤ i, j ≤ 6}

mit

P(i, j) =

1

36 .

Mit

A = {(2, 1), (2, 2), (2, 3), (2, 4), (2, 5), (2, 6)}

(erster Würfel 2)

und

B = {(1, 3), (2, 3), (3, 3), (4, 3), (5, 3), (6, 3)}

(zweiter Würfel 3)

ist

1

6 und

1

P(2, 3) = 36

=

P(A) = P(B) =

P(A ∩ B) =

P(A) · P(B)

Unabhängigkeit

A

und

B

heiÿen unabhängig, wenn

P(A ∩ B) = P(A) · P(B)

Interpretation: Das Eintreten von Ereignis

Einuss auf die Wahrscheinlichkeit von

B

A

hat keinen

und umgekehrt.

wahrscheinlichkeit.pdf, Seite 19

Beispiele

A = Augenzahl des ersten Würfels

B = Augensumme gerade ist

P(A) = P(B) = 12 und P(A ∩ B) = 14 ,

I Mit

gerade und

also sind die beiden Ereignisse unabhängig.

A = erster Würfel 4 und B = Augensumme

1

1

ist P(A) = , P(B) =

6

12 und

1

1

P(A ∩ B) = P(4, 6) = 36

6= 16 · 12

,

also sind A und B nicht unabhängig.

Mit A = erste gezogene Spielkarte ist ein Ass

und B = zweite Karte ist ein Bube ist

P(A) = P(B) = 81 und

4

1

P(A ∩ B) = 18 · 31

= 62

6= 81 · 18 ,

I Mit

I

10

d. h. die beiden Ereignisse sind nicht unabhängig.

wahrscheinlichkeit.pdf, Seite 20

Bedingte Wahrscheinlichkeit

Unabhängigkeit umformuliert:

P(A ∩ B) = P(A) · P(B) ⇔ P(A) = P(A ∩ B)/P(B).

Allgemein deniert man die bedingte Wahrscheinlichkeit von

unter

B

als

P(A|B) =

P(A ∩ B)

.

P(B)

Interpretation: Wahrscheinlichkeit für

dass

B

A

A,

wenn bekannt ist,

eingetreten ist.

Bemerkungen

I

I

P(A|B) ist nur deniert, wenn P(B) > 0.

Falls P(A), P(B) > 0, so gilt

A und B unabhängig ⇔ P(A|B) = P(A) ⇔ P(B|A) = P(B).

wahrscheinlichkeit.pdf, Seite 21

Beispiele bei zwei Würfeln

I

A:

Augensumme 10,

Dann ist

P(A) =

⇒ P(A|B) =

P(B|A) =

I

I

1/36

1/6

1/36

1/12

=

3

36

=

1

3

B : erster Würfel 4,

1

= 12

,

P(B) = 61 , P(A ∩ B) =

1

6

6= P(A) =

6= P(B) =

1

36

1

12 sowie

1

6.

A: Augensumme 7, B : erster Würfel 6,

1

P(A|B) = 11//36

6 = 6 = P(A) sowie

P(B|A) = 61 = P(B),

d. h. A und B sind unabhängig.

A: 6 Richtige beim Lotto,

B : die ersten 5 gezogenen Zahlen stimmen,

1

P(A|B) = 44

≈ 2, 27% > P(A) sowie

P(B|A) = 1 6= P(B).

wahrscheinlichkeit.pdf, Seite 22

Beispiel Kartenspiel (mit 32 Karten)

Es werden zwei Karten (ohne Zurücklegen) gezogen. Wie groÿ

ist die Wahrscheinlichkeit, dass zwei Asse gezogen werden?

Mit

A=

erste Karte ist ein Ass

und

B=

zweite Karte ist ein Ass

ist

P(A) =

4

32

=

1

8 und

P(B|A) =

(da unter der Annahme, dass

A

3

31

eingetreten ist, unter den

verbleibenden 31 Karten noch 3 Asse sind).

Daraus kann jetzt die gesuchte Wahrscheinlichkeit berechnet

werden:

P(A ∩ B) = P(A) · P(B|A) =

1

8

·

3

31

=

3

248

≈ 0, 012 = 1, 2%

wahrscheinlichkeit.pdf, Seite 23

Mehrstuge Zufallsexperimente

Die Formel

P(A ∩ B) = P(A) · P(B|A)

eignet sich zur

Bestimmung von Wahrscheinlichkeiten bei mehrstugen

Zufallsexperimenten.

Beispiel

In einer Kiste benden sich 7 weiÿe und 4 schwarze Socken.

Wo groÿ ist die Wahrscheinlichkeit, dass zwei zufällig

herausgegriene Socken die gleiche Farbe haben?

Mit den Ereignissen

A = erste Socke weiÿ und B = zweite

(A ∩ B) ∪ (A ∩ B) das Ereignis Beide

Socke weiÿ beschreibt

Socken haben die gleiche Farbe.

7

6

P(A ∩ B) = P(A) · P(B|A) = 11

· 10

=

4

3

6

P(A ∩ B) = P(A) · P(B|A) = 11 · 10 = 55 .

Es ist

Da

A∩B

und

A∩B

21

Wahrscheinlichkeit

55

21

55 sowie

unvereinbar sind, beträgt die gesuchte

+

6

55

=

27

55

≈ 49, 1 %.

wahrscheinlichkeit.pdf, Seite 24

Totale Wahrscheinlichkeit

Sind

A

sowie

und

B

Ereignisse, so gilt

B = (A ∩ B) ∪ (A ∩ B)

(A ∩ B) ∩ (A ∩ B) = ∅.

Aus den KolmogorovAxiomen folgt daher

P(B) = P(A ∩ B) + P(A ∩ B)

= P(A) · P(B|A) + P(A) · P(B|A).

Allgemeiner gilt

P(B) =

wenn

Pn

k=1

P(Ak ) · P(B|Ak ),

Ω = A1 ∪ ... ∪ An

mit

Ai ∩ Aj = ∅

eine Zerlegung des

Wahrscheinlichkeitsraumes ist.

Im letzten Sockenbeispiel

Mit

P(B|A) =

7

10 erhält man

P(B) = P(A) · P(B|A) + P(A) · P(B|A) =

7

11

·

6

10

+

4

11

·

7

10

=

wahrscheinlichkeit.pdf, Seite 25

7

11 .

Weiteres Beispiel

Es werden EMails untersucht, die zum Teil Spam sind.

Betrachtet werden die Ereignisse

S =Mail

ist Spam sowie

G =Mail

enthält das Wort Gewinn

Aus Erfahrungswerten seien folgende Wahrscheinlichkeiten

bekannt:

P(S) = 0, 25, P(G |S) = 0, 19

und

P(G |S) = 0, 01,

d. h. jede 4. Mail ist Spam und 19% aller Spammails sowie 1%

aller NichtSpamMails enthalten das Wort Gewinn. Es folgt

P(G ) = P(S) · P(G |S) + P(S) · P(G |S) = 0, 055,

also enthalten 5, 5% aller Mails das Wort Gewinn.

wahrscheinlichkeit.pdf, Seite 26

Formel von Bayes

Nach Denition der bedingten Wahrscheinlichkeit gilt für

Ereignisse

A

und

B

P(A ∩ B) = P(A) · P(B|A)

sowie

P(A ∩ B) = P(B) · P(A|B)

Durch Gleichsetzen dieser beiden Ausdrücke erhält man mit

der Formel der totalen Wahrscheinlichkeit den Satz von Bayes:

P(A|B) =

P(A) · P(B|A)

P(A) · P(B|A)

=

,

P(B)

P(A) · P(B|A) + P(A) · P(B|A)

bzw. bei einer Zerlegung

Ω = A1 ∪ ... ∪ An

P(Ak ) · P(B|Ak )

P(Ak |B) = Pn

.

i=1 P(Ai ) · P(B|Ai )

wahrscheinlichkeit.pdf, Seite 27

Anwendung: Bayes'scher Spamlter

Im letzten Beispiel:

P(S) = 0, 25

(25% SpamMails),

P(G |S) = 0, 19

(19% davon enthalten das Wort Gewinn)

P(G |S) = 0, 01

(1% der übrigen Mails enthalten das Wort Gewinn)

Dann folgt

P(S) · P(G |S)

P(S) · P(G |S) + P(S) · P(G |S)

0, 25 · 0, 19

=

≈ 0, 864,

0, 25 · 0, 19 + 0, 75 · 0, 01

P(S|G ) =

d. h. eine Mail mit dem Wort Gewinn ist zu 86, 4% Spam.

wahrscheinlichkeit.pdf, Seite 28