Anhang zur Vorlesung

Werbung

PD Dr. Dirk Horstmann

SS 2011

Wahrscheinlichkeitsverteilungen

Anlage zur Vorlesung

“Mathematik II für Studierende der Biologie”

1

Einige diskrete Wahrscheinlichkeitsverteilungen

In diesem Abschnitt sind einige wichtige diskrete Wahrscheinlichkeitsverteilungen zusammengefaßt.

1.1

Diskrete Gleichverteilung

Es sei Ω = {ω1 , ....ωn } die Ergebnismenge eines Zufallsexperiments und die ωi , i ∈ {1, .., n}, seien n paarweise disjunkte Ereignisse. Die Laplace-Wahrscheinlichkeit des Ereignisses ωi ist bekanntlich durch

P({ωi }) =

1

n

n

gegeben, und es gilt P({ω1 }) = .... = P({ωn }) sowie 1 = ∑ P({ωi }). Dann gilt für E ⊂ Ω

i=1

P(E) =

∑

P({ωi })

ωi ∈E

=

|E|

.

n

Offensichtlich sind die Ereignisse ωi , i ∈ {1, ..., n}, “gleich wahrscheinlich”. Ordnet man den ωi nun die Variablenwerte xi zu, so

erhalten wir die diskrete Wahrscheinlichkeitsverteilung

1

f (xi ) = P({ωi }) = .

n

Aus offensichtlichen Gründen nennt man diese Wahrscheinlichkeitsverteilung die diskrete Gleichverteilung. Die diskrete Gleichverteilung wird immer dann angewendet, wenn es keinen erkennbaren Grund dafür gibt, dass die Elementarereignisse unterschiedliche Wahrscheinlichkeiten haben.

1.2

Die Binomialverteilung

Die einfachsten nichttrivialen Zufallsexperimente sind solche mit 2 möglichen Ausgängen wie zum Beispiel Münzwurf (Kopf,

Zahl), Geschlecht von Nachkommen (männlich, weiblich), Qualitätskontrolle (defekt, intakt) oder das Auftreten von Mutationen

(Mutation, keine Mutation). Solche Zufallsexperimente mit 2 Ausgängen bezeichnet man als Bernoulli Experimente. Sie werden

eindeutig durch

Ω1 = {E, E},

P(E) = p,

q = 1 − P(E) = P(E)

beschrieben. Dabei ist also 0 ≤ p ≤ 1 die Wahrscheinlichkeit des Eintreffens des Ereignisses E. Führt man die Zufallsvariable X

so ein, dass X den Wert 1 oder 0 erhält, je nachdem ob E oder E eintritt, so nennt man die Wahrscheinlichkeitsverteilung

f (1) = P(X = 1) = p,

f (0) = P(X = 0) = q

mit

p+q = 1

1

eine Zweipunktverteilung mit dem Parameter p.

Aus einem einfachen Bernoulli Experiment lassen sich durch Wiederholungen schnell kompliziertere Wahrscheinlichkeitsmodelle bilden. Wir betrachten nun ein Zufallsexperiment, das aus n > 0 unabhängigen Wiederholungen eines Versuches besteht,

wobei jede Wiederholung entweder den Ausgang E (mit Wahrscheinlichkeit p) oder den Ausgang E (mit Wahrscheinlichkeit

1 − p = q) hat. Dies wird als ein n-stufiges Bernoulliexperiment bezeichnet.

Sei nun X die Anzahl der Wiederholungen mit dem Ausgang E. Die Wahrscheinlichkeit P(X = x) dafür, dass der Ausgang E

unter den n Wiederholungen insgesamt x-mal (x = 0, 1, ..., n) eintritt, ist dann durch

n

P(X = x) =

qn−x px

x

n

=

(1 − p)n−x px

x

mit x = 0, 1, ..., n gegeben. Weiter gilt:

1 = (p + q)n

n

=

∑ P(X = x).

x=0

Die Wahrscheinlichkeitsfunktion f , die durch

f (x) = P(X = x)

n

=

qn−x px

x

n

=

(1 − p)n−x px

x

gegeben ist, wird Binomialverteilung genannt. Die Zufallsvariable X heißt binomial verteilt oder kurz Bn,p -verteilt. Diese Binomialverteilung f wird kurz durch f (x) = Bn,p (x) bezeichnet. Sind alle Binomialwahrscheinlichkeiten zu bestimmen, geht man

zweckmäßigerweise so vor, dass man zuerst

n

Bn,p (0) =

qn−0 p0

0

berechnet und dann die Rekursionsformel

Bn,p (x + 1) = Bn,p (x)

(n − x)p

(x = 0, 1, ...n − 1)

(x + 1)(1 − p)

verwendet.

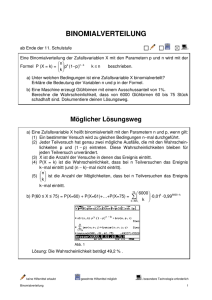

Abbildung 1: Die Binomialverteilung für n = 10 und p=0.125, p=0.25, p=0.5.

2

Beispiel 1.1 Die Wahrscheinlichkeit, dass eine bezüglich der Samenform mischerbige Erbse nach Selbstbestäubung einen kantigen Samen ausbildet, ist nach der Mendelschen Spaltungsregel gleich 1/4. Die Wahrscheinlichkeit, dass ein mischerbiger Samen

entsteht, ist 1/2. Wir betrachten die Entwicklung von 10 Samen und fragen nach der Wahrscheinlichkeitsverteilung der Anzahl X

der darunter befindlichen kantigen (Fall a) bzw. mischerbigen Samen (Fall b).

Im Fall a kann X als eine binomialverteilte Zufallsvariable mit den Parametern n = 10 und p = 0.25 angesehen werden. Der

Graph der dazugehörigen B10,0.25 -Verteilung ist in der Mitte der Abbildung 1 zu sehen.

Im Fall b folgt X einer B10,0.5 -Verteilung. Der dazugehörige Graph ist der rechte in Abbildung 1.

1.3

Die hypergeometrische Verteilung

Betrachten wir nun als Beispiel die Qualitätskontrolle, wie sie in der Industrie häufig durchgeführt wird. Gegeben sind N Objekte

(Schrauben, Transistoren, Tiere oder Pflanzen einer bestimmten Art). Von diesen sind a defekt, bzw. weisen ein besonderes

Merkmal auf. Der Anteil der abweichenden Teile ist dann p = Na . Wählen wir nun nacheinander n Objekte aus, wobei jedes

geprüfte Teil wieder zurück gelegt wird, so erhält man nach dem vorangegangenen Abschnitt für die Wahrscheinlichkeit, daß x

fehlerhafte Teile auftreten, gerade den Wert

n

(1 − p)n−x px .

x

Legt man die n Teile jedoch nicht zurück, so ist die Wahrscheinlichkeit, x-fehlerhafte Teile zu finden, durch

a

N −a

x

n−x

P(X = x) =

N

n

gegeben. Abstrakt läßt sich das nun wie folgt zusammenfassen.

Es sei X die Anzahl der aus einer Menge M gezogenen Objekte vom Typ A bei der zufälligen Ziehung (ohne Zurücklegen) von

n-Kombinationen aus M. Die Gesamtheit aller n-Kombinationen aus M bildet das sichere Ereignis Ω. Das Ereignis E = (X = x)

umfaßt alle n-Kombinationen, in denen sich x Objekte vom Typ A und (n − x) Objekte eines anderen Typs befinden. Insgesamt

seien a Objekte vom Typ A und N − a Objekte eines anderen Typs vorhanden.

Die Wahrscheinlichkeit des Ereignisses E ist dann durch

a

N −a

x

n−x

P(X = x) =

N

n

gegeben. Die Zufallsvariable X, die die Werte x = 0, 1, ..., a mit den oben gegebenen Wahrscheinlichkeiten annehmen kann, heißt

hypergeometrisch verteilt mit Parametern N, n und p = a/N. Für die Wahrscheinlichkeitsfunktion von X schreiben wir kurz

HN,n,p (x).

Aus praktischen Gründen ist es wichtig zu bemerken, dass die hypergeometrische Verteilung durch die Binomialverteilung

ersetzt werden kann, wenn n im Vergleich zu N klein ist (etwa n/N < 0.1). Unter dieser “Kleinheitsbedingung” gilt näherungsweise

HN,n,p (x) ≈ Bn,p (x).

1.4

Die Poisson-Verteilung

Betrachten wir nun wieder ein n-stufiges Bernoulliexperiment. Für sehr kleines p, aber andererseits sehr großem n, wird die

Berechnung der Wahrscheinlichkeiten P(X = x) recht mühsam. In diesem Fall kann man die Binomialverteilung durch eine

“Grenzverteilung” approximieren. Dies basiert auf dem Poissonschen Grenzwertsatz:

3

Läßt man p gegen Null und gleichzeitig n so gegen unendlich streben, dass das Produkt λ = np konstant bleibt,

nähert sich die Binomialverteilung immer mehr der Poisson-Verteilung mit den durch die Formel

P(X = x) = Pλ (x) = e−λ

λx

(x = 0, 1, ....)

x!

gegebenen Wahrscheinlichkeiten.

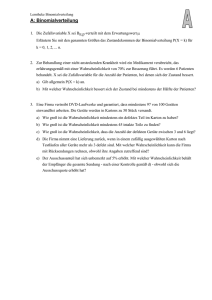

Abbildung 2: Die Poisson-Verteilung für λ = 0.5, λ = 1 und λ = 7.

Die Approximation der Binomialverteilung durch die Poisson-Verteilung ist bereits für 10 ≤ n und p ≤ 0.1 recht gut.

1.5

Negative Binomialverteilung

Eine diskrete Zufallsvariable X heißt negativ binomialverteilt mit den Parametern k > 0 und P > 0, wenn ihre Realisationen x

mit den Wahrscheinlichkeiten

−k

für x = 0

(1 + P) ,

P(X = x) =

k(k+1)(k+2)·.....·(k+x−1) x

P (1 + P)−k−x , für x = 1, 2, ....

x!

angenommen werden.

2

Einige stetige Wahrscheinlichkeitsverteilungen

Wenden wir uns nun den wichtigsten stetigen Verteilungen zu.

2.1

Die Standardnormalverteilung

Die wichtigste stetige Verteilung ist die sogenannte Normalverteilung. Als Realisation einer standardnormalverteilten Zufallsvariablen X können beliebige reelle Zahlen auftreten. Die Dichtekurve der Standardnormalverteilung hat die Form einer symmetrisch zur vertikalen Achse verlaufenden “Glockenkurve”. Ihre Funktionsgleichung lautet:

2

1

f (x) = √ e−x /2 .

2π

Für eine standardnormalverteilte Zufallsvariable X gilt aus Symmetriegründen

P(X ≤ −x) = P(X > x),

4

woraus sich

Φ(−x) =

=

=

=

P(X ≤ −x)

P(X > x)

1 − P(X ≤ x)

1 − Φ(x)

für die Verteilungsfunktion Φ der Standardnormalverteilung folgern läßt. Bei negativem x kann die Bestimmung von Φ(x) also

stets mit Hilfe der für positive x angegebenen Tabelle A.1 vorgenommen werden.

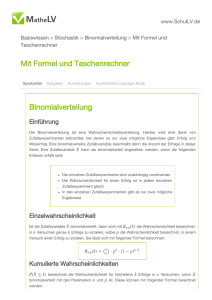

Abbildung 3: Die zur Standardnormalverteilung gehörende Dichtefunktion f (x) =

2.2

2

√1 e−x /2 .

2π

Die allgemeine Normalverteilung

Eine Zufallsvariable X heißt normalverteilt mit dem Mittelpunkt µ und der Varianz σ 2 , oder kurz

X ∼ N(µ, σ 2 ),

wenn ihre Dichtefunktion die Gestalt

f (x) =

2

2

1

√ e−(x−µ) /(2σ )

σ 2π

hat. Für ihre Verteilungsfunktion F gilt dann:

x−µ

F(x) = P(X ≤ x) = Φ

σ

,

d.h., der Wert der Verteilungsfunktion an der Stelle x läßt sich mittels der Verteilungsfunktion der Standardnormalverteilung

bestimmen und stimmt mit dem Wert von Φ an der Stelle (x − µ)/σ überein.

5