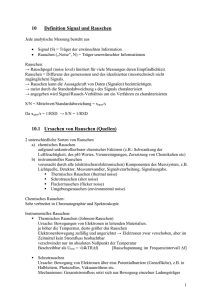

Kein Folientitel

Werbung

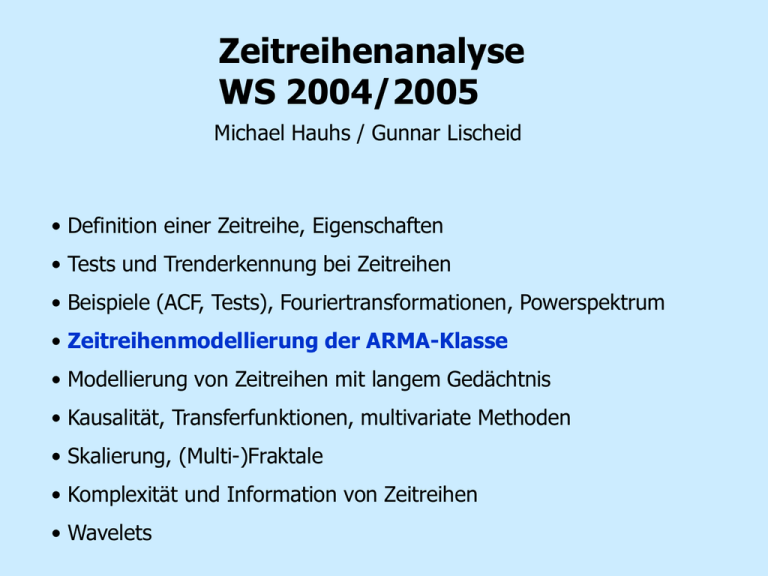

Zeitreihenanalyse WS 2004/2005 Michael Hauhs / Gunnar Lischeid • Definition einer Zeitreihe, Eigenschaften • Tests und Trenderkennung bei Zeitreihen • Beispiele (ACF, Tests), Fouriertransformationen, Powerspektrum • Zeitreihenmodellierung der ARMA-Klasse • Modellierung von Zeitreihen mit langem Gedächtnis • Kausalität, Transferfunktionen, multivariate Methoden • Skalierung, (Multi-)Fraktale • Komplexität und Information von Zeitreihen • Wavelets Zeitreihenmodellierung Mögliche Ziele und Arten: • exogene vs. endogene Modellierung (selbsterklärende Zeitreihenmodellierung) • linear vs. nichtlinear • stationär vs. nichtstationär; schwache Stationarität • deterministisch vs. stochastisch • chaotisch vs. regulär Reaktion auf Störungen • stabil vs. instabil Gleichgewichtszustand? Intermittenz? Exogene vs. endogene Modellierung Exogen: die abhängigen Variablen werden „von aussen“ gesteuert x (t ) f y1 , y2 ,..., t (t ) Endogen: die Zeitreihe wird aus ihrer eigenen Geschichte modelliert x (tk ) f x ti , t (tk ) Woldsches Theorem Zerlegungstheorem (stationäre Variante): Jede stationäre Zeitreihe kann als Summe einer deterministischen und einer unkorrelierten stochastischen Komponente geschrieben werden: x(t ) f ( x(t ), y (t )) (t ) Zerlegungstheorem (instationäre Variante): Jede linear instationäre Zeitreihe kann als Summe von vier Termen geschrieben werden: x(t ) f ( x(t ), y (t )) L(t ) P(t ) (t ) L – linearer Trend P – periodischer Trend (Wold 1938) Lineare Relationen und Filter Endogene Modellierung: Vergleich von beobachteten Werten mit Modellierungsversuchen und/oder früheren Beobachtungen. Dazu filtert man die Werte. Definition: Rückwärtsschiebeoperator Bxtk x tk 1 B 2 x tk B Bxtk x tk 2 ,..., B j x tk x tk j B 1 x tk x tk 1 Def.: Allgemeiner linearer Filter: y (t ) ( B) x(t ) mit Operatorpolynom ( B) i B i i Beispiele für Filter y (ti ) ( B) x ti Name Endlicher F. Kausaler F. Vorhersage F. n j x(ti j ) j m Bedingung m , n m 0, n 0 m 0, n m Beispiel/Aussehen m 1 y(ti ) x(ti j ) 2m 1 j m n y ( t i ) j x ( t i j ) j 0 y ( ti ) n j x ( t i j ) j m Autoregressive Modelle Idee: Der aktuelle Wert einer Zeitreihe ist durch die Werte in der Vergangenheit deterministisch bestimmt. Dazu kommt ein jeweils unvorhersehbares Rauschen (Innovation) p x ( ti ) ~ x ti j ~ x ( ti j ) i j 1 Autoregressives Modell p-ter Ordnung AR(p)-Modell Bedingungen an AR(p)-Modelle ~ x ti 0 i 0 2 C ( j ,k ) j k 0 für für jk jk d.h. das Rauschen ist unabhängig identisch verteilt (i.i.d.). Häufigste Wahl: Gaußsches Rauschen p Deterministischer Anteil: xˆ (ti ) j x(ti j ) j 1 Bestimmung der Koeffizienten Der deterministische Anteil soll maximal viel erklären. i ~ x (ti ) xˆ (ti ) soll möglichst wenig erklären! ! P i2 ( ~ x (ti ) xˆ (ti )) 2 Minimum Einsetzen der AR(p)-Formel, Ableiten nach j (~ x (ti ) xˆ (ti )) ~ x (ti j ) 0 ( j 1,..., p) Autokovarianz: Autokorrelation: C (k ) ~ x (ti ) ~ x (tik ) 2 ~ ~ k x (ti ) x (ti k ) / ~x Partielle Autokorrelationsfunktion Allgemeines Regressionsproblem: xt k 1 xt k 1 2 xt k 2 ... k xt t k PACF Corrx (ti ), x (ti j ) | x (ti 1 ), x (ti 2 ), ..., x (ti j 1 ) : xt k j xt k / x2 1 xt k j xt k 1 / x2 ... k xt k j xt / x2 xt k jt k / x2 j 1 j 1 2 j 2 ... k j k Lineares Gleichungssystem für die PACF Interpretation: PACF verschwindet für größere Lags Abweichung zwischen ACF und PACF deutet auf ungenügendes Modell (z.B. k zu klein) Yule-Walker Gleichung Einsetzen der Minimalbedingung: p C (k ) j C (k j ) j 1 Matrixinversion: ( j 1,..., p) (Yule und Walker 1927) 1 1 1 2 11 2 ... p 1 . 1 ... 2 1 1 p 2 . . ... ... . . ... 1 p 1 p 2 p p Explizites Beispiel I: AR(1) In der Hydrologie auch: Thomas-Fiering-Modell x(ti ) 1 ( x(ti 1 ) ) x (1 12 )1/ 2 w(ti ) • erhält erstes und zweites Moment • geeignet für kurzfristige („operationelle“) Vorhersage • Generierung synthetischer Abflussganglinien ACF des AR(1)-Prozesses: k k 1 Exponentieller Abfall! Explizites Beispiel II: AR(2) Bestimmungsstücke: N 1 N 1 2 x(ti ) 2 ( x(ti ) ) N i 1 N 1 i 1 1 N 1 2 1 ( x(ti 1 ) )( x(ti ) ) / N 1 i 1 1 N 2 2 2 ( x ( t ) )( x ( t ) ) / i2 i N 2 i 1 Daraus folgt (Übungsaufgabe!) 1 (1 2 ) 1 1 12 2 12 2 1 12 Vergleich ACF - PACF 0,8 0,7 0,6 0,5 0,4 0,3 0,2 0,1 0 -0,1 ACF PACF 0 5 10 15 20 Lag [d] Optimale AR(20)-Modellierung für Lehstenbach Defizite der AR-Modellierung Kurzzeitbereich: • Glättung der Extrema, Verpassen von Spitzen • Verzögerung von Wendepunkten Langzeitbereich: • exponentieller Abfall der ACF • keine Instationaritäten MA(q)-Modelle Auch Rauschen kann Gedächtnis haben! q x(ti ) 0 (ti ) k (ti k ) Moving-Average-Modell k 1 Koeffizientenbestimmung wieder aus ACF: k 1 k 1 ... q k k k 1 12 ... q2 0 für k 1, 2, ... , q für k q Lösung i.d.R. numerisch (nichtlinears Gl.-Sys.) MA(1) und MA(2) explizit MA(1): xi i 1i 1 1 k 1 2 k 1 1 0 MA(2): k 1 1 (1 2 ) 1 2 2 k 1 1 2 2 k k 2 2 2 1 1 2 0 k2 ACF von MA(q) verschwindet exakt für k > q Aufgabe 1. Führen Sie eine Fourieranalyse des Niederschlags-TemperaturAbfluss-Datensatzes durch. 2. Rekonstruieren Sie die Zeitreihen; führen Sie dabei eine Bandpassfilterung durch, indem Sie nur die vorherrschenden Frequenzen berücksichtigen. 3. Erstellen Sie das Powerspektrum der Niederschlags-, Temperaturund Abflussdaten, und bestimmen Sie die Steigung β der Regressionsgeraden im doppelt-logarithmischen Plot. 4. Suchen Sie Modelle AR(p) mit 0<p<5 und AM(q) mit 0<q<5 für den Niederschlags-Temperatur-Abfluss-Datensatz (saisonal und nicht saisonale Varianten). 5. Vergleichen Sie die Ergebnisse mit denen aus der Fourieranalyse. Anwendungsbereich der MA(q)-Modelle • Test der Autokorrelation: ist nach einem endlichen (kleinen) Lag die ACF nicht mehr signifikant von Null verschieden? • Fehlen Trends und Periodizitäten? • Dann ist eine MA(q)-Modellierung vielversprechend • In den Geowissenschaften: im Wesentlichen keine Anwendung reiner MA(q)-Modelle ARMA(p,q)-Modelle Kombination beider Modelltypen: p q j 1 k 1 x(ti ) j x(ti j ) kik i Auto Regressive Moving Average Modell der Ordnungen p und q Operatorschreibweise: ( B) x(t ) ( B) (t ) p ( B) 1 j B j j 1 q ( B) 1 k B k k 1 Koeffizienten des ARMA(p,q)-Modells In aller Regel wird das folgende Gleichungssystem numerisch gelöst: k 1 k 1 2 k 2 ... q q k k 1 12 22 ... q2 1 k 1 2 k 2 ... p k p Explizit: ARMA(1,1) (1 1 )(1 1 1 ) 1 2 1 1 21 1 2 1 1 k 1, 2 , ..., q k q 1 Prinzipielle Anforderungen an ARMA(p,q)-Modelle • Kausalität: hängt „glatt“ von Vorgängern ab, wächst nicht über alle Grenzen • Invertierbarkeit: aus den modellierten Werten soll man das Rauschen zurückrechnen können • Stationarität Zusammenfassung: ARMA-Modelle p p j 1 j 1 ~ x (ti ) x(ti ) j ( x(ti j ) ) i j ~ x (ti j ) i AR(p)-Modell q x(ti ) ki k i MA(q)-Modell k 1 p q j 1 k 1 x(ti ) j x(ti j ) ki k i kompakt: ( B ) x (t ) ( B ) (t ) ARMA(p,q)-Modell Kausalität bei ARMA(p,q)-Modellen Def.: Charakteristische Polynome des B -Operators ( z ) 1 1 z 2 z 2 ... p z p ( z ) 1 1 z 2 z ... q z 2 q Satz: Haben die beiden Polynome keine gemeinsamen Nullstellen und liegen alle Nullstellen von (z ) außerhalb des Einheitskreises: zk 0 zk 1 dann ist der ARMA(p,q)-Prozess kausal. Motivation zur Kausalität: AR(1)-Modell (1 ( B ) ) x ( t i ) i x(ti ) 1 1 ( B) Divergenz für mit formaler Umkehrung: i (1 B B ...)i 1 2 (d.h. 2 z1 1 / 1 ) Widerspruch zu Kausalität, Stationarität (aus endlichen Ursachen entwickeln sich unbegrenzte Wirkungen) Kausalität, ARMA und MA Satz: Liegt ein kausaler ARMA(p,q)-Prozess vor, kann man auch äquivalent schreiben x(ti ) ji j j 0 Dabei erhält man die Koeffizienten durch Auswertung von ( z) jz ( z) j 0 j und es gilt j 0 j Ein kausaler ARMA(p,q)-Prozess ist äquivalent zu einem MA Prozess Invertierbarkeit von ARMA(p,q)-Modellen Satz: Haben die beiden Polynome keine gemeinsamen Nullstellen und liegen alle Nullstellen von (z ) außerhalb des Einheitskreises: zk 0 zk 1 dann ist der ARMA(p,q)-Prozess invertierbar. Motivation zur Invertierbarkeit: MA(1)Modell xti (1 ( B)) (ti ) (ti ) 1 1 ( B) Divergenz für mit formaler Umkehrung: xti (1 B 2 B 2 ...)xti 1 (d.h. z1 1 / 1 ) Widerspruch zu Invertierbarkeit, Stationarität (aus der Zeitreihe kann nicht auf das Rauschen geschlossen werden) Invertierbarkeit, ARMA und AR Satz: Liegt ein invertierbarer ARMA(p,q)-Prozess vor, kann man auch äquivalent schreiben i j x(ti j ) j 0 Dabei erhält man die Koeffizienten durch Auswertung von ( z) j jz ( z) j 0 und es gilt j 0 j Ein invertierbarer ARMA(p,q)-Prozess ist äquivalent zu einem AR Prozess Stationarität von ARMA(p,q)-Modellen Satz: Ist ein ARMA(p,q)-Prozess kausal und invertierbar, dann ist er stationär. Stationaritätstests für ARMA(p,q)-Modelle aus zwei Kriterien Achtung: Wenn das ARMA-Modell einer Zeitreihe stationär ist, muss es die Zeitreihe selber nicht sein! Zusammenfassung: ARMA-Modelle p p j 1 j 1 ~ x (ti ) x(ti ) j ( x(ti j ) ) i j ~ x (ti j ) i AR(p)-Modell q x(ti ) ki k i MA(q)-Modell k 1 p q j 1 k 1 x(ti ) j x(ti j ) ki k i kompakt: ( B ) x (t ) ( B ) (t ) ARMA(p,q)-Modell