Folien Wiederholung deskriptive Statistik und Normalverteilung

Werbung

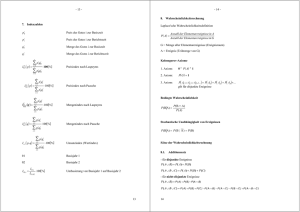

Vorlesung Wirtschaftsstatistik 2 (FK 040637) Wiederholungen deskriptive Statistik und Einleitung Normalverteilungsverfahren Dipl.-Ing. Robin Ristl Wintersemester 2012/13 1 Vorlesungsinhalte Wiederholung: o Deskriptive Statistik, Verteilungen, Erwartungswert, Varianz o Hypothesen Testen, p-Wert, Konfidenzintervalle Mittelwertvergleiche o einfache Varianzanalyse o mehrfache Varianzanalyse Abhängigkeiten zwischen zwei Variablen o Korrelation, lineare Regression Weiterführende Methoden o Multiple lineare Regression, logistische Regression Kategoriale Daten o Kreuztabellen, Chi-Quadrat Test 2 Literatur Statistik im Studium der Wirtschaftswissenschaften, Werner Brannath, Andreas Futschik , Christoph Krall, 3. überarbeitete Auflage 2010, Facultas Verlag Ergänzende Literatur Induktive Statistik, Helge Toutenurg und Christian Heumann, 4. Auflage 2008, Springer Verlag Lineare Modelle, Helge Toutenburg, 2. Auflage 2003, Physica Verlag Statistik für Human und Sozialwissenschaftler, Jürgen Bortz, 6. Auflage 2005, Springer Verlag 3 Daten Metrisch o Verhältnisskaliert es gibt einen eindeutigen Nullpunkt, Verhältnisse können sinnvoll gebildet werden. Bsp: Länge in Metern. 100 m sind 10 mal so viel wie 10 m; Temperatur in Kelvin. o Intervallskaliert kein eindeutiger Nullpunkt, aber gleiche Abstände (Intervalle). Bsp.: Temperatur in °Celsius. Der Unterschied zwischen 10°C und 20°C ist genauso hoch wie zwischen 50°C und 60°C, aber es ist nicht sinnvol zu behaupten 20°C ist doppelt so viel wie 10°C. Kategorial o Ordinalskaliert Es gibt eine Ordnung aber keine eindeutige Information über die Größe der Abstände. Beispiel Beurteilung: 1 ist besser als 2 usw., aber wir wissen nicht, ob der Abstand zwischen 1 und 2 genauso groß ist wie zwischen 2 und 3. (Außer es liegt eine Punkteskala zu Grunde, die wäre dann verhältnisskaliert.) o Nominalskaliert Es gibt keine Ordnung, nur Klassen. Bsp.: Geschlecht, Tierart, Holzsorten, ... 4 Deskriptive Statistik Metrische Daten o Lagemaße: Mittelwert, Median o Streuungsmaße: Varianz, Standardabweichung, Spannweite, Interquartilsabstand (IQR) o Grafisch: Histogramm, Boxplot Beispiel Proteingehalt in Milch (Gewichtsprozent), n=15 unabhängige Messungen Beschreibende Kenngrößen Mittelwert 3.432 Varianz 0.01647 Standardabweichung 0.12835 Median 3.43 1. Quartil 3.375 3. Quartil 3.52 Interquartilsabstand 0.145 Minimum 3.12 Maximum 3.64 Spannweite 0.52 5 Histogramm Daten: Klasseneinteilung Histogramm unter Klassengrenze obere Klassengrenze Häufigkeit 3.1 3.2 1 3.2 3.3 1 3.3 3.4 3 3.4 3.5 6 3.5 3.6 3 3.6 3.7 1 6 Boxplot 7 Kategoriale Daten – Beispiel klinischer Versuch Ein neues Medikament wird getestet. Die Versuchsgruppe bekommt das neue Medikament, die Kontrollgruppe ein bisher verwendetes Präparat und die Placebogruppe ein Placebo. Für jede Versuchsperson wird dokumentiert ob eine Wirkung eintritt oder nicht. Darstellung der Häufigkeiten in einer Kontingenztafel (Kreuztabelle): Wirkung keine Wirkung Summe Versuch Kontrolle Placebo Summe 65 42 16 123 35 58 34 127 100 100 50 250 8 Darstellung der Daten in Balkendiagrammen 9 Verteilungen Was sind Verteilungen? Was bedeuten Erwartungswert und Mittelwert? Was bedeutet Varianz bzw. Standardabweichung? Warum ist die Normalverteilung so wichtig? Wie können wir Antworten auf diese Fragen nutzen, um statistische Aussagen zu treffen? 10 Einige Definitionen Für Zufallszahlen verwenden wir Großbuchstaben, z.B.: X für Realisationen einer Zufallszahl Kleinbuchstaben, z.B.: x Die Wahrscheinlichkeit, dass eine Zufallsgröße X die Realisation x annimmt schreiben wir als . Wahrscheinlichkeit für ein Ereignis verstehen wir am einfachsten als Die Summe aller Wahrscheinlichkeiten für einen Ereignisraum muss immer 1 ergeben. 11 Beispiel Würfel X ist das Ergebnis eines Würfelwurfs. Die möglichen Ausprägungen sind (1,2,3,4,5,6) 12 Einige Definitionen - Das Summenzeichen Beispiel: , Konstante Multiplikatoren können vor das Summenzeichen gezogen werden: Ausprobieren! 13 Diskrete Wahrscheinlichkeitsfunktionen ordnen jedem Ereignis eine Wahrscheinlichkeit zu. Bernoulliverteilung: Es gibt nur zwei mögliche Ereignisse: 0 und 1 Die Wahrscheinlichkeit für nennen wir . Die Wahrscheinlichkeit für ist . 14 Diskrete Gleichverteilung (Bsp. Würfel) Alle möglichen Ereignisse haben die selbe Wahrscheinlichkeit p=1/6. 15 Bei stetigen Verteilungen entspricht die Fläche unter der Dichtefunktion der Wahrscheinlichkeit, dass ein Ereignis aus dem gewählten Intervall eintritt. Beispiel Normalverteilung mit Erwartungswert und Varianz 16 : Die Verteilungsfunktion gibt die Wahrscheinlichkeit an, eine Zufallszahl kleinergleich einer bestimmten Grenze zu beobachten. Beispiel Normalverteilung mit Erwartungswert Wahrscheinlichkeit und Varianz . Eine Standardnormalverteilte Größe Z hat die kleinergleich 1 zu liegen. 17 Erwartungswert (theoretischer oder wahrer Mittelwert) diskrete Verteilung: stetige Verteilung mit Dichte : Beispiel Bernoulli Ereignis: Beispiel Würfel: Vergleiche mit dem Stichprobenmittelwert Der stichprobenmittelwert ist ein Schätzer für den Erwartungswert! 18 Varianz (mittlere quadratische Abweichung vom Erwartungswert) diskrete Verteilung: stetige Verteilung: Beispiel Bernoulli Ereignis: Mit ergibt sich . Das ist die mittlere quadratische Abweichung vom Erwartungswert . In diesem Fall ist die Interpretation besonders einfach: X nimmt in der Hälfte der Fälle den Wert 0 an, in der anderen Hälfte den Wert 1. In beiden Fällen ist die absolute Abweichung vom Erwartungswert gleich 0,5 und die erwartete quadratische Abweichung ist 0,25. 19 Beispiel Würfel: Vergleiche mit der Stichprobenvarianz Die Stichprobenvarianz ist ein Schätzer für die wahre Varianz. Versuch: Würfle 10 mal und berechne aus den Würfelergebnissen den Stichprobenmittelwert und die Stichprobenvarianz. Vergleiche die erhaltenen Werte mit den theoretischen Werten! 20 Die Normalverteilung als zentrale Grenzverteilung Warum ist die Normalverteilung so wichtig? Der Grund liegt im zentralen Grenzwertsatz: Die Verteilung einer Summe von identisch und unabhängig verteilten Zufallsgrößen strebt mit gegen eine Normalverteilung. Wenn wir also eine Zufallszahl als Summe aus identisch verteilten, unabhängigen Zufallszahlen bilden, folgt die Verteilung dieser neuen Zufallszahl immer mehr einer Normalverteilung, je mehr Summanden wir addieren. Oft ist die Approximation auch schon bei einer überschaubaren Zahl an Summanden sehr gut. Schön und gut, aber wann bilden wir Summen? Wenn wir einen Erwartungswert (oder andere Modellparameter) schätzen! Z.B.: Und was nützt uns die Verteilung so eines Schätzers? Wir können durch Konfidenzintervalle oder Hypothesentsts Aussagen über den wahren Wert des Parameters treffen und dabei eine Irrtumswahrscheinlichkeit angeben. 21 Beispiele für den zentralen Grenzwertsatz – Summe mehrerer Würfel 22 Beispiele für den zentralen Grenzwertsatz – Verteilung der Summe von U(1,0) gleichverteilten Zufallszahlen 23 Normalverteilungsapproximation der Binomialverteilung Eine Binomialverteilte Größe entsteht als Summe von Bernoulliereignissen. Die Binomialverteilung wird durch die Zahl der Summanden und die Eintrittswahrscheinlichkeit aus der Bernoulliverteilung bestimmt. Wir schreiben um zu sagen, dass X einer Binomialverteilung mit mit den Parametern n und p folgt. Die Wahrscheinlichkeitsfunktion ist Bsp: Die rote Kurve zeigt die wieder die Normalverteilungsapproxiamtion. 24 Normalverteilungsapproximation der Binomialverteilung Erwartungswert und Varianz der Binomialverteilung können wir leicht bestimmen, wenn wir bedenken, dass dien Binomialveteilte Größe aus einer Summe von verteilten Größen entsteht. Erwartungswert und Varianz für die Bernoulliverteilung haben wir bereits oben gefunden: und . Weiters verwenden wir, dass der Erwartungswert für jeden Summanden gleich dem Erwartungswert von Y ist. Das selbe gilt für die Varianz. Der Erwartungswert einer Summe ist die Summe der Erwartungswerte, daher: Die Varianz einer Summe ist für unabhängige Größen die Summe der Varianzen, daher: 25 Normalverteilungsapproximation der Binomialverteilung Für unsere Verteilung erhalten wir also Genügt das, um die Dichte der passenden Normalverteilung zu erhalten? Ja, die Dichtefunktion der Normalverteilung ist Wir schreiben . Dabei ist der Erwartungswert und die Varianz der Normalverteilung. Die Funktion wird durch diese beiden Parameter bestimmt. 26 Statistische Inferenz mittels Normalverteilungsapproximation Beispiel: n=50 Testpersonen bewerten einen Energydrink mit „gut“ oder „schlecht“. 30 Personen finden das Getränk gut (Ereignis 1), 20 finden es schlecht (Ereignis 0). (Das Zufallsereignis tritt bei der Wahl der Testpersonen auf.) Wir schätzen aus dieser Stichprobe den Anteil der Personen in der Gesamtpopulation, die das Getränk mögen, auf . Frage 1: Kann der wahre Parameter sein? Wir wollen also die Nullhypothese testen. 27 Wir wissen: , daher (Beachte dabei: und ) Wenn wir unter der Nullhypothese Normalverteilung so aus: annehmen, sieht die passende 28 Wo liegt unser in dieser Verteilung? Die Wahrscheinlichkeit bei geltender Nullhypothese ein mit dem Wert 0,6 oder höher zu beobachten entspricht der schraffierten Fläch und ist 0,0786. 29 Wir wollen aber auch eine mögliche gleich große Abweichung in die andere Richtung berücksichtigen: Die Wahrscheinlicheit eine absolute Abweichung 0,1572. Diese Größe ist der p-Wert für unseren Test! 30 zu beobachten ist also Entscheiden mittels p-Wert Wir vergleichen den p-Wert mit einem gewählten Signifikanzniveau . Oft wird diese mit festgesetzt. Wenn der p-Wert kleiner als 0,05 ist, heißt das Folgendes: Die Wahrscheinlichkeit durch Zufall eine so große oder noch größere Abweichung vom Erwartungswert zu beobachten wie hier liegt unter 5%. Wir schließen dann, dass nicht eine unwahrscheinlich große Abweichung vorliegt, sondern die Nullhypothese nicht stimmt. In unserem Beispiel ist der p-Wert mit 0,16 aber größer als 0,05. Wir können deshalb aber nicht schließen, dass die H0 stimmt. Wir wissen nur: Wir können die H0 nicht verwerfen! 31 Standardisierung Die obigen Berechnungen werden einfacher, wenn die beobachtete Größe so transformiert wird, dass ihre Verteilung immer einer Standardnormalverteilung N(0,1) entspricht. Das ist sehr einfach: Wir müssen nur den Erwartungswert abziehen und durch die Wurzel der Varianz dividieren. Merke: Die Wurzel der Varianz wird oft Standardfehler (SE) genannt. In unsrem Beispiel: Z ist unsere Teststatistik. Wir prüfen jetzt, wo Z in einer Standardnormalverteilung liegt. 32 Natürlich ergibt sich das selbe Bild wie vorher, nur anders skaliert: 33 Kritische Grenzen Besonders für die händische Berechnung ist es einfacher kritische Grenzen für die Teststatistik zu bestimmen und damit über die H0 zu entscheiden. Die kritischen Grenzen co und cu sind jene Werte in der Verteilung der Teststatistik, die gerade mit der Wahrscheinlichkeit überschritten werden. Also hier ganz einfach das 97,5% Quantil und das 2,5% Quantil der Standardnormalverteilung. Formal schreiben wir: , da die Normalverteilung symmetrisch ist. Für sind diese Werte: und Es lohnt sich, diese Zahl auswendig zu wissen! 34 Im Beispiel liegt Z=1,14 innerhalb der kritischen Grenzen, Nullhypothese nicht ab. 35 . Wir lehnen die Konfidenzintervall Frage : In welchem Bereich liegt der wahre Parameter p? Gesucht ist ein 95% Konfidenzintervall. Wir gehen so vor: Wie groß kann der wahre Wert für p sein, so dass die Wahrscheinlichkeit für unsere Beobachtung zumindest , also 5%, beträgt? Die Antwort: 36 Herleitung für die obige Formel Wenn die obere Grenze po der wahre Parameter ist muss gelten daraus folgt umformen ergibt Analog für die untere Grenze. 37 Achtung, die Approximation ist umso besser, je näher p an 0,5 liegt und je höher die Fallzahl ist! n=20, p=0,1; 0,2; 0,5 38 p=0,1 n=20, 50, 100 39 T-Test Der bekannte T-Test für Mittelwertsvergleiche und das Bestimmen von Konfidenzintervallen für den Erwartungswert folgen den selben Überlegungen. Aber: Wir müssen die Varianz als zusätzlichen Parameter schätzen und das Ergebnis dieser Schätzung unterliegt auch einer Zufallsschwankung. Die Teststatistik folgt deshalb nicht einer Standardnormalveteilung sondern einer tVerteilung. (Siehe Formelsammlung unten.) Die Zahl der Freiheitsgrade der entsprechenden t-Verteilung ist der Stichprobenumfang minus der Anzahl der geschätzten Erwartungswerte. Mit steigender Zahl an Freiheitsgraden strebt die t-Verteilung gegen eine Standardnormalverteilung. 40 41 Formelsammlung Konfidenzintervall für Anteilswert: Einstichprobentest für Anteilswert: , Test für Differenz von zwei Anteilswerten: , mit Für beide Test gilt unter der jeweiligen Nullhypothese , , H0 verwerfen, wenn die Teststatistik Z außerhalb der kritischen Grenzen co, cu liegt. 42 Formelsammlung Konfidenzintervall für Erwartungswert: Einstichprobentest T-Test für Erwartungswert , (mit (t-Verteilung mit n-1 Freiheitsgraden), ) , Zwei Stichproben T-Test für Differenz von zwei Erwartungswerten unter Annahme gleicher Varianzen , mit der gepoolten Standardabweichung , , H0 verwerfen, wenn die Teststatistik T außerhalb der kritischen Grenzen co, cu liegt. 43