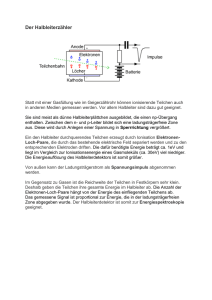

PDF, 2.96MB - jkrieger.de

Werbung